На заре компьютерных игр каждый новый релиз казался визуальной революцией. Графика развивалась стремительно, однако, положа руку на сердце, ей было куда расти. Достаточно вспомнить Лару Крофт из первых частей Tomb Raider — её угловатые формы, составленные из крупных полигонов, скорее напоминали геометрические фигуры, нежели живого персонажа.

Но в начале двухтысячных произошёл перелом. Появилась технология, которая кардинально преобразила графику в играх. Персонажи перестали выглядеть как фигурки оригами, картинка стала всё больше приближаться к реальности, а каждый новый релиз вызывал восторг у игроков.

Однако никто не мог предположить, что эта, казалось бы, небольшая инновация, задуманная исключительно ради красивой картинки, изменит вектор развития целой индустрии и в конечном счёте приведёт к новой промышленной революции, в которой искусственный интеллект постепенно начинает вытеснять человека.

Эта технология — шейдеры.

В этой статье речь пойдёт о том, как динозавры вдохновили Valve на создание Half-Life 2, каким образом видеоускорители превратились в процессоры и породили искусственный интеллект, а компания NVIDIA стала одной из самых дорогих корпораций в мире.

Междоусобные войны видеокарт

Девяностые годы. Рынок компьютерных игр представлял собой неизведанные территории, подобные ещё не открытой карте в стратегии Warcraft. По этим территориям рыскали «войска» графических компаний — небольших фирм, соревновавшихся за право диктовать свои условия.

Самой могущественной силой того времени была 3dfx Interactive. Её графические акселераторы Voodoo и закрытый программный интерфейс Glide преображали игры до неузнаваемости. Владельцы этих карт наслаждались невиданным качеством графики, а все остальные могли лишь завидовать.

Главным соперником 3dfx выступала молодая и агрессивная NVIDIA. Она наносила удар за ударом — чипами RIVA 128 и RIVA TNT, — постепенно отвоёвывая долю рынка.

За спинами лидеров набирала силы ATI (будущая AMD) с линейкой карт 3D Rage. В корпоративном сегменте компания уже чувствовала себя уверенно, однако в игровом пространстве пока отставала, делая ставку на мультимедийные возможности и аппаратное декодирование видео.

На горизонте маячили и менее успешные игроки: S3 Graphics и Matrox.

Каждый производитель строил собственную империю за стенами проприетарных стандартов и не желал договариваться с конкурентами. Разные архитектуры, закрытые программные интерфейсы — игры, прекрасно работавшие на одном железе, отказывались запускаться на другом без мучительных танцев с бубном. Царили хаос и фрагментация.

Но недавно утвердившийся на технологическом троне Microsoft решил навести порядок. Корпорация замыслила загнать всех производителей в единый стандарт — DirectX. Впрочем, сделать это оказалось значительно сложнее, чем представлялось.

Гонка архитектур

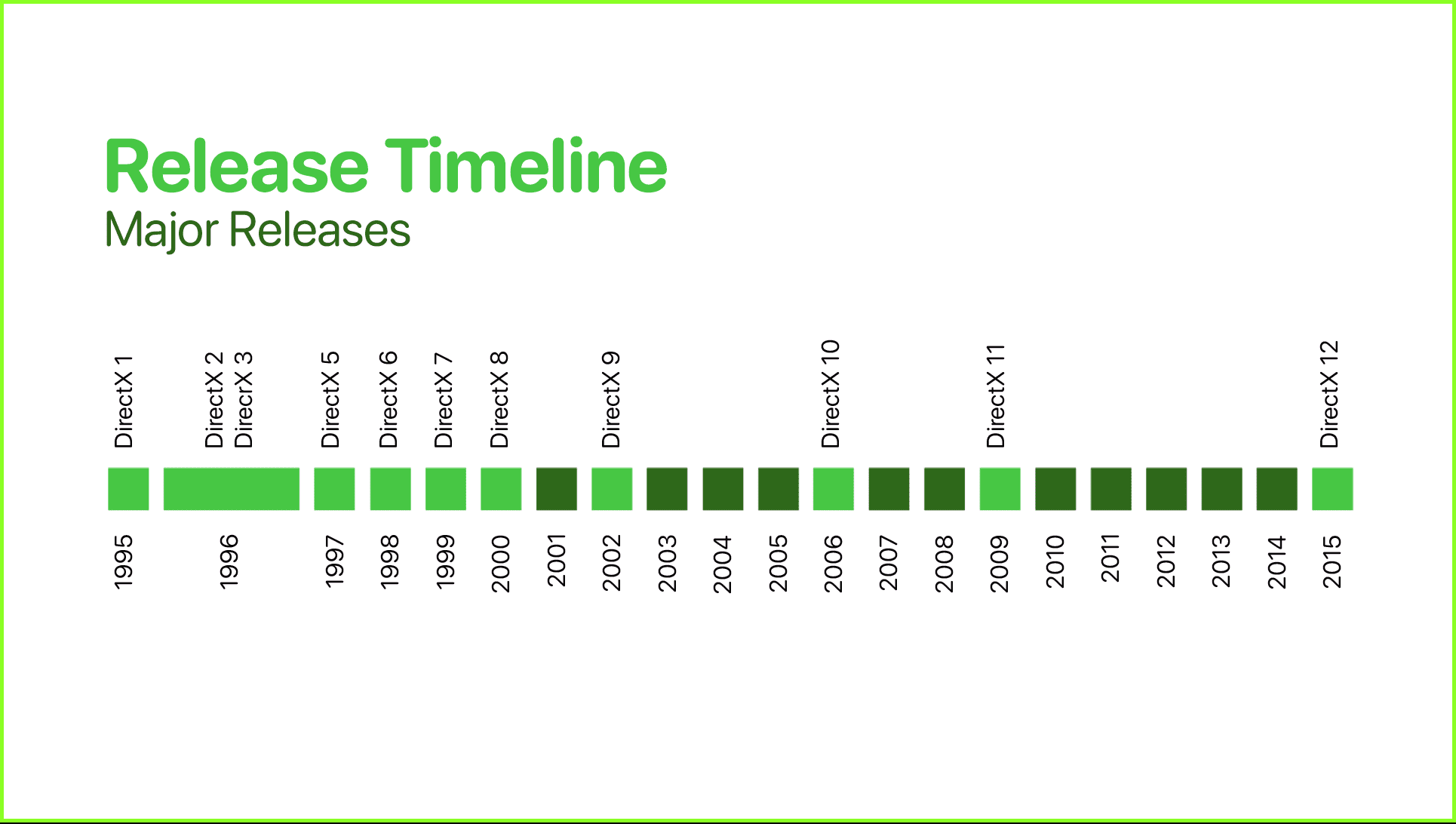

В первые годы DirectX развивался семимильными шагами. Microsoft выпускала версию за версией, внедряя все передовые технологии того времени. К седьмой версии DirectX уже уверенно превосходил главного конкурента — OpenGL. Однако, несмотря на бешеный темп обновлений, стандарт всё равно не поспевал за рынком. И дело было не в OpenGL, а в производителях железа.

Видеокарты того времени, строго говоря, ещё не были видеокартами в современном понимании. Их даже называли иначе — графическими ускорителями, или акселераторами.

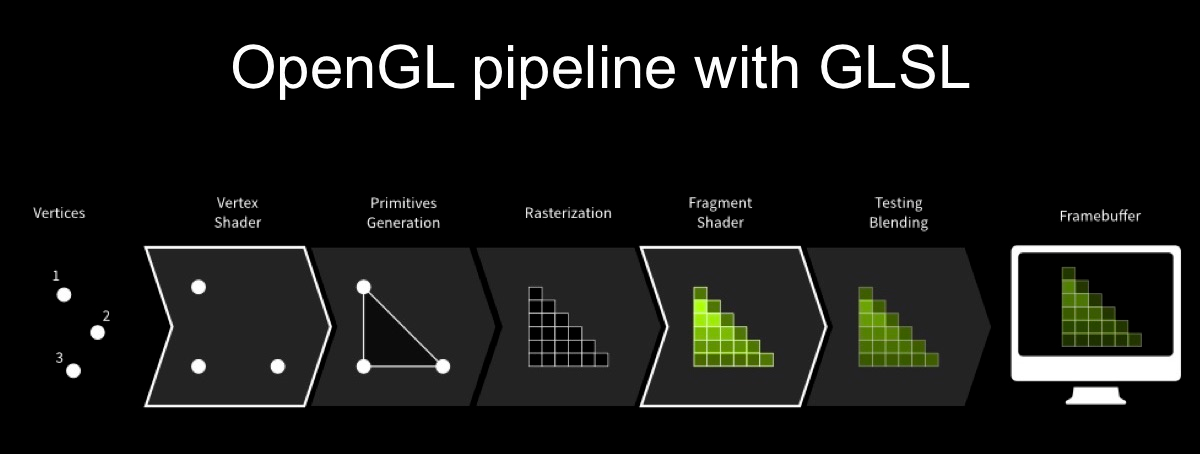

Эти ускорители работали по так называемому фиксированному конвейеру (fixed-function pipeline). Что это означало на практике?

Вся графика прогонялась через специализированные аппаратные блоки, функции которых были буквально «вшиты» в железо. Разработчики могли пользоваться готовыми инструментами, но не имели возможности менять их поведение по своему усмотрению.

По сути, видеокарта работала как волшебная коробочка со встроенным рецептом. Загружаешь в неё игру — она щедро посыпает её фирменным набором графических «специй», и картинка преображается. Нравится результат — прекрасно. Не нравится — что ж, приобретай новую видеокарту с другим набором «специй», на свой вкус.

Производителям такой расклад был на руку: разница между моделями была очевидной, а значит, продавать их было проще.

Игроков тоже всё устраивало — фиксированный конвейер работал стабильно и выдавал высокую частоту кадров.

А разработчики? Разумеется, подобный подход ограничивал творческие возможности, зато существенно ускорял процесс создания игр. Эффекты не требовалось писать вручную — они уже были заложены в аппаратуру. Достаточно было просто добавить их поддержку в свой проект.

Однако для Microsoft это оборачивалось настоящим кошмаром. Каждую новую аппаратную «особенность» приходилось экстренно добавлять в DirectX, подстраиваясь под рынок видеокарт. А диктовать свои условия, когда ты вынужден лишь догонять спецификации производителей, попросту невозможно.

Казалось, выхода не было. Или казалось, что не было — до тех пор, пока в команду DirectX не пришёл новый человек. Он заявил: «Так работать невозможно!» — и предложил революционную идею, изменившую вектор развития всей индустрии.

Физически корректный провал

Этим человеком был Джонатан «Шеймус» Блэкли — впоследствии известный как один из «отцов» игровой консоли Xbox. Личность разносторонняя: физик по образованию, разработчик игр по призванию и киношник по стечению обстоятельств.

В Microsoft он занимался унификацией драйверов для промышленных и потребительских трёхмерных ускорителей. Блэкли прекрасно понимал: главная преграда на пути стандартизации — фиксированный конвейер с его бесконечным калейдоскопом аппаратных «особенностей».

Но если Microsoft страдала от хаоса в стандартах, то разработчики игр мучились от ограничений самих видеокарт. И Блэкли знал об этом не понаслышке.

До прихода в Microsoft он работал в DreamWorks Interactive — игровом подразделении студии DreamWorks, где создавал физический движок для игры Trespasser, основанной на вселенной «Парка юрского периода».

Физический движок Trespasser был настоящей революцией для своего времени. Физика в игре поражала воображение: предметы можно было поднимать, бросать, расстреливать, а шкала здоровья персонажа отображалась в виде татуировки сердца на груди главной героини — решение, мягко говоря, спорное с точки зрения дизайна, но в те годы это казалось новаторством.

Именно этот физический движок впоследствии вдохновил студию Valve на создание Half-Life 2, а позднее — на разработку Half-Life: Alyx.

Сегодня Trespasser считается культовым проектом, однако в 1998 году игра с треском провалилась. Причина заключалась в ужасном техническом состоянии: спешка, чрезмерные амбиции и, разумеется, ограничения фиксированного конвейера, который попросту не позволял реализовать задуманное.

Но какие же были альтернативы? Ответ пришёл из мира большого кино — а точнее, из области трёхмерной анимации.

История других игрушек

Как человек из мира трёхмерной графики и кинематографа, Шеймус Блэкли, разумеется, знал о достижениях студии Pixar.

В те годы мультфильмы Pixar совершили нечто невообразимое. Никто и представить не мог, что компьютерная графика способна выглядеть настолько правдоподобно. Но каким образом студия этого добилась?

Секрет заключался в одном элегантном приёме. Чтобы цифровые объекты выглядели убедительно, их поверхности должны были корректно взаимодействовать со светом. Глянцевый пластик обязан блестеть, ткань — быть матовой и фактурной, а дерево — сохранять характерный рисунок волокон.

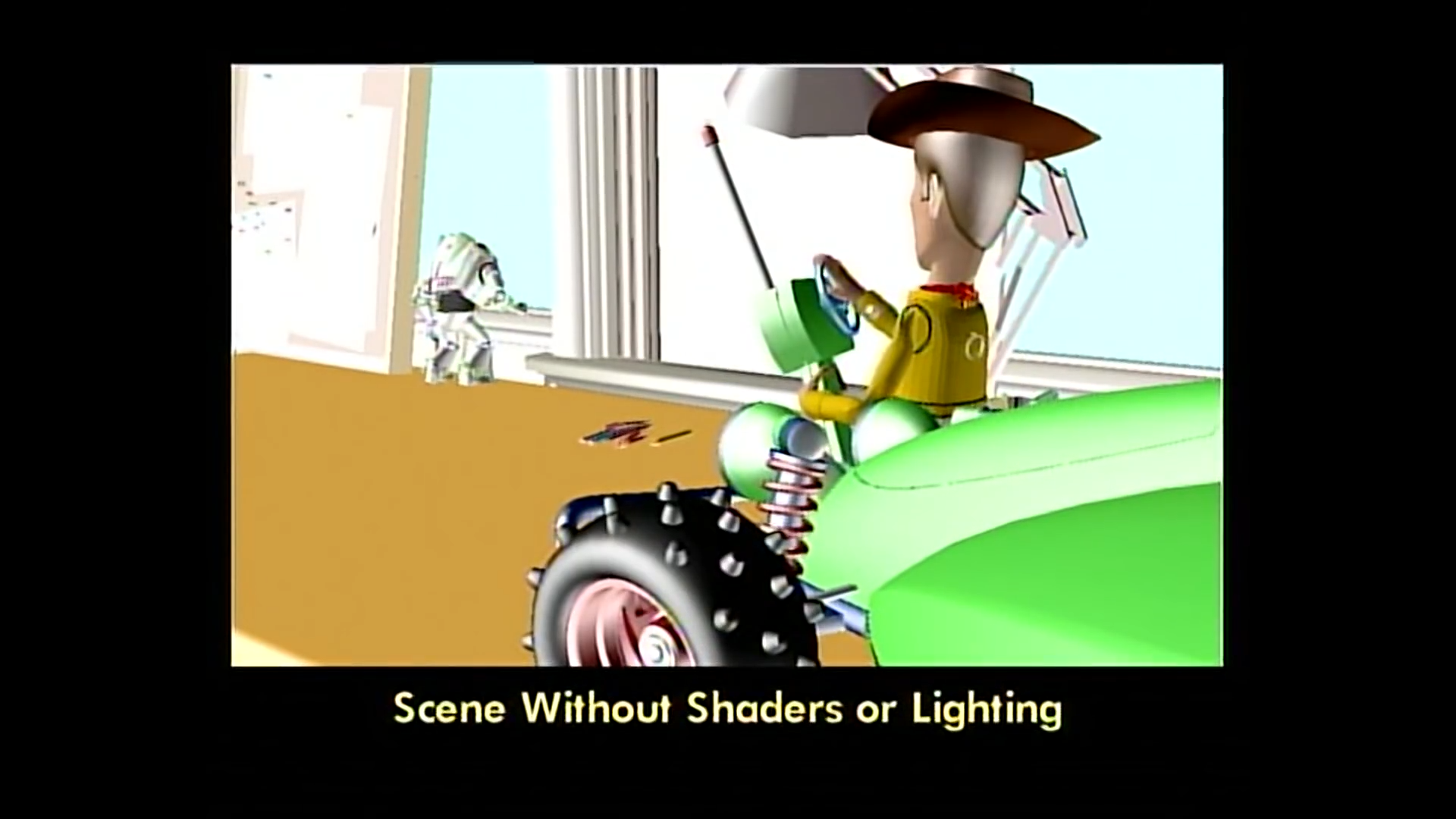

Поэтому для каждого вида поверхностей в Pixar написали специальные программы, описывающие, как именно свет должен с ними взаимодействовать: отражаться, рассеиваться, поглощаться. Эти программы получили название шейдеры — буквально «затенители» (от английского shade — «затенять»).

Шейдеры творили настоящее волшебство. Без них изображение выглядело плоским и искусственным, но стоило их применить — и сцена оживала.

Казалось бы, почему бы не перенести эту технологию в игры? Однако на пути стояли два серьёзных препятствия.

Во-первых, шейдеры требовали огромных вычислительных мощностей. В кинематографе один кадр мог рендериться часами или даже сутками на серверных кластерах стоимостью в миллионы долларов. В играх же каждый кадр должен формироваться за считанные миллисекунды — и не на суперкомпьютере, а на обычном домашнем компьютере.

Во-вторых, Pixar рендерил свои фильмы на центральном процессоре (CPU). Шейдеры — это программы, а для выполнения программ требуется полноценный процессор, а не специализированное устройство для ускорения отрисовки пикселей. Видеокарты с фиксированным конвейером не умели выполнять произвольный код — они лишь пропускали изображение через жёстко заданные аппаратные блоки.

Прорыв в железе

Иными словами, чтобы адаптировать технологию шейдеров для игр, необходимо было решить две задачи.

Первая — переписать значительную часть программного интерфейса DirectX. Задача сложная, но выполнимая.

Вторая, и главная, — убедить производителей видеокарт изменить саму архитектуру своего железа.

Фиксированный конвейер состоял из множества аппаратных блоков, каждый из которых выполнял строго определённую функцию. Маркетологи были в восторге от такого положения дел: «Посмотрите, у нас туман гуще, чем у конкурентов, фильтрация не билинейная, а трилинейная, а какие сглаженные края!»

Теперь же требовалось отказаться от всех этих уникальных торговых предложений и заменить специализированные блоки универсальными вычислительными ядрами, которые подчиняются не производителю, а исполняют код, написанный разработчиками игр.

Задача, мягко говоря, непростая. Но Блэкли помогла сила убеждения.

Сначала он убедил Microsoft. Программируемые шейдеры — это будущее. А кто задаст стандарт, тот и будет это будущее контролировать. Microsoft согласилась.

Затем он убедил производителей. И первой на новый путь встала NVIDIA.

Рождение GPU

В компании уже осознавали перспективность этой идеи. В 1999 году вышел GeForce 256 — первый продукт в линейке GeForce и, по утверждению самой NVIDIA, первый в мире GPU (Graphics Processing Unit) — графический процессор.

Впрочем, по существу, это был в значительной мере маркетинговый ход. Видеокарта по-прежнему использовала фиксированный конвейер. Единственным подлинным новшеством стала аппаратная поддержка T&L (Transform & Lighting) — обработка геометрии и освещения силами видеокарты, а не центрального процессора.

Тем не менее эксперимент удался. Выяснилось, что видеокарта справляется с подобными вычислениями значительно быстрее, чем CPU.

Риски были огромными. NVIDIA не горела желанием отказываться от своих наработок, однако выбора не оставалось. В те годы Дженсен Хуанг возглавлял сравнительно небольшую компанию, тогда как Microsoft была абсолютным монополистом. Бросить вызов «королю» означало выстрелить себе в ногу.

Поэтому NVIDIA приняла условия — и не прогадала.

В ноябре 2000 года вышел DirectX 8 с поддержкой вершинных и пиксельных шейдеров. Вслед за ним появилась GeForce 3 — первая видеокарта с программируемым конвейером и поддержкой нового программного интерфейса.

Фиксированный конвейер ушёл в историю, а вместе с ним — и компании, которые не успели перестроиться: 3dfx, S3, Matrox.

Графические ускорители уступили место графическим процессорам. Игровая индустрия вступила в свой золотой век.

Золотой век игр

С появлением шейдеров разработчики обрели долгожданную творческую свободу. Игры преобразились, а технологические шедевры посыпались один за другим.

Doom 3 — с его динамическим освещением и тенями, которые впечатляли настолько, что игроки буквально замирали перед монитором от ужаса и восторга.

Half-Life 2 — с реалистичной физикой, вдохновлённой опытом Trespasser и доведённой до совершенства.

И, разумеется, главная технологическая демонстрация десятилетия — Crysis. В этой игре шейдеры использовались повсюду: динамическое освещение, объёмные тени, реалистичная вода, невероятная детализация окружения. Ни один персональный компьютер того времени не мог запустить Crysis на максимальных настройках — но как же великолепно эта игра выглядела даже при скромной производительности.

Однако главное значение шейдеров заключалось не только в творческой свободе для разработчиков. Они раскрыли подлинный потенциал видеокарт — потенциал, который выходил далеко за рамки игровой индустрии.

«Неприлично» параллельный

Итак, известно, что игры быстрее работают на видеокарте, нежели на центральном процессоре. Но почему?

Дело в архитектуре.

CPU — это, образно говоря, высокоинтеллектуальные исполнители, но с очень строгими правилами работы. Они спроектированы для выполнения задач последовательно. Процессор обрабатывает инструкции одну за другой с высочайшей скоростью, однако строго в заданном порядке.

Можно запустить множество программ, и будет казаться, что они работают одновременно. В действительности процессор попросту молниеносно переключается между ними.

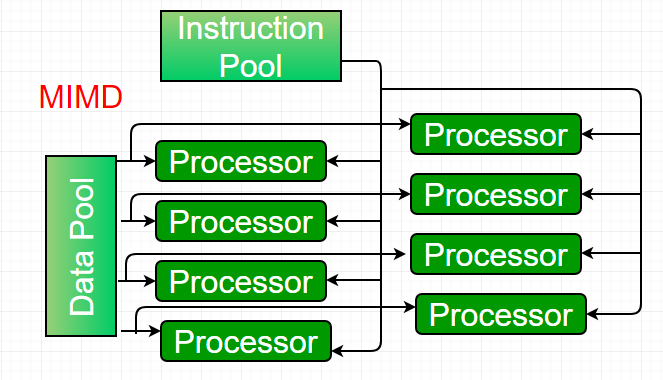

Этот тип вычислений чаще всего называют MIMD (Multiple Instruction, Multiple Data) — «много инструкций, много данных».

Участь процессора незавидна: стоит выполнить какую-либо операцию не в той последовательности — и программа рухнет. Поэтому, если задача сложная, нередко лучше, чтобы она выполнялась на одном ядре. А если возникает желание задействовать все ядра, приходится явным образом распараллеливать код.

Вот почему замена четырёхъядерного процессора на восьмиядерный далеко не всегда даёт ощутимый прирост производительности в отдельных задачах или играх. Приложение должно уметь работать с многопоточностью, а для этого необходимо специальным образом переписывать код.

Совсем иная картина складывается с видеокартой. Стоит заменить её на более мощную — и частота кадров в игре немедленно возрастает. Никаких дополнительных усилий со стороны программистов не требуется.

Причина в том, что у GPU массово-параллельная архитектура. Её также обозначают терминами SIMD (Single Instruction, Multiple Data) или SIMT (Single Instruction, Multiple Threads) — буквально: «одна инструкция — много данных». Видеокарте не нужно заботиться об очерёдности операций — она просто обсчитывает миллионы пикселей одновременно. Какой пиксель обработать первым, какой последним — не столь существенно.

У подобных задач существует даже специальный термин: embarrassingly parallel, что можно перевести как «чрезвычайно параллельные», хотя буквальный перевод — «неприлично параллельные» — пожалуй, точнее передаёт суть.

До появления шейдеров этот колоссальный потенциал видеокарт был заперт внутри фиксированного конвейера. Вычисления могли вестись лишь в рамках одного специализированного блока.

Шейдеры сняли все ограничения. И внезапно выяснилось, что видеокарты — это, по существу, суперкомпьютеры. А использовать их исключительно для игр — как минимум расточительно.

GPGPU: когда видеокарта стала суперкомпьютером

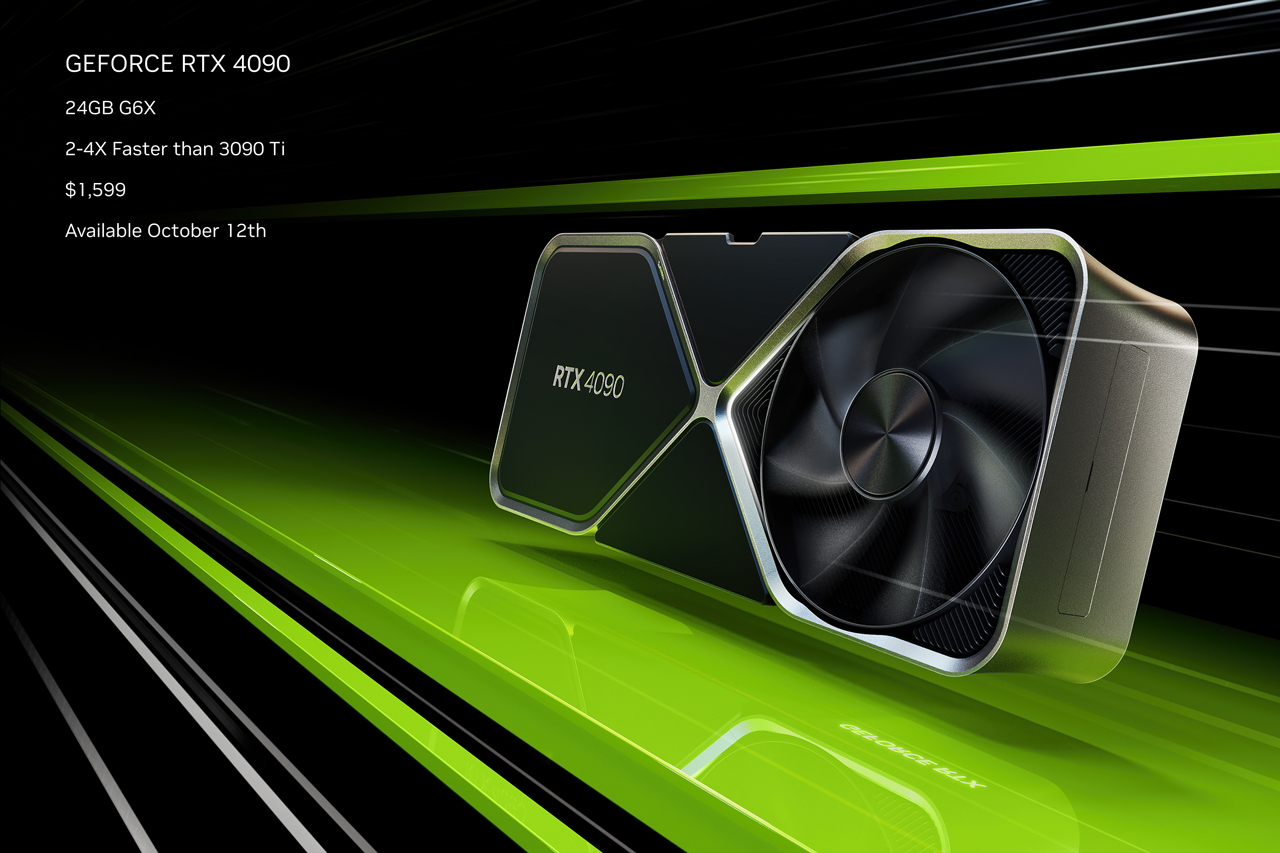

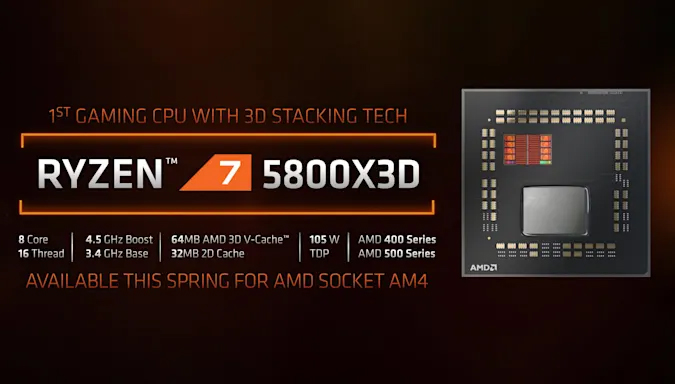

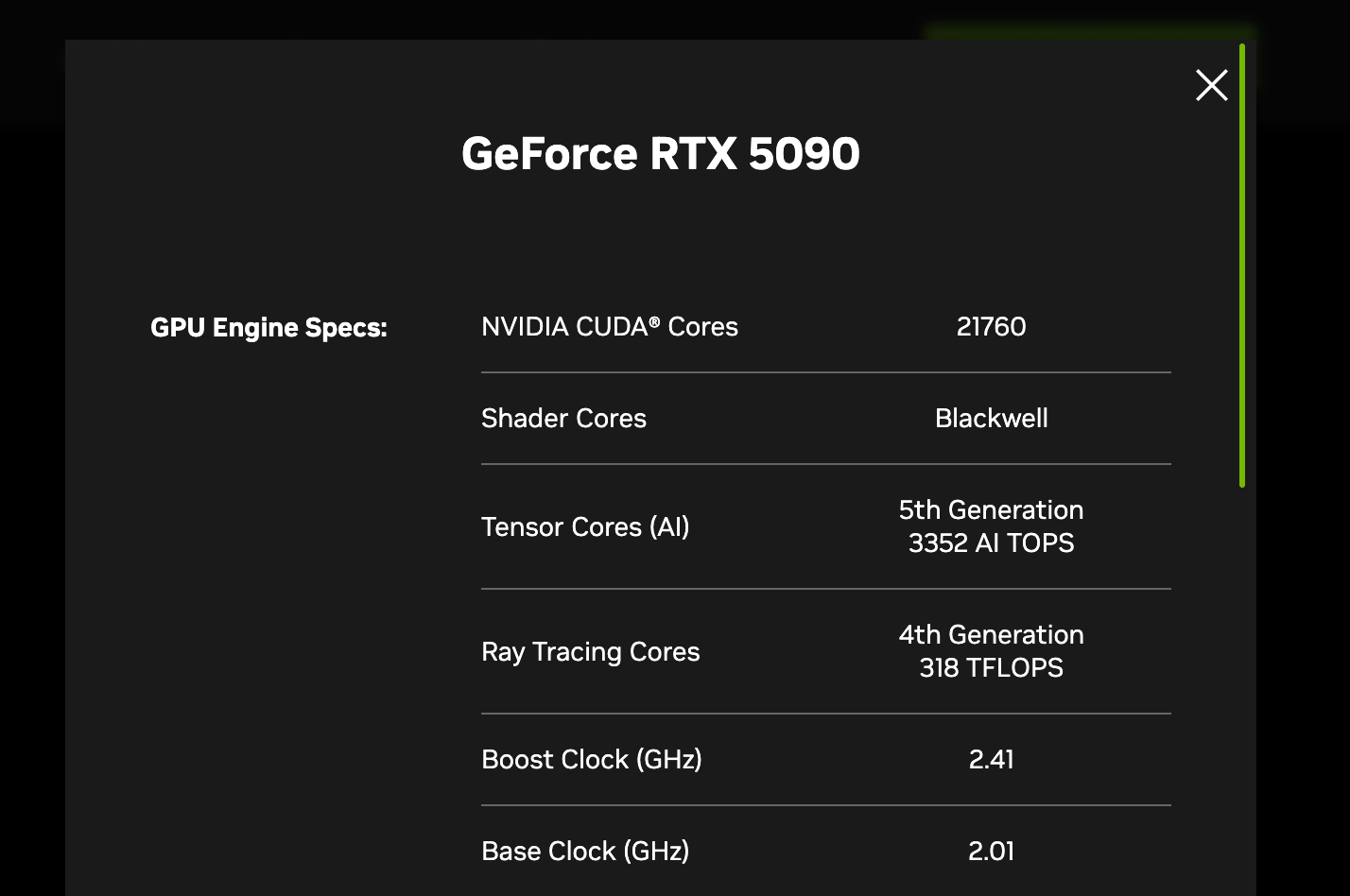

Постепенно видеокарты превращались в вычислительных монстров — сначала с сотнями, а затем и с тысячами ядер. (Для сравнения: новейшая NVIDIA GeForce RTX 5090, анонсированная в начале 2025 года, содержит 21 760 ядер CUDA, тензорные ядра пятого поколения с производительностью 3 352 AI TOPS и ядра для трассировки лучей четвёртого поколения.) Однако применение этих мощностей по-прежнему ограничивалось играми: шейдеры просто не предназначались для иных задач.

Впрочем, это не останавливало наиболее изобретательных учёных.

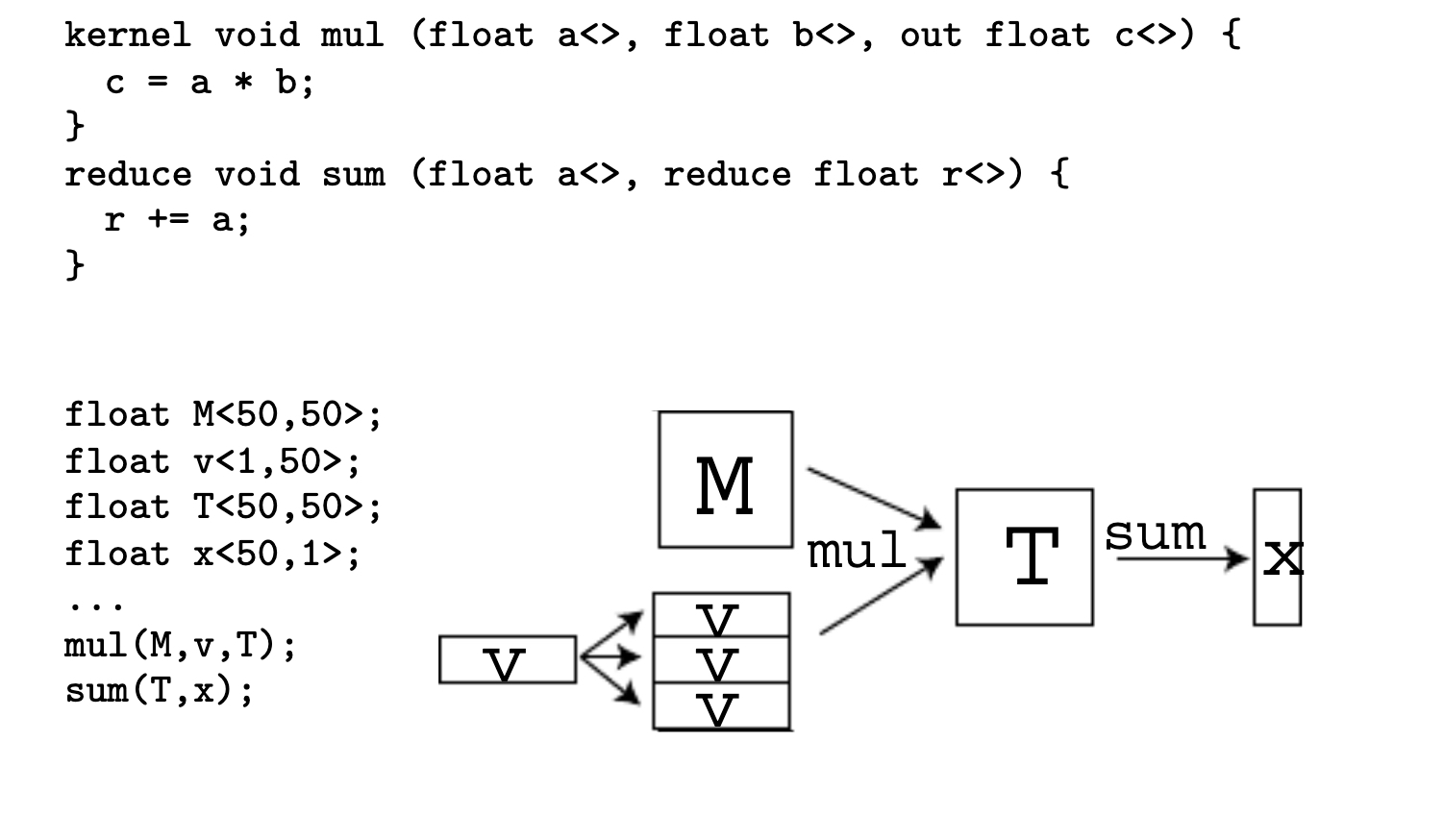

Под видом текстур они загружали в видеопамять расчёты молекул, финансовые модели, физические симуляции и прочие научные вычисления. Этот метод получил название GPGPU — General-Purpose computing on GPU, то есть «универсальные вычисления на графическом процессоре».

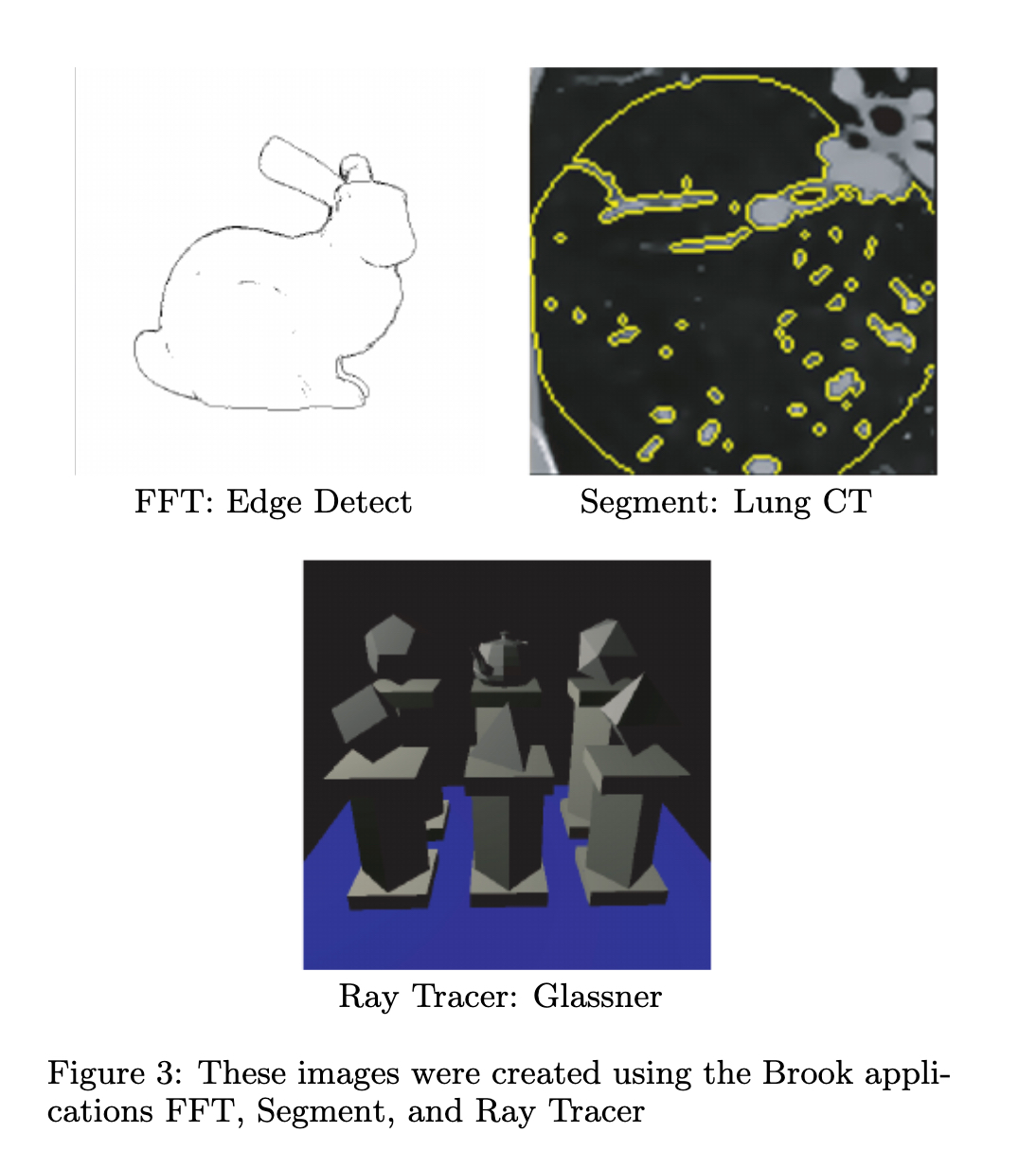

Одним из таких проектов стал BrookGPU, разработанный студентами Стэнфордского университета. В 2003 году они проводили поразительные эксперименты: просчитывали на видеокартах огромные массивы данных в виде параллельных потоков.

Всё это работало через сложнейшие обходные конструкции и многоуровневые абстракции над DirectX и OpenGL. Но даже в таких стеснённых условиях обнаружилось, что некоторые операции — например, сегментация изображений или трассировка лучей — выполняются на GPU до семи раз быстрее, чем на CPU.

В NVIDIA, разумеется, заметили, что их оборудование используют не по прямому назначению. Однако вместо того чтобы пресечь эту деятельность, компания решила поддержать инициативных исследователей — и, будем откровенны, позаимствовать ряд их идей.

Компания наняла ведущего разработчика BrookGPU — Яна Бака (впоследствии занявшего должность вице-президента подразделения Accelerated Computing в NVIDIA). Под его руководством в 2006 году появилась платформа CUDA (Compute Unified Device Architecture) — набор инструментов для разработчиков, который наконец позволил запускать на видеокартах произвольный программный код без каких-либо обходных решений.

Этот шаг принёс NVIDIA триллионы долларов.

Одна за другой появлялись новые библиотеки и инструменты: OpenCL, TensorFlow, вычислительные шейдеры (Compute Shaders). Исследователи и инженеры по всему миру осваивали вычисления на GPU. И в определённый момент мир словно перевернулся.

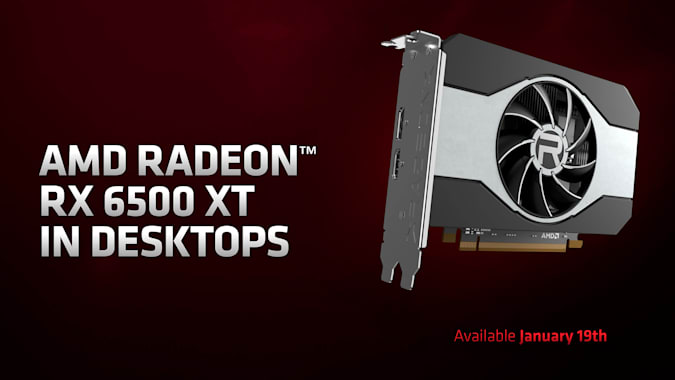

Блокчейн, майнинг криптовалют, нейронные сети, NFT — каждая новая волна технологического ажиотажа усиливала спрос на графические процессоры. Сначала все бросились добывать криптовалюту, затем хлынула волна глубокого обучения нейронных сетей. Цены на видеокарты взлетели до небес, начался жестокий дефицит чипов.

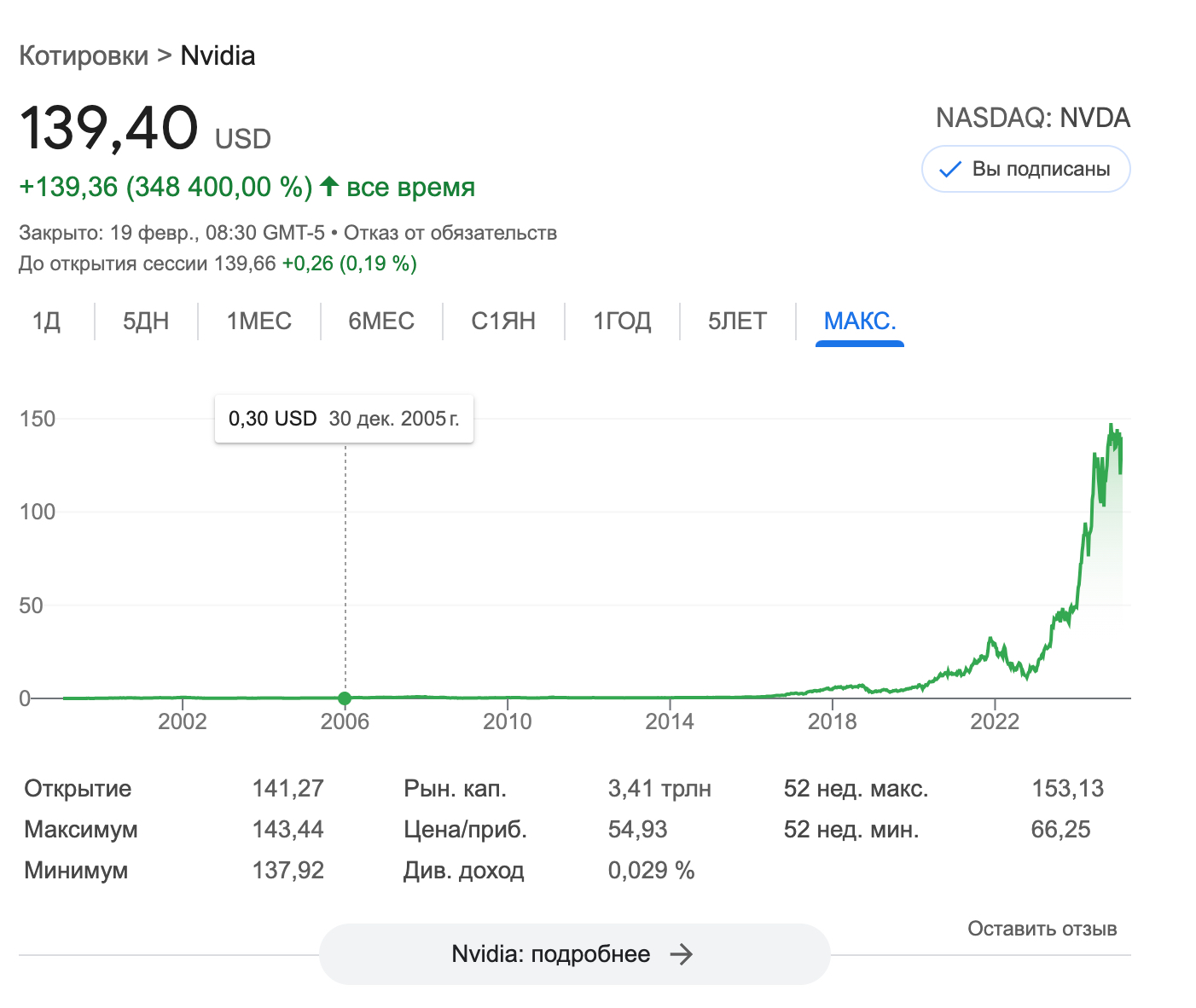

А кто оказался на вершине этой новой реальности? Разумеется, NVIDIA. По состоянию на 2025 год рыночная капитализация компании превышает 3 триллиона долларов, что делает её одной из самых дорогих корпораций в мире.

По существу, видеокарты сегодня достаются всем — дата-центрам, исследовательским лабораториям, майнерам, — но только не тем, для кого они создавались изначально: игрокам. «Вы обещали нам красивую графику, а подсунули Скайнет», — иронизируют геймеры в интернете.

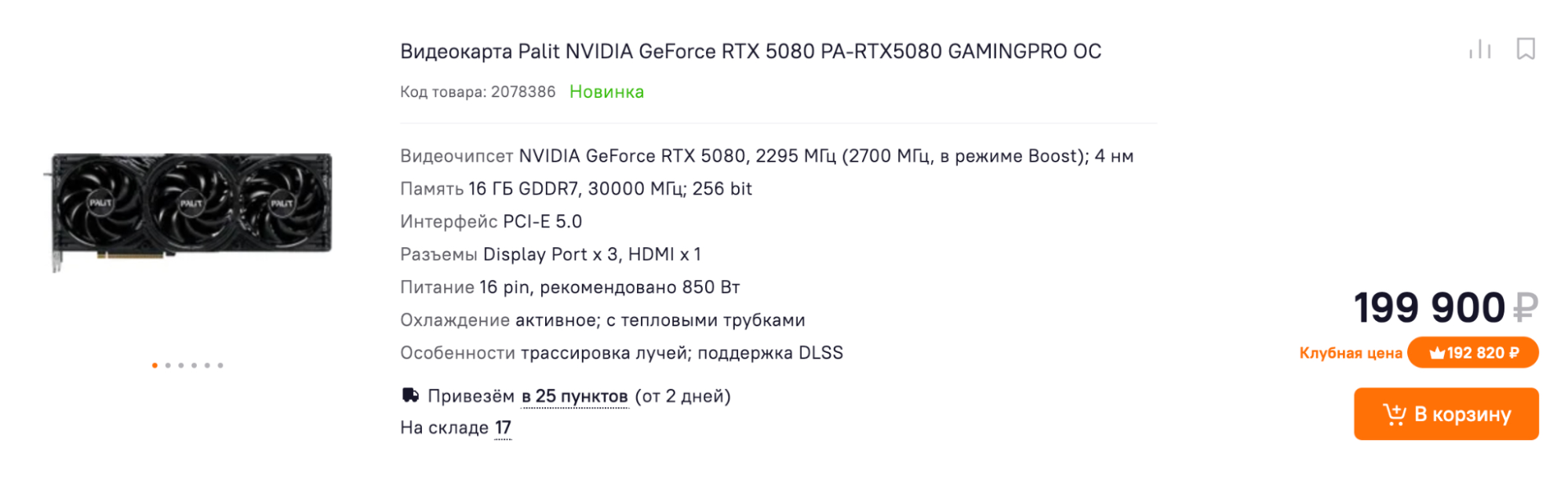

И в самом деле: когда стоимость топовых видеокарт, таких как NVIDIA GeForce RTX 5080, достигает шестизначных сумм в рублях, невольно задумываешься — до игр ли тут, если за те же деньги можно развернуть локальную нейросеть?

Впрочем, искусственный интеллект, судя по всему, ждать не намерен.

Из виртуального мира — в реальный

Подобно Нео из «Матрицы», осознавшему, что он способен изменять мир по своему желанию, шейдеры — сначала преобразив виртуальную реальность игр — теперь переписывают правила в мире реальном.

Большие языковые модели, системы искусственного интеллекта, автономные роботы, беспилотные автомобили — всё это стремительно перекраивает экономику, культуру и рынок труда. И всё это, в конечном счёте, стало возможным благодаря той самой маленькой технологии, которая когда-то была придумана для того, чтобы пиксели на экране выглядели чуть красивее.

Быть может, старшее поколение было право, утверждая, что игры до добра не доведут? А быть может, напротив, — именно игры и технологии, рождённые в их недрах, спасут человечество от его собственных ограничений.

Послесловие: ирония истории

Напоследок стоит обратить внимание на любопытный исторический поворот. Когда-то индустрия решительно отказалась от фиксированного конвейера в пользу универсальных программируемых ядер. Однако сегодня NVIDIA вновь делает ставку на специализированные аппаратные блоки: RT-ядра для аппаратной трассировки лучей и тензорные ядра для работы технологии DLSS и задач машинного обучения.

Пока эта стратегия приносит плоды: линейка видеокарт RTX пользуется огромным спросом. Но сумеет ли Дженсен Хуанг вовремя распознать момент, когда специализация перестанет быть конкурентным преимуществом? Или же компания рискует попасть в ту же ловушку, которая в своё время погубила её предшественников — 3dfx, S3 и Matrox?

История, как известно, развивается по спирали. И то, какой виток ждёт NVIDIA и всю индустрию впереди, покажет время.