Почти все современные компьютеры устроены по одному принципу, придуманному в середине прошлого века. Этот принцип блестяще работал десятилетиями, но в эпоху искусственного интеллекта превратился из магистрали прогресса в системное ограничение. На смену ему приходит нечто принципиально иное — архитектура, вдохновлённая самым экономичным и производительным вычислительным устройством из всех известных нам: человеческим мозгом.

Вундеркинд из Будапешта и документ, изменивший мир

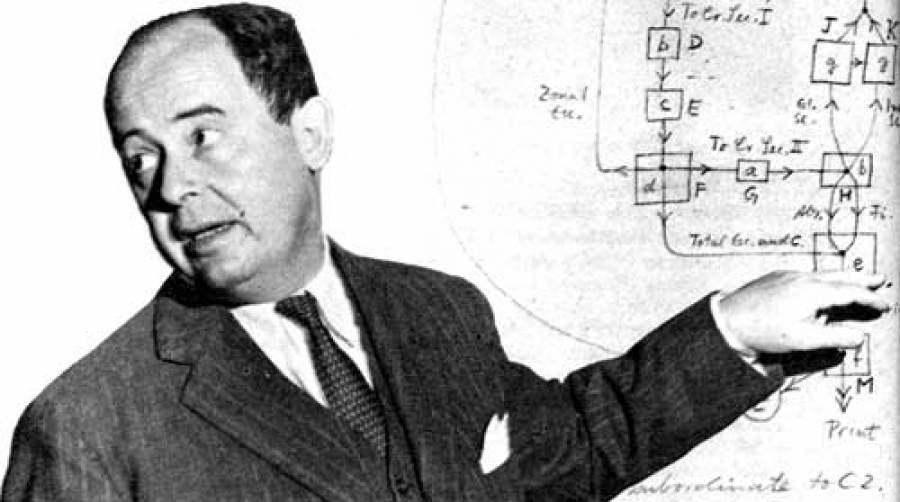

В 1903 году в Будапеште родился мальчик по имени Янош Нейман. Уже в шесть лет он оперировал восьмизначными числами в уме. В восемь вёл беседы с отцом на древнегреческом. В девятнадцать предложил современное математическое определение порядковых чисел. В двадцать три защитил докторскую диссертацию. К двадцати пяти годам вошёл в число самых ярких молодых учёных Европы, внеся вклад в квантовую механику и математическую логику.

Позже этот человек — вошедший в историю под именем Джон фон Нейман — создаст теорию игр, изменит облик экономики, примет участие в Манхэттенском проекте и оставит след в областях от квантовой физики до гидродинамики. Но для понимания современной вычислительной техники важнее всего то, что он придумал в 1944–1945 годах. Подключившись к проекту ENIAC — разработке первого в мире лампового компьютера — фон Нейман немедленно обнаружил его главный изъян: программа была намертво вшита в схему машины. Чтобы изменить алгоритм, инженерам приходилось буквально перепаивать провода.

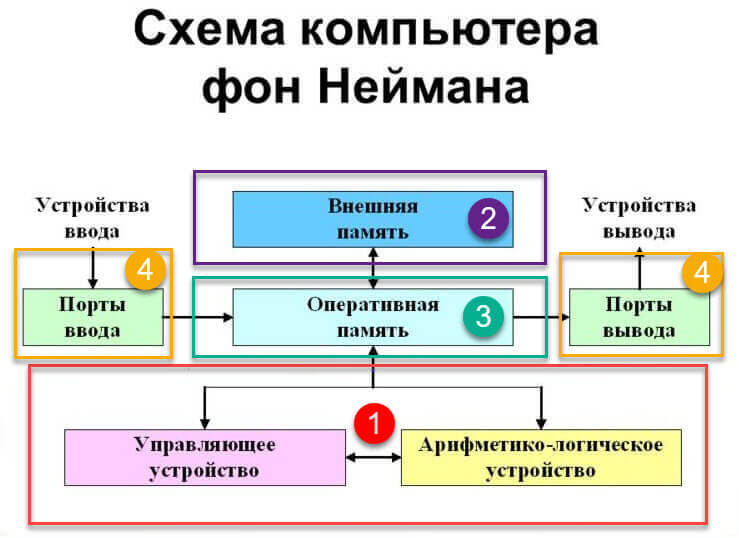

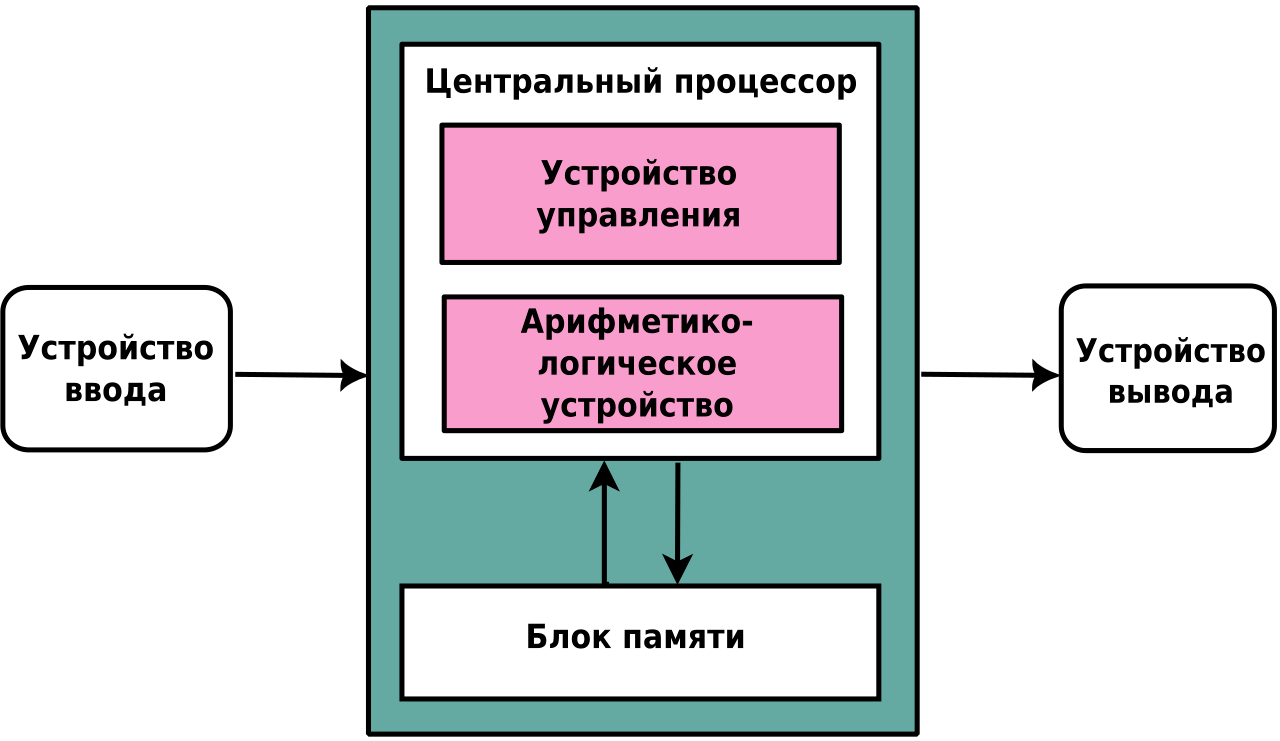

В 1945 году фон Нейман изложил своё решение в черновике технического отчёта объёмом 101 страница. Документ так и не был закончен, однако именно он изменил облик всего XX века. В нём впервые была сформулирована концепция компьютера с хранимой программой: мозг вычислительной машины и её память разделены, данные передаются через общую шину, а инструкции хранятся в той же памяти, что и обрабатываемые данные. Эта простая и строгая схема вошла в историю как архитектура фон Неймана. Она подарила миру универсальные вычислительные машины, которые можно перепрограммировать под любые задачи без изменения аппаратной части.

Архитектура фон Неймана: гениальность и её цена

Чтобы понять, почему эта архитектура сегодня превращается в ограничение, нужно разобраться в её основах. В её фундаменте лежат две ключевые идеи: разделение и ритм. До фон Неймана программа и машина были единым целым — алгоритм задавался физической конфигурацией схемы. Фон Нейман предложил разделить вычислительное устройство и память: процессор последовательно извлекает инструкции из памяти, обрабатывает их и возвращает результат обратно. Из этого разделения естественным образом вытекает ритм: чтобы всё работало слаженно, инструкции должны выполняться в строгом порядке — извлечение, декодирование, выполнение — синхронизированном тактовым генератором.

Архитектура фон Неймана работает как идеальный конвейер на заводе: каждая операция выполняется строго в своё время, в едином ритме. У этого подхода три очевидных достоинства. Универсальность: одна и та же машина способна выполнять любую задачу — достаточно загрузить новый код. Масштабируемость: добавляй память и ядра, разгоняй тактовую частоту — производительность будет расти. Гибкость: можно усложнять микроархитектуру, подключать специализированные сопроцессоры, и всё будет работать. Практически вся цифровая электроника второй половины XX и начала XXI века жила по законам фон Неймана — и не знала бед. До тех пор, пока не появились глубокие нейросети.

Две стены, в которые упёрся прогресс

Искусственный интеллект обнажил два фундаментальных ограничения нейманновской архитектуры, которые прежде не давали о себе знать в полную силу.

Первое — так называемое бутылочное горлышко фон Неймана. Разделив процессор и память, архитектура неизбежно создала узкое место: данные всё время нужно перегонять из памяти в процессор и обратно. Этот постоянный обмен порождает задержки и простои. Чем больше данных нужно обработать, тем острее проблема. Современные высокопроизводительные процессоры большую часть времени попросту ждут данные, а не вычисляют — они простаивают в ожидании, пока шина доставит следующую порцию.

Второе ограничение — энергопотребление. Конвейер нельзя полностью остановить: даже если никаких полезных вычислений не производится, тактовый генератор продолжает работать, тратя электричество. Но главная статья расходов — не сами вычисления, а логистика данных. В современных дата-центрах и суперкомпьютерах до 90% всей потребляемой энергии уходит не на обработку информации, а на её транспортировку по шине между памятью и процессором. Обучение языковой модели масштаба GPT-4 потребовало столько электроэнергии, сколько небольшой город потребляет за целый год. После обучения модели продолжают расходовать ресурсы при каждом запросе. Развитие идёт по нарастающей: каждое следующее поколение моделей не просто умнее, но и существенно прожорливее предыдущего — и уже сейчас не вполне ясно, откуда брать энергию для обучения следующих поколений.

Для сравнения: современные экзафлопсные суперкомпьютеры — самые мощные вычислительные машины в мире — потребляют порядка 20 мегаватт электроэнергии. Человеческий мозг выполняет сопоставимые по сложности задачи при потреблении всего около 20 ватт — в миллион раз меньше. При этом мозг параллельно обрабатывает потоки информации от всех органов чувств, управляет телом, формирует речь и принимает решения — в реальном времени, без тактового генератора, реагируя на события за миллисекунды. Это даёт очевидную подсказку, в каком направлении искать выход.

Что такое нейроморфные вычисления

Сам термин «нейроморфный» означает «подобный нейронам». Архитектура таких чипов вдохновлена строением и принципами работы биологического мозга. Чтобы понять её устройство, нужно сначала разобраться в том, как работает мозг на уровне базовых элементов.

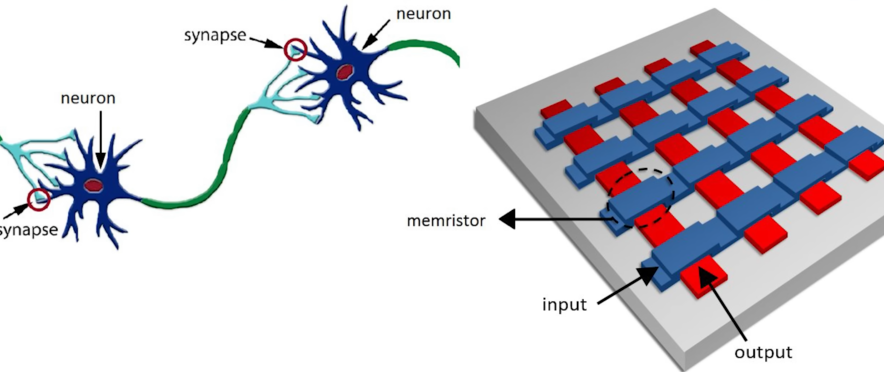

Основу мозга составляют нейроны — биологические нервные клетки. У каждого нейрона есть множество входящих отростков, называемых дендритами: через них к нейрону поступают электрические сигналы от других нейронов через соединения — синапсы. Каждый синапс способен усиливать или ослаблять сигнал. Когда суммарный входящий сигнал превышает некоторый пороговый уровень, нейрон генерирует спайк — короткий электрический импульс — и передаёт его дальше по цепи к другим нейронам. Всё остальное время нейрон молчит.

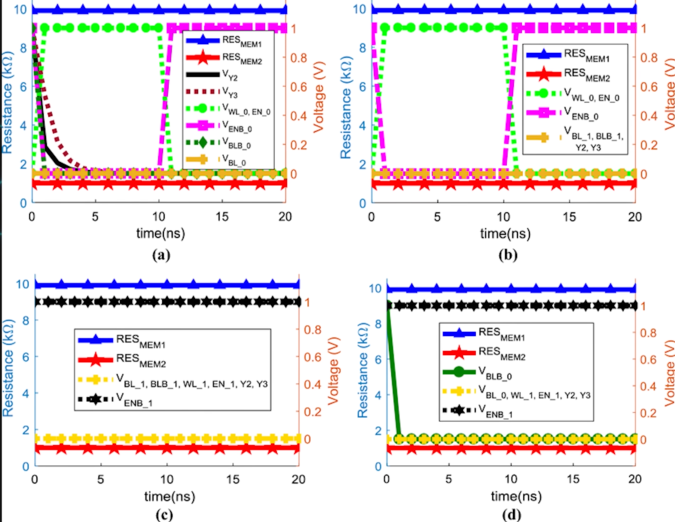

Нейроморфные чипы воспроизводят эту архитектуру на аппаратном уровне. Ключевой элемент, отличающий их от классических процессоров, — мемристор (от слов memory и resistor). Это программируемый резистор, работающий наподобие синапса: он способен запоминать протекавший через него заряд, изменяя собственное сопротивление. Когда через мемристор проходит ток, его сопротивление может возрастать или убывать. После отключения питания он сохраняет последнее записанное состояние. Такое поведение воспроизводит пластичность биологических синапсов — их способность усиливаться или ослабевать в зависимости от накопленного опыта.

Именно благодаря свойствам мемристора — и прежде всего их количеству и способу соединения — нейроморфная архитектура позволяет отказаться от строгого тактового ритма. Искусственный нейрон бездействует большую часть времени, отслеживая входящие сигналы. Как только их суммарная величина достигает порогового уровня, нейрон «выстреливает» спайком и рассылает его множеству других нейронов — в точности повторяя логику биологического мозга. Синаптические связи усиливают или ослабляют передаваемые сигналы в зависимости от того, на чём была обучена сеть. Память и вычисление в такой архитектуре не разделены — они происходят в одном месте, локально, без необходимости гонять данные через общую шину.

Три главных преимущества: скорость, параллелизм и экономия энергии

В сравнении с классическими чипами нейроморфная архитектура предлагает три принципиальных преимущества. Первое — быстродействие. В традиционном конвейере нужно ждать, пока освободится процессор и поступят данные из памяти. В нейроморфной системе нейрон посылает сигнал немедленно, как только произошло значимое событие, не дожидаясь тактового цикла. Как и в живых организмах, решения принимаются за считанные миллисекунды.

Второе преимущество — массовый параллелизм. Все нейроны работают одновременно, каждый на своём участке, независимо от происходящего в других частях чипа. Сеть обрабатывает множество сигналов одновременно, не выстраивая их в очередь. Это принципиально отличает нейроморфные вычисления от GPU, где параллелизм достигается за счёт огромного числа однотипных ядер, работающих по единому расписанию.

Третье — и, пожалуй, самое важное для текущего момента — феноменальная энергетическая эффективность. В нейроморфных чипах энергия расходуется только на активные элементы и только в момент их активности. Нейрон потребляет её лишь при генерации импульса; в остальное время он молчит. Большинство нейронов в каждый конкретный момент неактивны. Это кардинально отличается от классического процессора, который тратит энергию непрерывно — на поддержание тактового ритма и на транспортировку данных, вне зависимости от того, производятся полезные вычисления или нет.

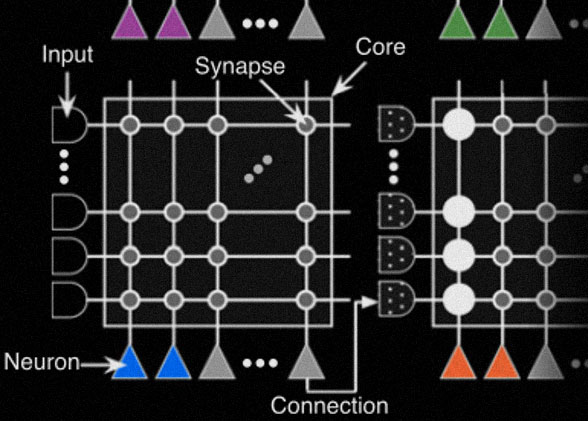

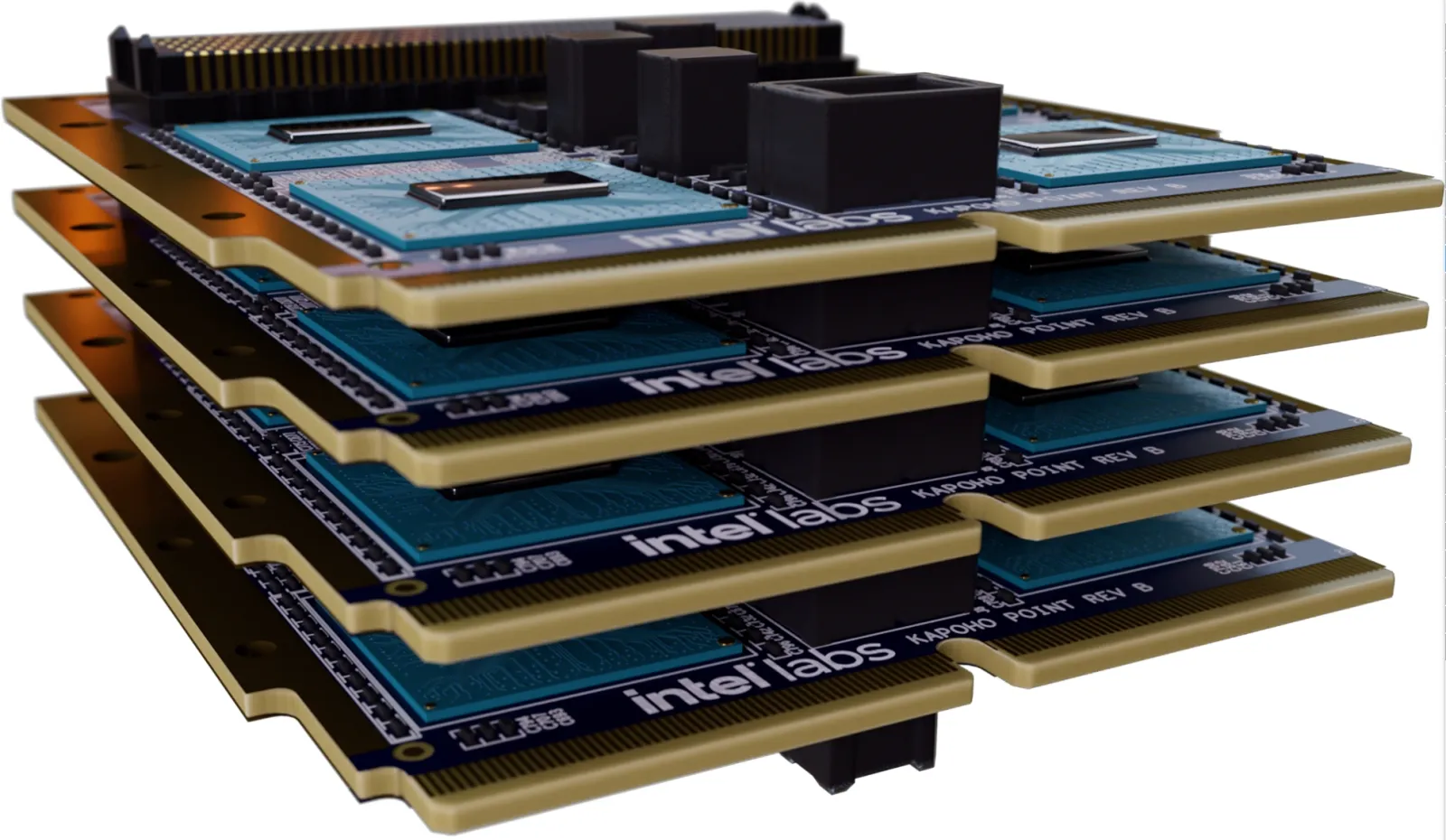

Intel Loihi и Hala Point: от лаборатории к рекордным системам

Среди разработчиков нейроморфных чипов особого внимания заслуживает Intel. Компания сделала ставку на цифровые нейроны и уже выпустила второе поколение исследовательского процессора Loihi 2. Один такой чип содержит один миллион программируемых нейронов и 120 миллионов синапсов, распределённых по 128 полностью асинхронным ядрам. По сравнению с первым поколением скорость обработки спайков выросла до 10 раз, скорость синаптических операций — в пять раз. Loihi 2 произведён на техпроцессе Intel 4 и занимает вдвое меньшую площадь при вдвое большей ёмкости.

В 2024 году Intel сделала следующий шаг: объединила 1 152 чипа Loihi 2 в единую систему под названием Hala Point — крупнейшую нейроморфную систему в мире на сегодняшний день. Система размером с микроволновую печь содержит 1,15 миллиарда нейронов и 128 миллиардов синапсов, распределённых по 140 544 нейроморфным ядрам. Максимальное потребление энергии — 2 600 ватт. Для сравнения: традиционный суперкомпьютер с сопоставимыми возможностями потребовал бы на несколько порядков больше. Первый экземпляр Hala Point был развёрнут в Национальной лаборатории Сандии и открыт для исследовательского сообщества.

В 2025 году исследователи опубликовали результаты, демонстрирующие, что нейроморфные принципы применимы даже к большим языковым моделям: запуск упрощённой архитектуры языковой модели на Loihi 2 обеспечил втрое более высокую производительность при вдвое меньшем потреблении энергии по сравнению с граничным GPU, и ожидается дальнейшее улучшение по мере оптимизации. Согласно более ранним тестам на прикладных задачах граничных вычислений, нейроморфные решения на базе Loihi демонстрировали скорость до 1 000 раз выше и энергоэффективность до 10 000 раз лучше, чем традиционные CPU на аналогичных задачах.

IBM также была в авангарде нейроморфных разработок на ранних этапах и сформировала свой подход, сосредоточившись на аппаратных имитациях биологических нейронов. Китайские университеты и исследовательские центры ведут собственные разработки. Ситуация сегодня напоминает ранние годы авиации: в разных уголках мира группы инженеров пробуют различные подходы к созданию электронного мозга, и никто пока не монополизировал эту область.

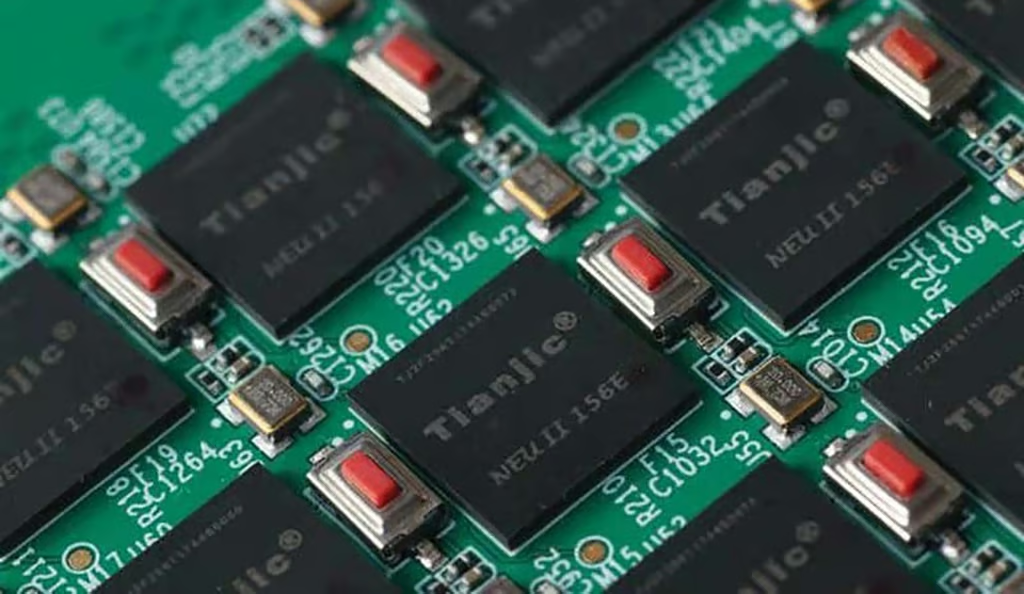

Реальные результаты: самоуправляемый велосипед и электронная кожа

Нейроморфные чипы — не абстрактная теория. Существуют демонстрации, которые наглядно показывают потенциал технологии. В 2019 году китайские учёные, используя нейроморфный чип Tianjic собственной разработки, создали полностью автономный велосипед. Машина удерживает равновесие, объезжает препятствия, реагирует на голосовые команды и следует за человеком. По сути, это демонстрация зачатков искусственного разума на колёсах — и всё это потребляет меньше энергии, чем смартфон. Принципиальный результат эксперимента: один компактный чип одновременно выполнял несколько принципиально разных алгоритмов — балансировку, компьютерное зрение и распознавание речи — в реальном времени, как маленький мозг.

Другой впечатляющий пример — электронная кожа. В 2020 году команда Национального университета Сингапура представила систему тактильных сенсоров ACES (Asynchronous Coded Electronic Skin), подключённую к нейроморфному процессору Intel Loihi. Эта плёнка с датчиками реагирует на прикосновение мгновенно: она различает силу нажатия, форму и текстуру предмета за десять миллисекунд — более чем в тысячу раз быстрее, чем человеческая нервная система. Система способна распознавать различные материалы и степень твёрдости объектов. Исследователям уже удалось с помощью такой кожи распознавать шрифт Брайля. Нейроморфный чип обрабатывает потоки импульсов от датчиков и на ходу классифицирует ощущения — именно так, как это делает кожный рецептор вместе с нервной системой.

Где это применяется уже сейчас — и почему роботы в центре внимания

Нейроморфные чипы не претендуют на то, чтобы заменить обычные процессоры в смартфонах или ноутбуках. Их ниша — задачи, где критичны локальная обработка данных в реальном времени и жёсткие ограничения по энергопотреблению. Наиболее очевидное применение — робототехника. Нейроморфные процессоры позволяют непосредственно на борту робота анализировать потоки сигналов с камер, лидаров, микрофонов и тактильных датчиков, мгновенно реагируя на изменения обстановки.

Робот с нейроморфным «мозгом» способен быть значительно более ловким и чутким. Для сравнения: компании вроде Boston Dynamics потратили колоссальные ресурсы и годы работы лучших инженеров, чтобы научить своих роботов убедительно стоять и передвигаться с помощью классических вычислительных архитектур. Нейроморфный подход потенциально позволяет достичь сопоставимых результатов значительно эффективнее.

Помимо робототехники, очевидны перспективы в области умных сенсоров и систем технического зрения, которые должны работать автономно с минимальным энергопотреблением, медицинских протезов, требующих мгновенной реакции на нервные сигналы, граничных вычислений для Интернета вещей, где каждый микроватт на счету, и автономных транспортных систем. В отличие от квантовых компьютеров, которые пока во многом остаются в теоретической плоскости, нейроморфные чипы уже переходят в практическую: работающие прототипы существуют, первые коммерческие и исследовательские системы развёрнуты.

Ограничения и нерешённые задачи

При всей привлекательности подхода нейроморфная революция не случится за один день. Технология сталкивается с рядом реальных ограничений. Первое — масштаб. Самый продвинутый на сегодня нейроморфный чип — Intel Loihi 2 в составе системы Hala Point — содержит 1,15 миллиарда нейронов.

Звучит внушительно, но человеческий мозг располагает примерно 86 миллиардами нейронов и около 100 триллионами синапсов. Разница в объёме памяти и связности — миллионы раз. Нынешние нейроморфные системы по вычислительным возможностям сопоставимы скорее с мозгом насекомого или небольшого животного. Создать полноценную мозгоподобную машину на современной кремниевой базе чрезвычайно сложно.

Второе ограничение — программный стек. Полная смена архитектуры требует пересмотра всего, что на ней строится. Нейроморфную сеть нельзя программировать так же, как обычный процессор: нельзя написать последовательность инструкций для спайковой сети так, как пишется код для CPU. Необходимы принципиально иные алгоритмы обучения спайковых нейронных сетей и новые подходы к кодированию информации в виде последовательностей импульсов. Пока эти методы находятся в стадии активного исследования, а инструменты разработки — такие как открытый фреймворк Lava от Intel — только формируются.

Третье — инженерные и производственные вопросы. Как наладить массовое производство нейроморфных чипов, снизить их стоимость и обеспечить простую интеграцию в конечные устройства? Пока это удел специализированных лабораторий и отдельных компаний, а не серийного выпуска.

Не замена, а новый инструмент в арсенале инженера

Мир вычислений десятилетиями двигался по рельсам, проложенным фон Нейманом: быстро, универсально, предсказуемо. Но сегодня главным тормозом оказалась не математика, а логистика — перевозка битов туда и обратно между памятью и процессором. Мы тратим огромные количества электроэнергии на транспортировку данных, тогда как собственно вычисления занимают лишь малую долю этих затрат. Это похоже на попытку прочитать одну страницу, перевозя ради этого всю библиотеку целиком.

Нейроморфная архитектура предлагает принципиально иной маршрут: событийность вместо тактов, локальная обработка вместо дальних поездок по шине. Нейрон молчит, пока не произойдёт нечто значимое, — и реагирует за миллисекунды. Энергия уходит не на ожидание, а на смысл. Это не полная замена существующей вычислительной экосистемы — это новый инструмент в арсенале инженера. Особенно там, где решают скорость реакции и автономность: роботы, медицинские протезы, сенсоры, умные камеры, автономные системы. В будущем гибридные архитектуры, где классические CPU и GPU работают рядом с нейроморфными сопроцессорами, представляются весьма вероятным сценарием.

Технология ещё молода и требует решения ряда серьёзных задач. Но уровень сложности этих задач — в отличие от, например, масштабирования квантовых вычислений — не является запредельным. Рабочие прототипы существуют. Первые крупные системы развёрнуты. Результаты обнадёживают. Возможно, мы стоим в начале того же пути, что прошли полупроводниковые транзисторы в 1950-х или персональные компьютеры в 1970-х: от лабораторной диковинки до технологии, изменившей повседневную жизнь.