Насколько сложно что-либо смоделировать? Ну вот допустим – воду, текущую по трубе, сложно смоделировать? Или воду, которую наливают в стакан?

Вообще, не очень. В современном мире такую компьютерную, и в целом довольно реалистичную физическую модель, может построить даже школьник на практически любом компьютере!

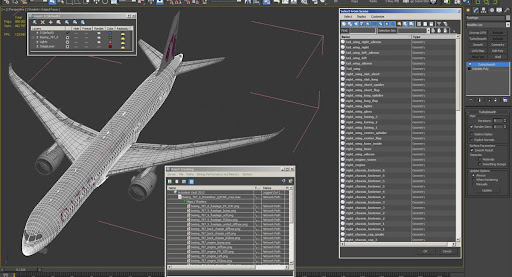

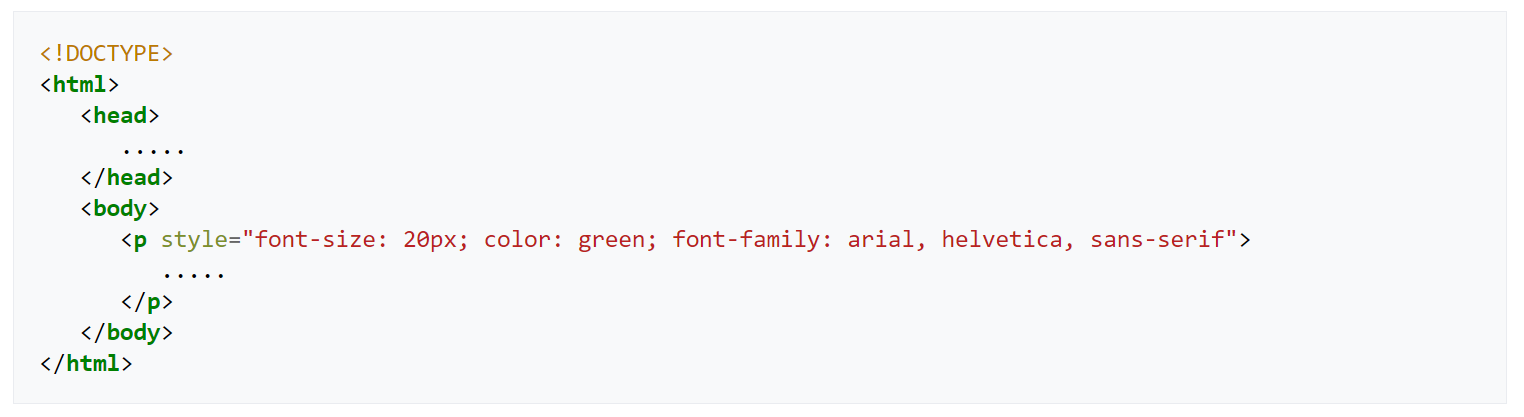

Установил себе какой-нибудь специальный пакет, типа 3D Studio MAX или SolidWorks, и моделируй себе сколько захочешь. 3D Studio Max выдаст тебе красивую картинку, а SolidWorks позволит рассчитать скорость потока, давление и прочие физические параметры. А ведь в реальности задачка то не самая простая, за каждой такой моделью стоит сложная математика!

Еще 25 лет назад такое моделирование казалось на грани фантастики! Не хватало ни вычислительных мощностей, ни просто программных решений. А что сейчас?

А сейчас NVIDIA анонсирует, что хочет создать модель всей Земли! Да именно так — просто смоделировать всю нашу планету! По сути, создать ее цифрового клона! Зачем? Сейчас расскажем!

Зачем моделировать?

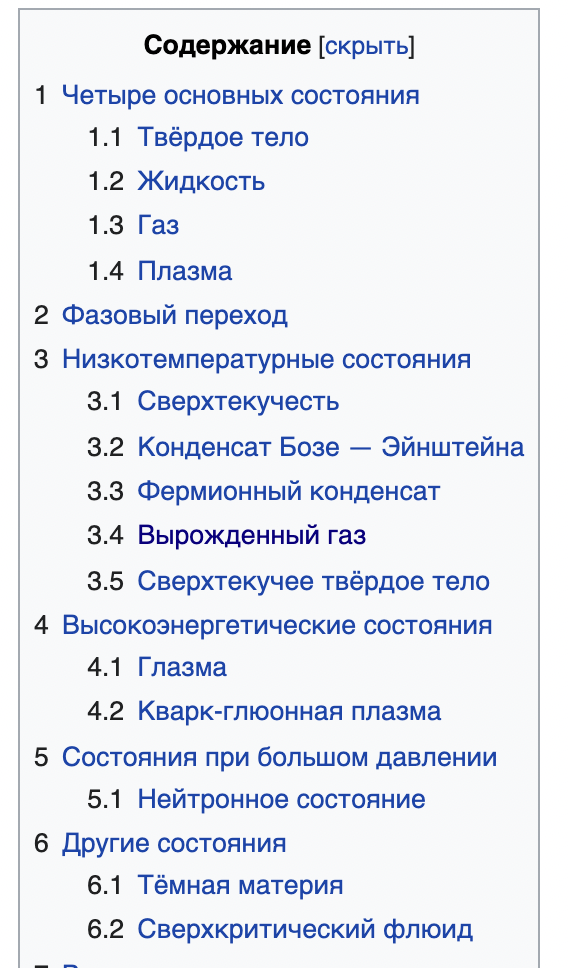

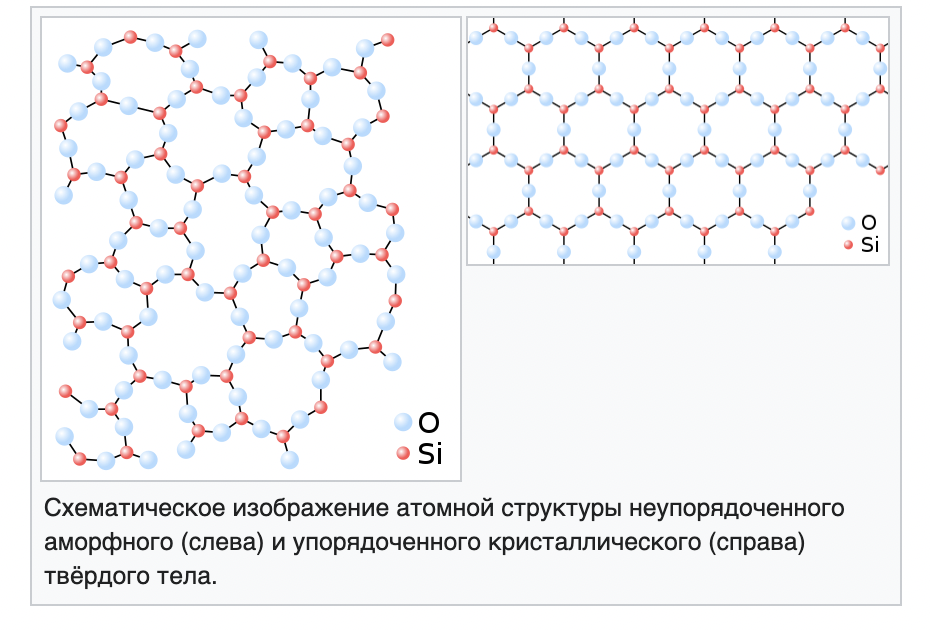

Моделирование уже давно стало отдельной областью исследований и разработки. Оно само по себе подразделяется на целую кучу разных областей, начиная от молекулярной динамики, которая занимается моделированием систем на атомарном уровне и заканчивая моделированием погоды или например структуры зданий! Сегодня просто невозможно недооценивать важность моделирования.

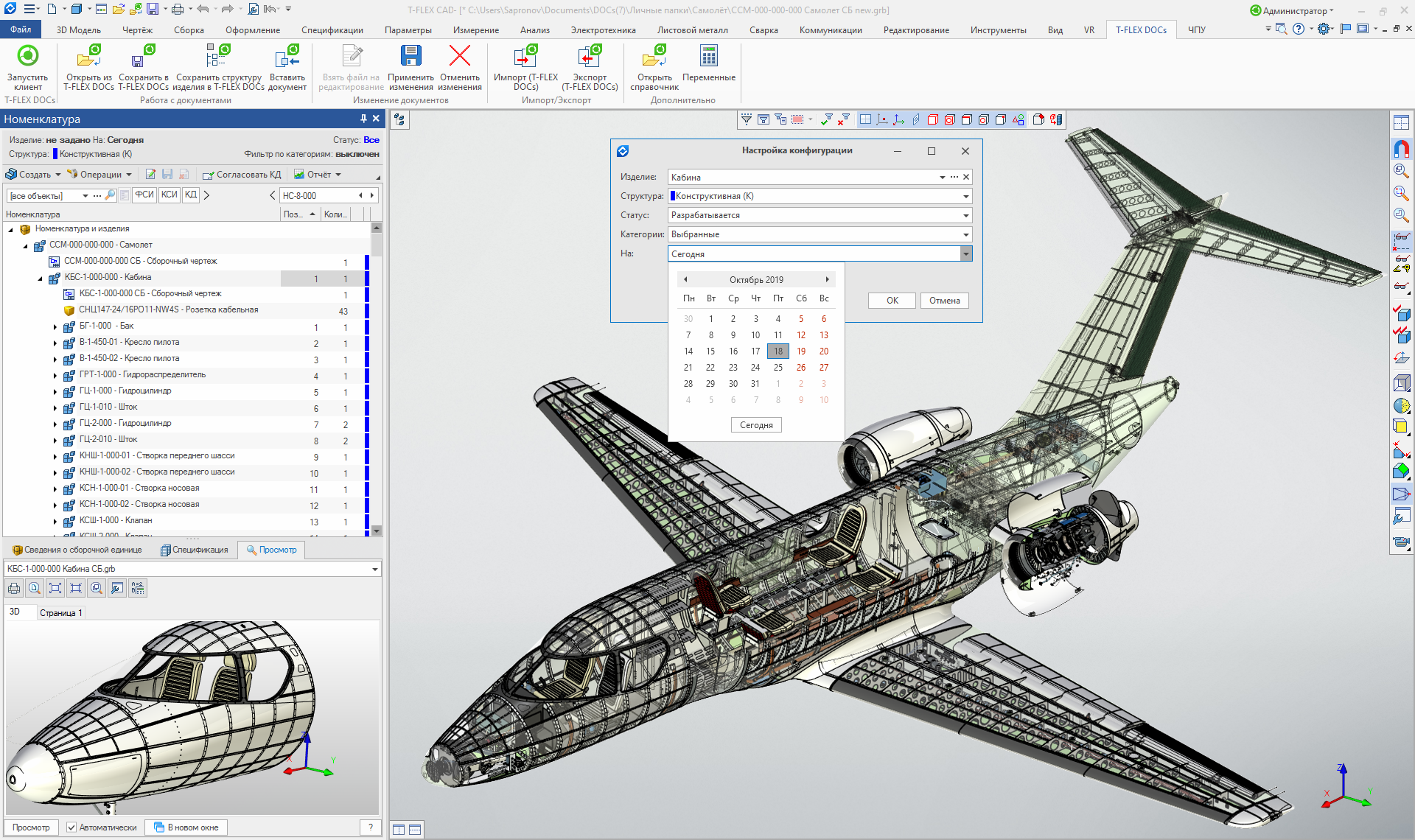

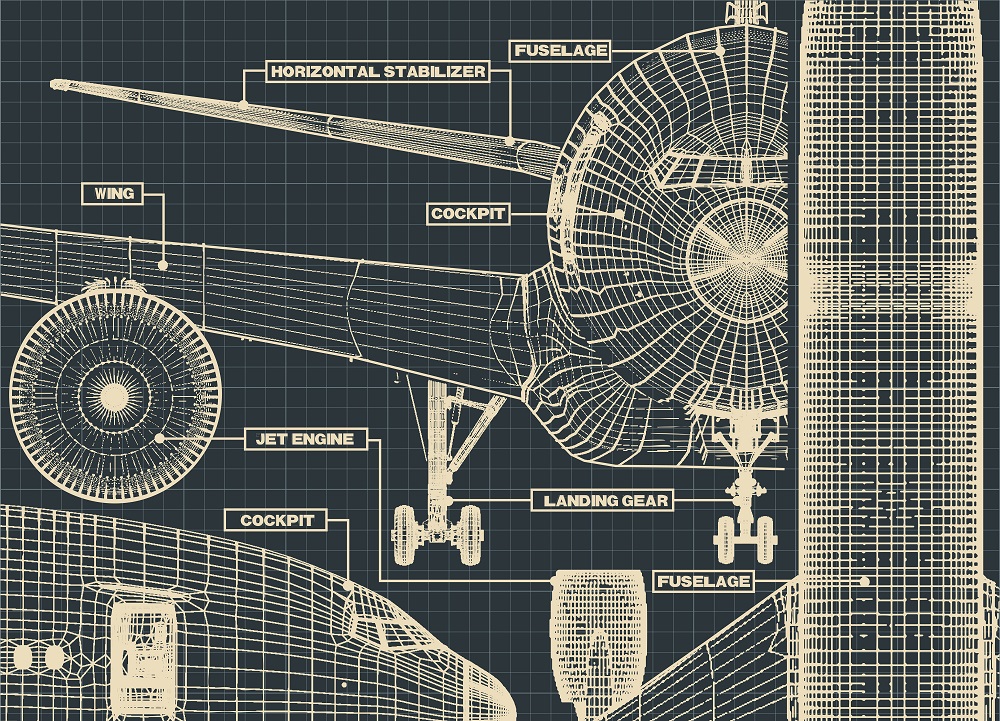

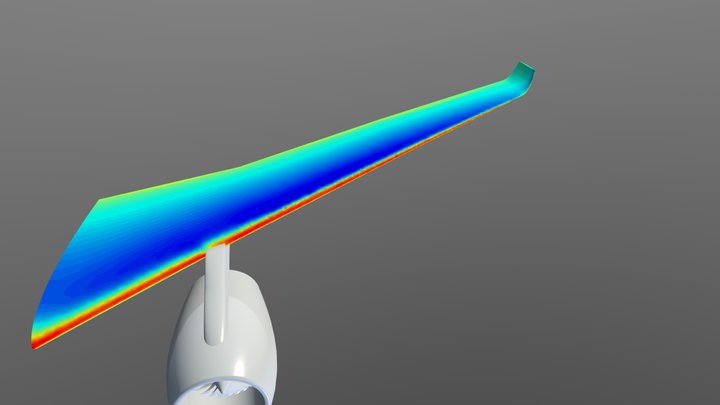

Причем я сейчас говорю даже не о создании 3D-модельки танка для какой-нибудь популярной игры, что кстати само по себе сложная и кропотливая работа 3D-дизайнеров, а например о моделировании крыльев и фюзеляжа для современных самолетов.

Только вдумайтесь насколько сложные задачи человечество научилось решать с помощью создания компьютерных моделей.

Необходимо точно рассчитать потоки воздуха, влияние температур, нагрузки, вес самолета, и многое-многое другое.

Это бесконечно сложная задача с огромным количеством тонкостей и нюансов, при этом каждый параметр очень важен и все они влияют друг на друга. А еще надо симулировать все очень точно, ведь от этого зависят жизни людей.

И при этом даже такие сложные вычисления все равно позволяют, во-первых, сильно экономить при производстве, а во-вторых находить новые интересные решения для различных задач.

Возвращаясь к примеру того же самолета — например Boeing при создании своего знаменитого 787 Dreamliner создал его точную 3D-модель с каждым винтиком и проводом! И не просто создали 3D-модель, а также провели целую гору симуляций, которые позволили 787-му стать самым современным и продвинутым самолетов в истории!

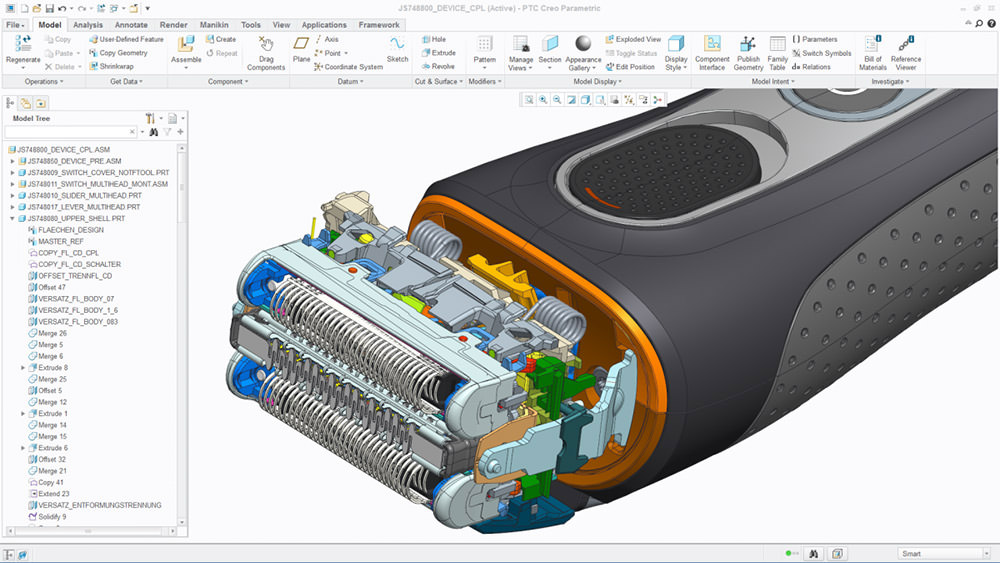

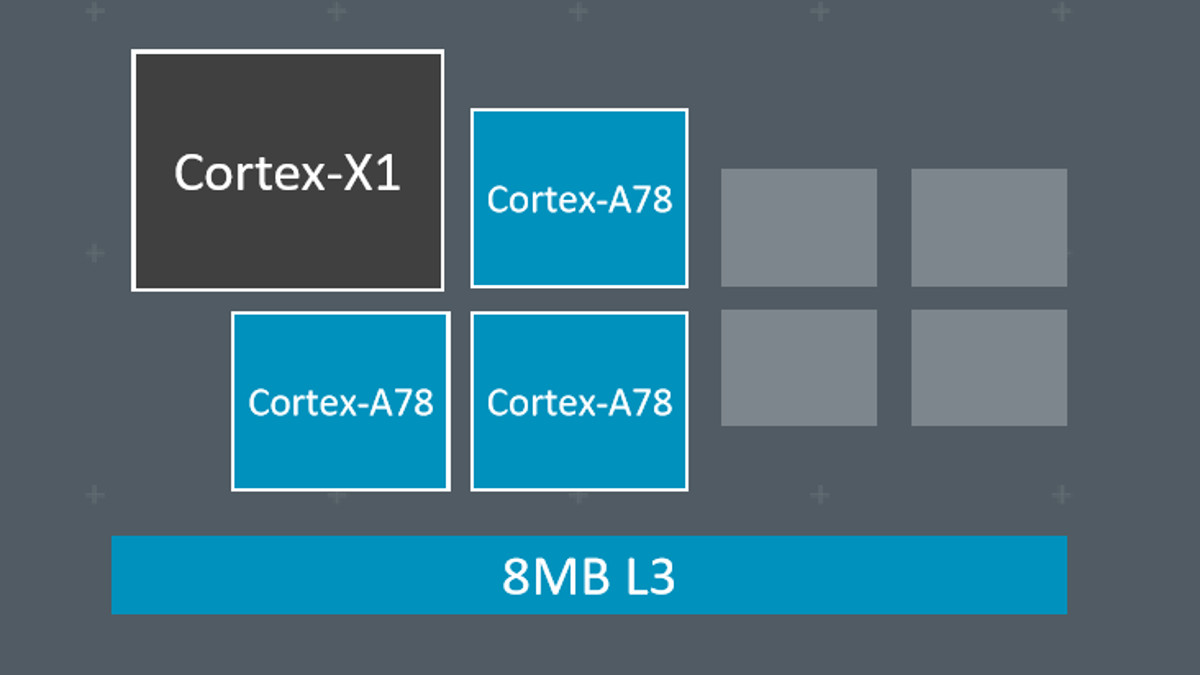

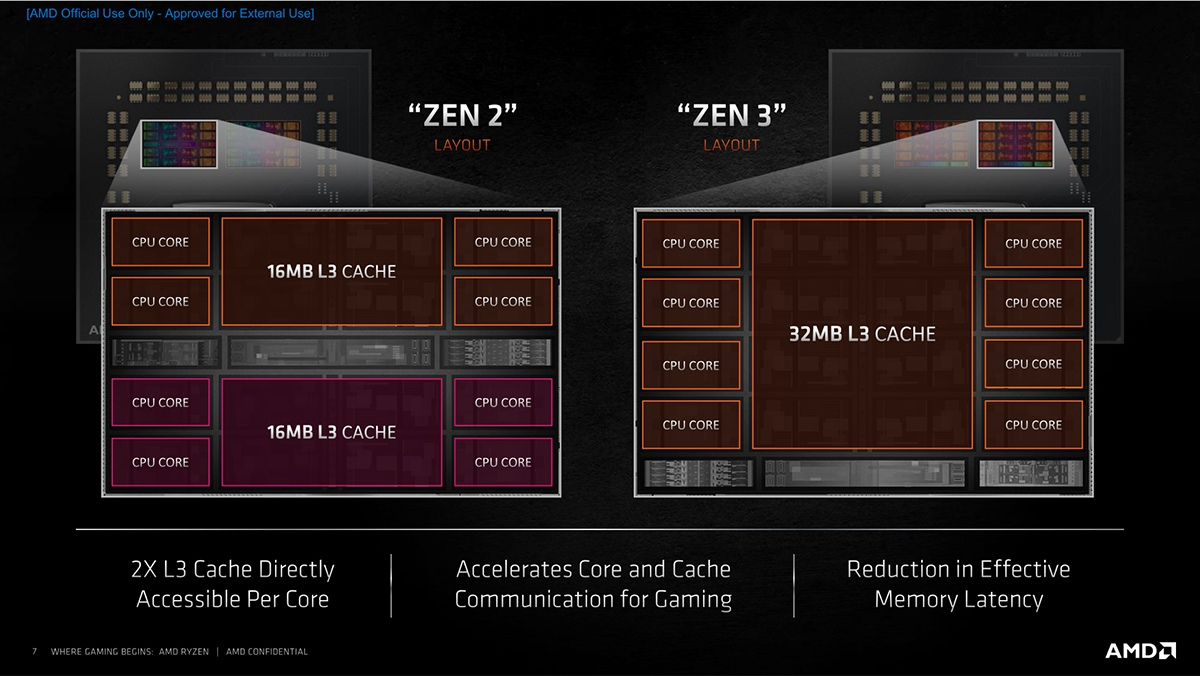

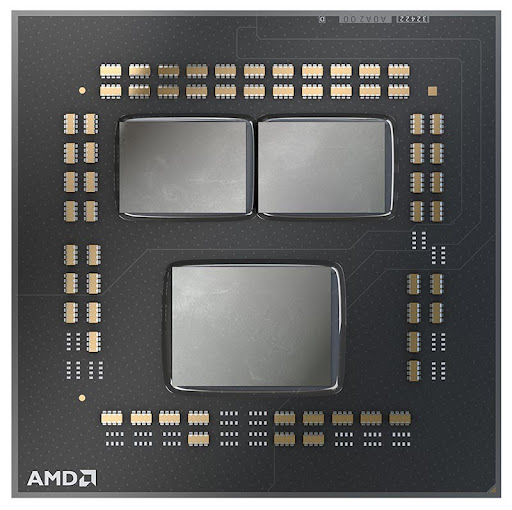

Любой девайс, который вы сейчас держите в руках – телефон, ноутбук, ваш телевизор или стиральная машина! Изначально 3D-модели создаются для всего и при необходимости создается симуляция, которая способна оценить, например, насколько сильно нагреется ваш процессор и какое нужно охлаждение, и только потом, если все расчеты сходятся, устройство собирается в железе!

Метод конечных элементов

Как же происходит симуляция? Как научили компьютер моделировать практически любое физическое явление? И главное как научили эти физические явления дружить и влиять друг на друга?

Честно говоря, это невероятно сложная задача, но главным оружием тут стал так называемый метод конечных элементов!

Этот метод как супермен в мире комиксов, если есть проблемы — решай что-то методом конечных элементов! Сейчас мы не будем вдаваться в подробности о том как он работает, но вкратце объясню.

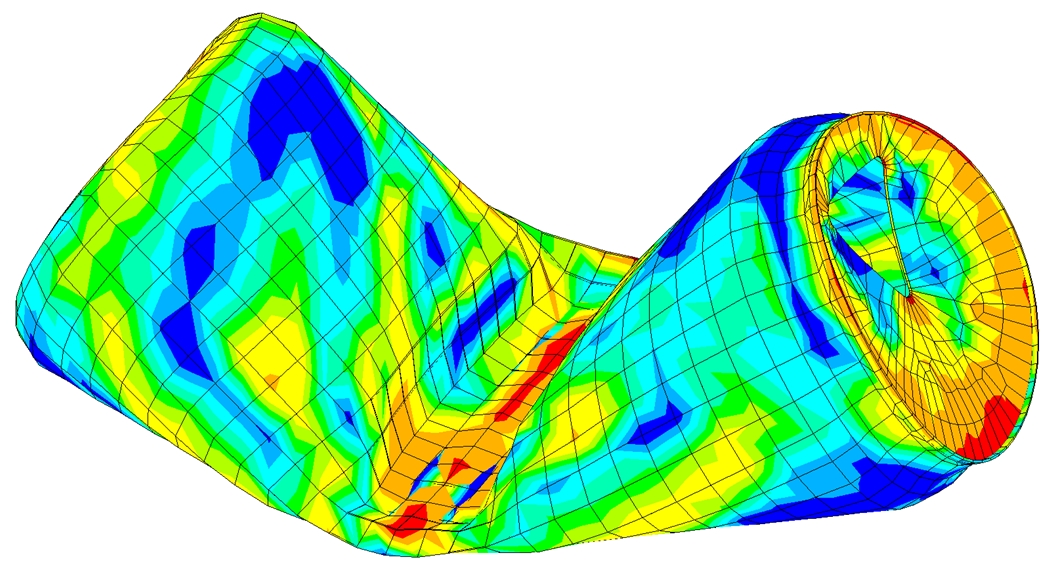

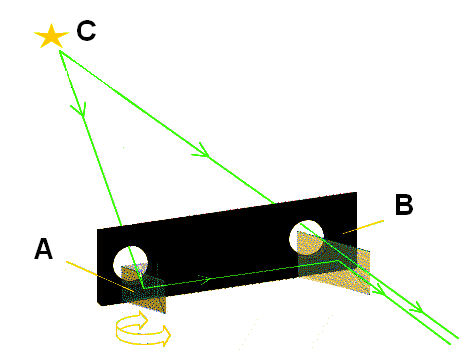

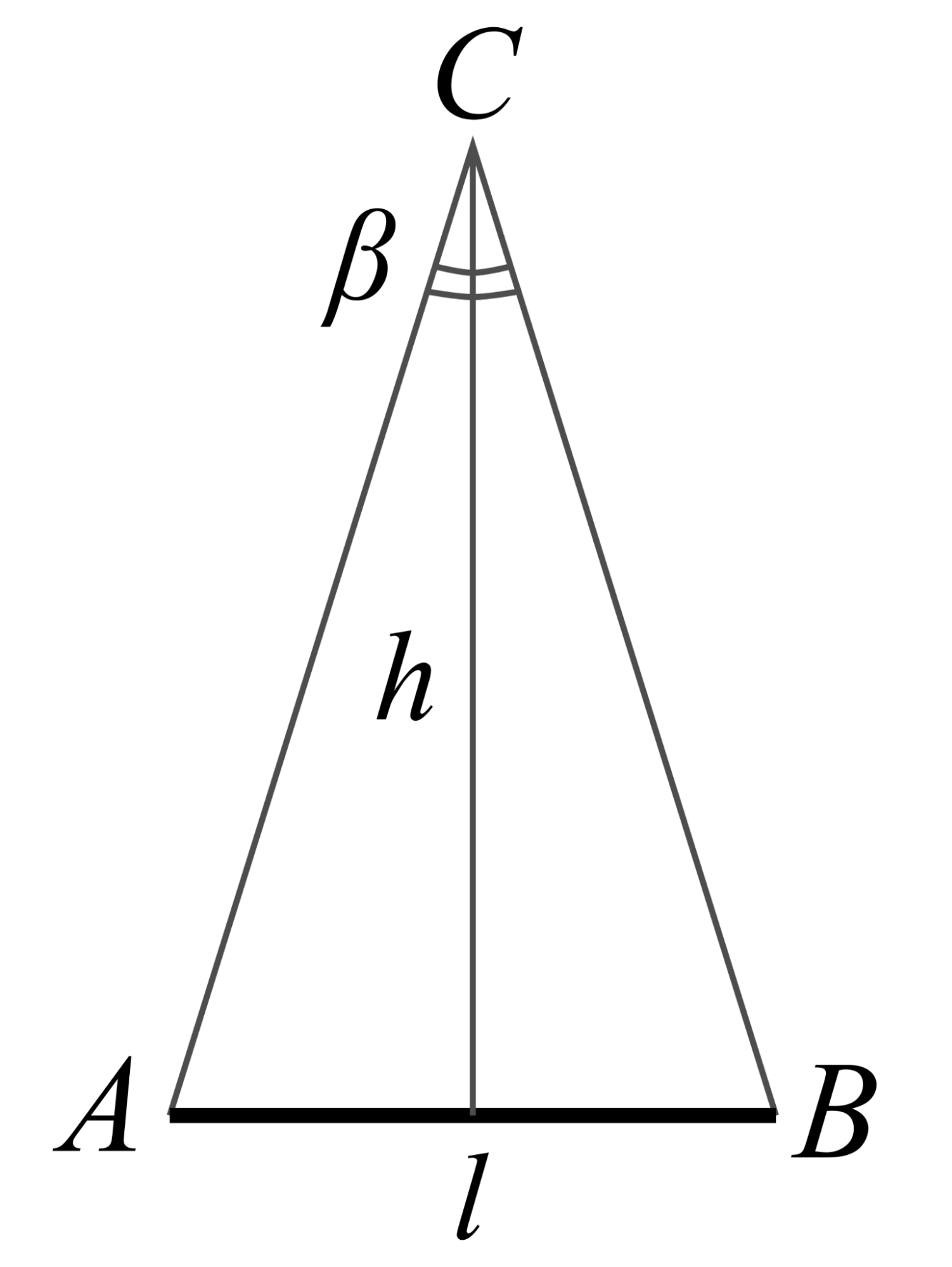

Каждая модель разбивается на целую кучу элементов, но самое главное то, что их число конечно, что собственно и отражено в названии метода.

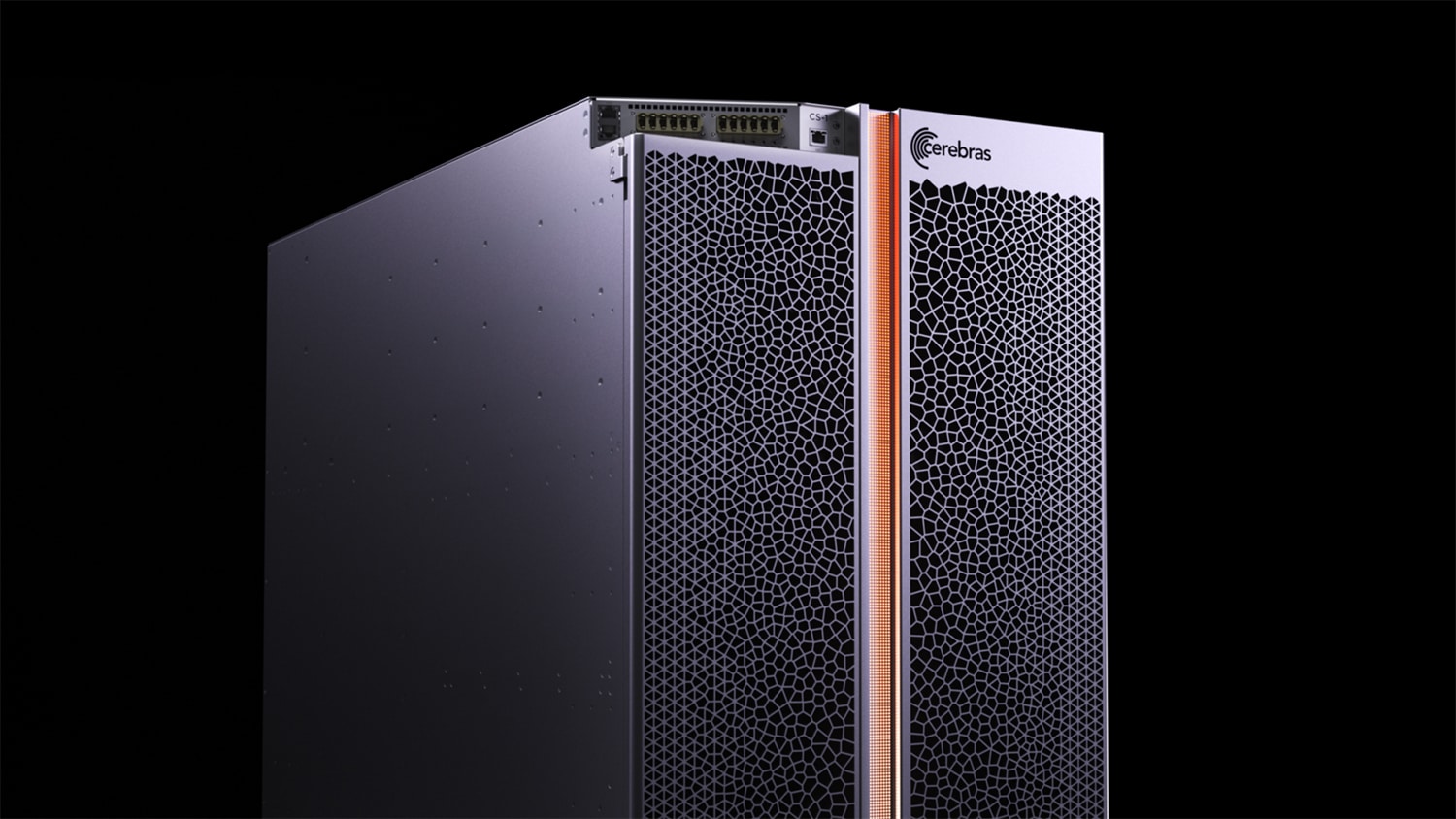

Выглядит как сеточка! И сразу вспоминается компьютер Cerebras, про который мы сделали отдельный ролик — там внешняя сетка на решетке охлаждения была стилизована именно под метод конечных элементов!

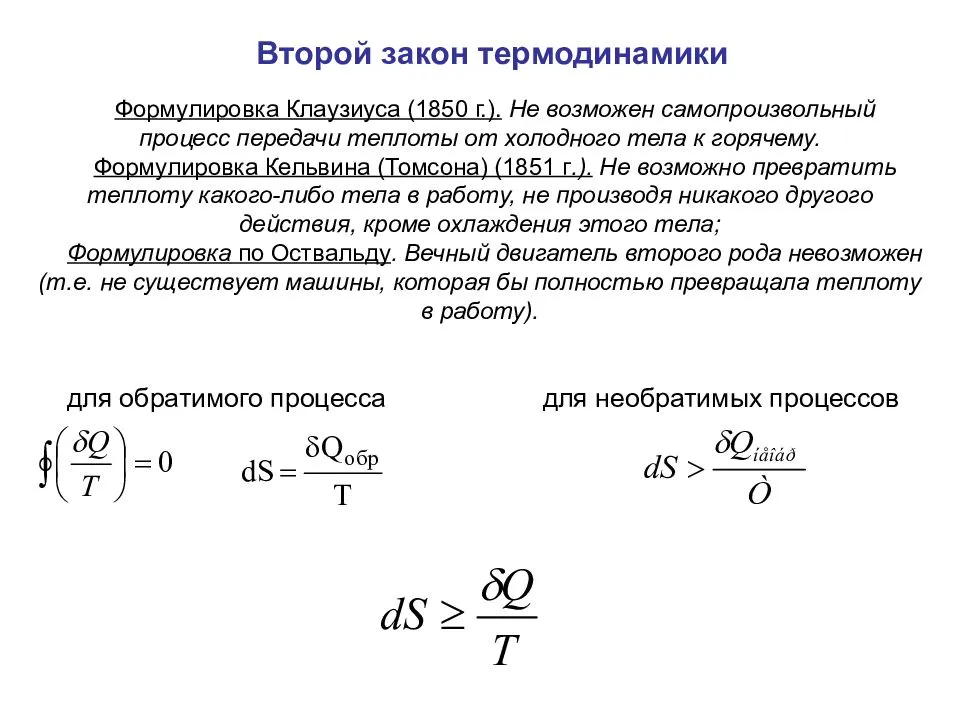

Дальше для каждой отдельной ячейки решается своя система дифференциальных уравнений в частных производных, а эти уравнения известны заранее и основаны на физических законах — например, для жидкости надо решить уравнение Навье-Стокса, а для нахождения поля температуры уравнение Пуассона!

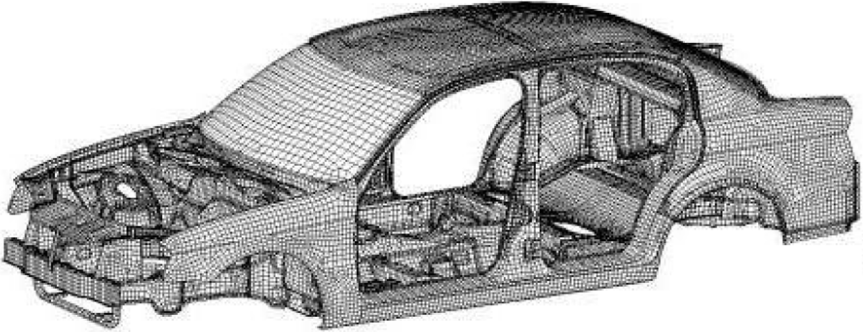

И чем больше этих отдельных ячеек тем сложнее становится система и тем больше уравнений надо решить. И одно дело если вам надо смоделировать просто жидкость, текущую в трубе, и совсем другое если вам нужно посчитать поток этой жидкости с препятствиями, в трубе с разными входами и выходами, которую одновременно греют с одной стороны и охлаждают с другой, и все это в изгибающемся под нагрузкой крыле самолета!

Соответственно, тут уже обычный компьютер не справится, да и необычный тоже. Тут нужны огромные вычислительные мощности! Опять же вспоминаем Cerebras CS-1 или суперкомпьютер Tesla — Dojo!

Кстати, недавно Tesla анонсировала, что они моделируют краш-тесты своих автомобилей и это помогает им улучшать структуру и делать свои машины безопаснее! Ну и еще не надо лишний раз разбивать свои тачки, конечно же.

NVIDIA

Но есть одна компания, которая является чемпионом по поставке чипов и сборке суперкомпьютеров для абсолютно разных задач — и это NVIDIA!

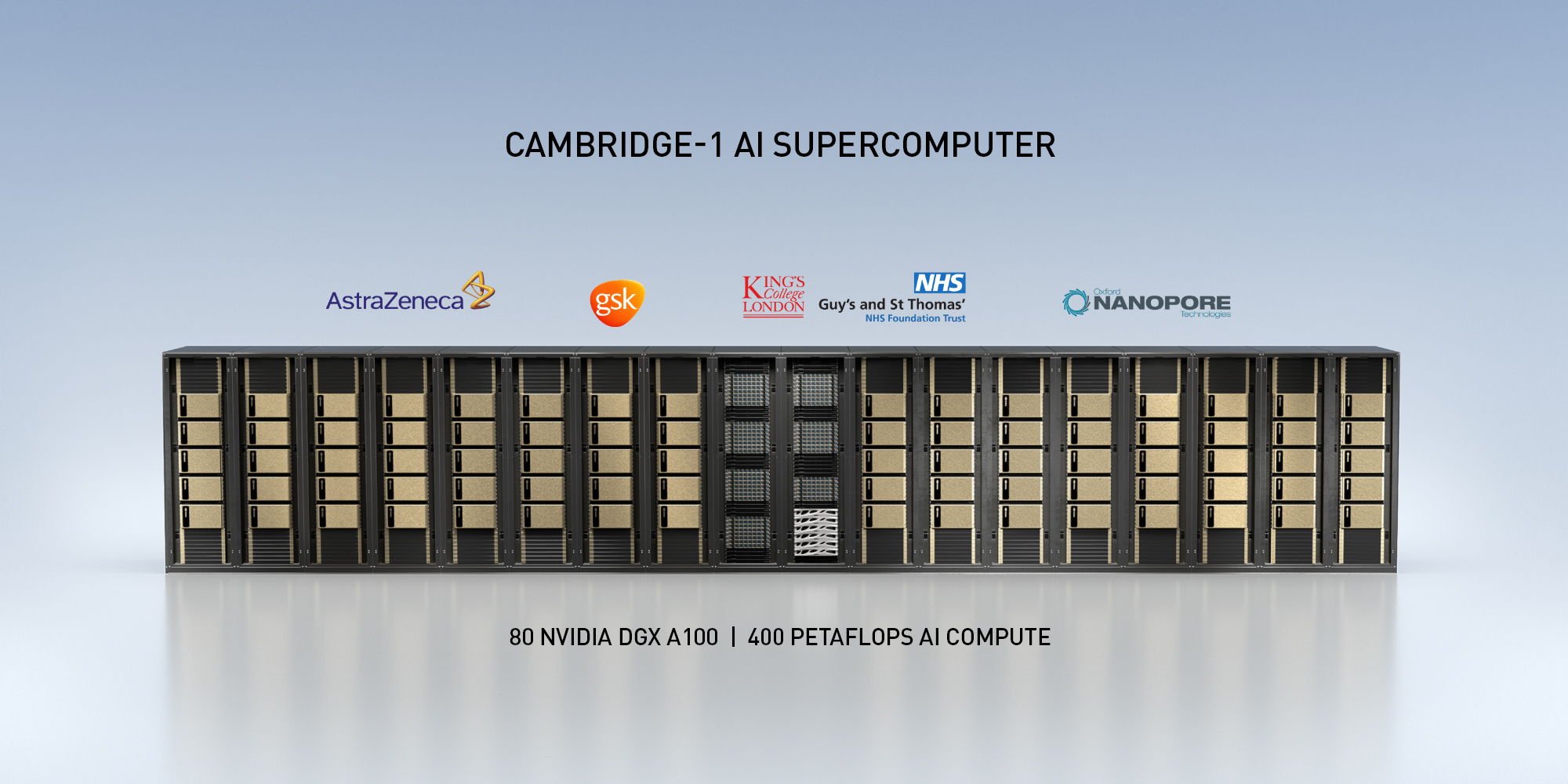

Ребята действительно лидеры в своей области и вот буквально в июле они объявили о создании суперкомпьютера Cambridge-1. Сделали они это в партнерстве с ведущими медицинскими научно-исследовательскими группами, например, известной нам теперь всем AstraZeneca.

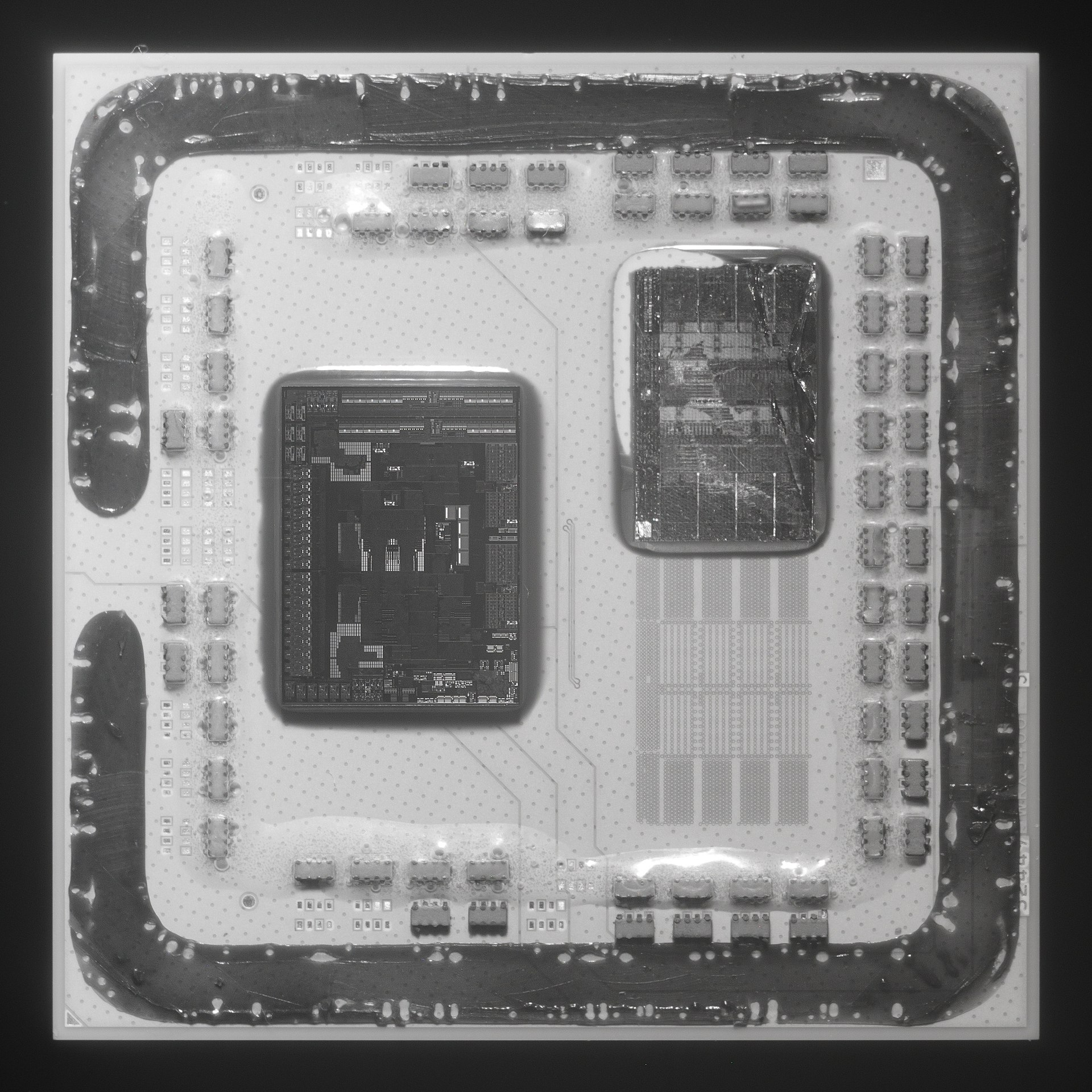

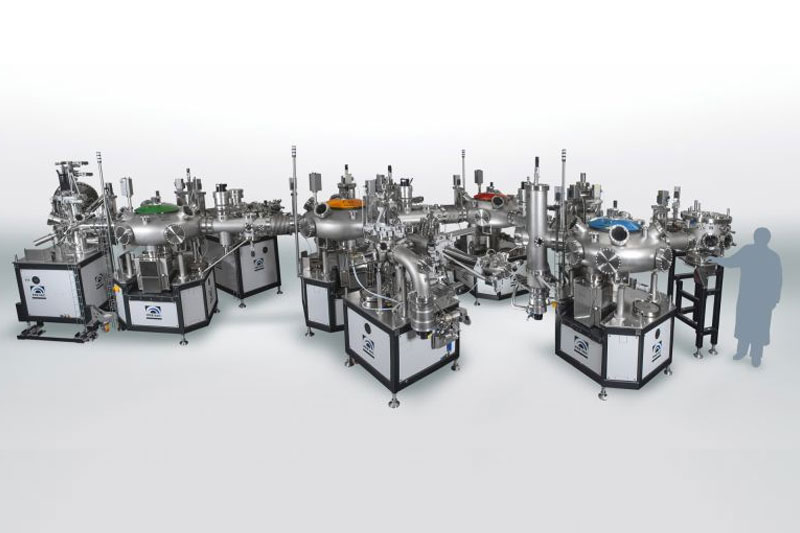

Компьютер состоит из 80 систем DGX A100, интегрирующими графические процессоры NVIDIA A100 и кучу других систем, а стоит он более 100 миллионов долларов! И нужен он для изучения новых лекарств! Точнее для моделирования влияния лекарств на организм человека! Но на этом они не останавливаются.

Судя по всему, NVIDIA собирает самый мощный компьютер в истории и нужен для очень благородной цели.

Земля-2

Человек действительно влияет на экологию и влияет, мягко говоря, так себе. Температура планеты относительно медленно, но уверенно растет, а приводит это уже сейчас к плачевным последствиям. Климат меняется — больше ураганов, наводнений, стихийных бедствий.

Но точного понимания того, что и как именно влияет на экологию и что является критическим сейчас, у нас нет. На этот вопрос и призван ответить новый компьютер под названием Earth-2 или по-русски – Земля Два.

Основная идея в том, что NVIDIA совместно с научно-исследовательскими группами планирует создать цифрового двойника всей нашей планеты. Это позволит заглянуть нам в будущее, и понять насколько сильно состояние планеты ухудшится в ближайшие 10 или 100 лет, например.

В отличие от прогноза обычной погоды, который в первую очередь моделирует физику атмосферы, такие большие климатические модели это симуляция физики, химии и биологии атмосферы. Вода, лед, поведение самой земли и главное — деятельность человека. Все это влияет

Обычные симуляции такого рода сегодня имеют разрешение от 10 до 100 километров.

Но для новой модели требуется гораздо большее разрешение. Например, для моделирования круговорота воды в природе: движения воды океана, морского льда, поверхности суши и грунтовых вод через атмосферу и облака.

А например для моделирования тех же облаков, которые отражают, как зеркало, солнечный свет обратно в космос, необходимо разрешение в метрическом масштабе! По оценкам ученых, такие разрешения потребуют увеличение вычислительной мощности в миллионы раз.

И откуда же брать такие невероятные мощности?

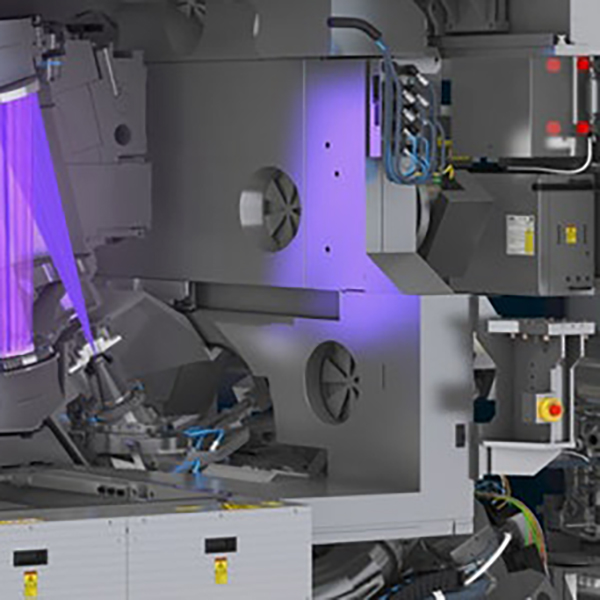

NVIDIA говорит, что в целом уже все готово, главное правильно использовать и оптимизировать ресурсы! Объединение в машинном обучении, создание и обучение нейронных сетей, ускоренные вычисления прямо на GPU и разработка новых систем искусственного интеллекта – все это должно помочь достичь невиданных ранее мощностей!

Это невероятно амбициозный проект! Только представьте модель Земли в метровом разрешении с полностью просчитанным влиянием практически всего, начиная от коров и заканчивая солнечным ветром! Может быть такая машина времени нас ждет.

Посмотрим, что из этого получится и главное сколько потребуется времени на создание такого компьютера!

И тут человечество пошло на много разных хитростей, но сейчас мы расскажем вам о двух самых классных для создания высокого вакуума.

И тут человечество пошло на много разных хитростей, но сейчас мы расскажем вам о двух самых классных для создания высокого вакуума.

Моноширинные шрифты

Моноширинные шрифты