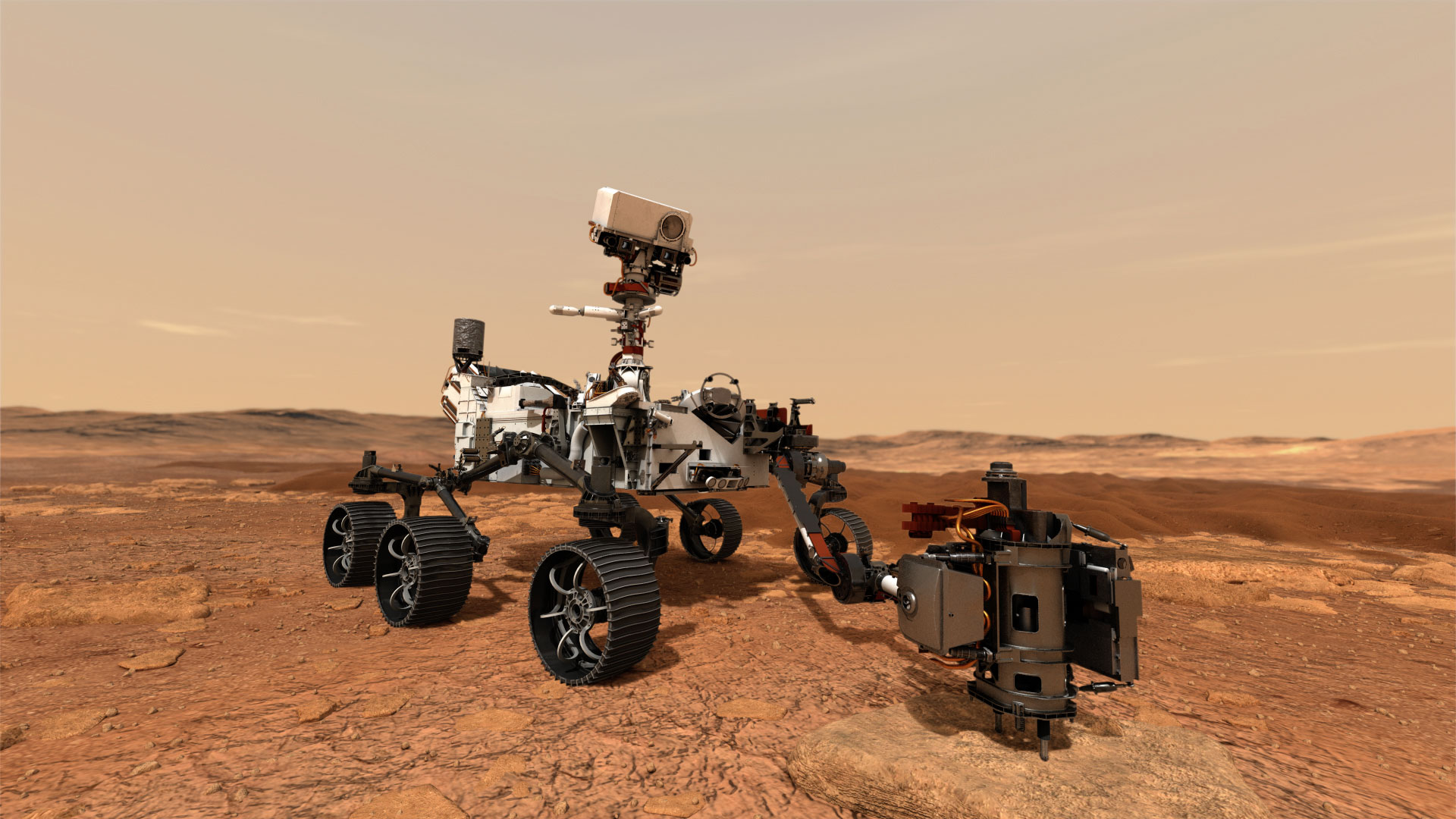

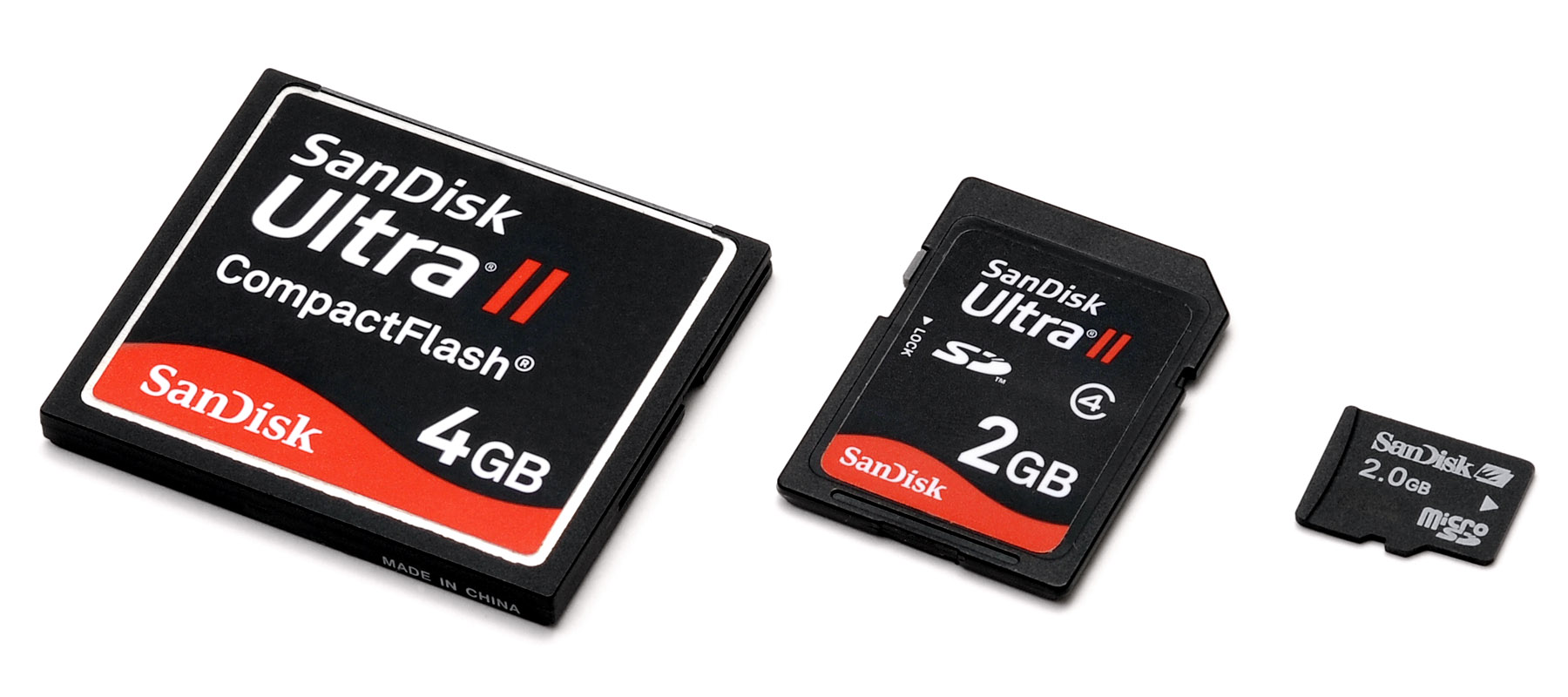

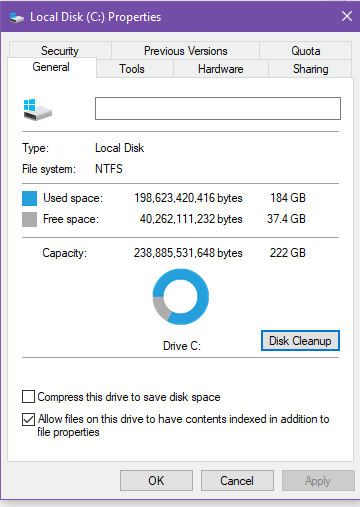

В апреле этого года на Марс высадился ровер Perseverance. Он стоил NASA 2,2 миллиарда долларов и на сегодняшний день это самый современный и продвинутый робот за пределами Земли. Однако, для многих может стать реальным сюрпризом, что работает такая дорогая и продвинутая штука на процессоре с частотой всего 200 МГц. И фактически это модифицированная версия PowerPC 750, который стоял в разноцветных iMac G3 — не последних тоненьких, а тех, что еще из конца 90-х годов с электронно-лучевой трубкой. Многие из вас может еще не родились, когда их выпустили. Также на бортовом компьютере марсохода всего 256 МБ оперативной памяти и всего 2 ГБ флеш-памяти.

Подобным же образом обстоят дела и с другими космическими миссиями. Совершенно обычная ситуация, когда в часах у вас на руке железо стоит более продвинутое и мощное, чем в научных инструментах в миллионах километров от Земли за миллиарды долларов. Даже если это часы на Android Wear…

Так что сегодня будем разбираться в том, какие процессоры и прочие железки устанавливают в космических аппаратах, почему там не используют самые современные AMD Ryzen, Intel Xeon и Apple Silicon, и что бывает, если к подбору компонентов относиться без должного уважения.

Это наш совместный сюжет с автором подкаста “Теория Большой Бороды” и канала “Давайте Разбираться” — Антоном Поздняковым.

Время разработки

Действительно, космические технологии, которые вроде как должны быть на пике всего, что существует в мире. Зачастую они могут использовать процессоры, которые в консьюмерском мире могут считаться устаревшими на пару десятков лет. Но, естественно, это делается не просто так и на то есть серьезные причины.

Во-первых, в космических делах довольно много зависит от планирования. Космическая индустрия крайне инертная и неторопливая. От проекта до запуска может легко пройти несколько десятков лет. То есть какой-нибудь зонд, который будет запущен в этом десятилетии мог начать разрабатываться, когда условного iPhone еще даже в проекте не было. А некоторые миссии могут потом еще и лететь до своей цели довольно долго.

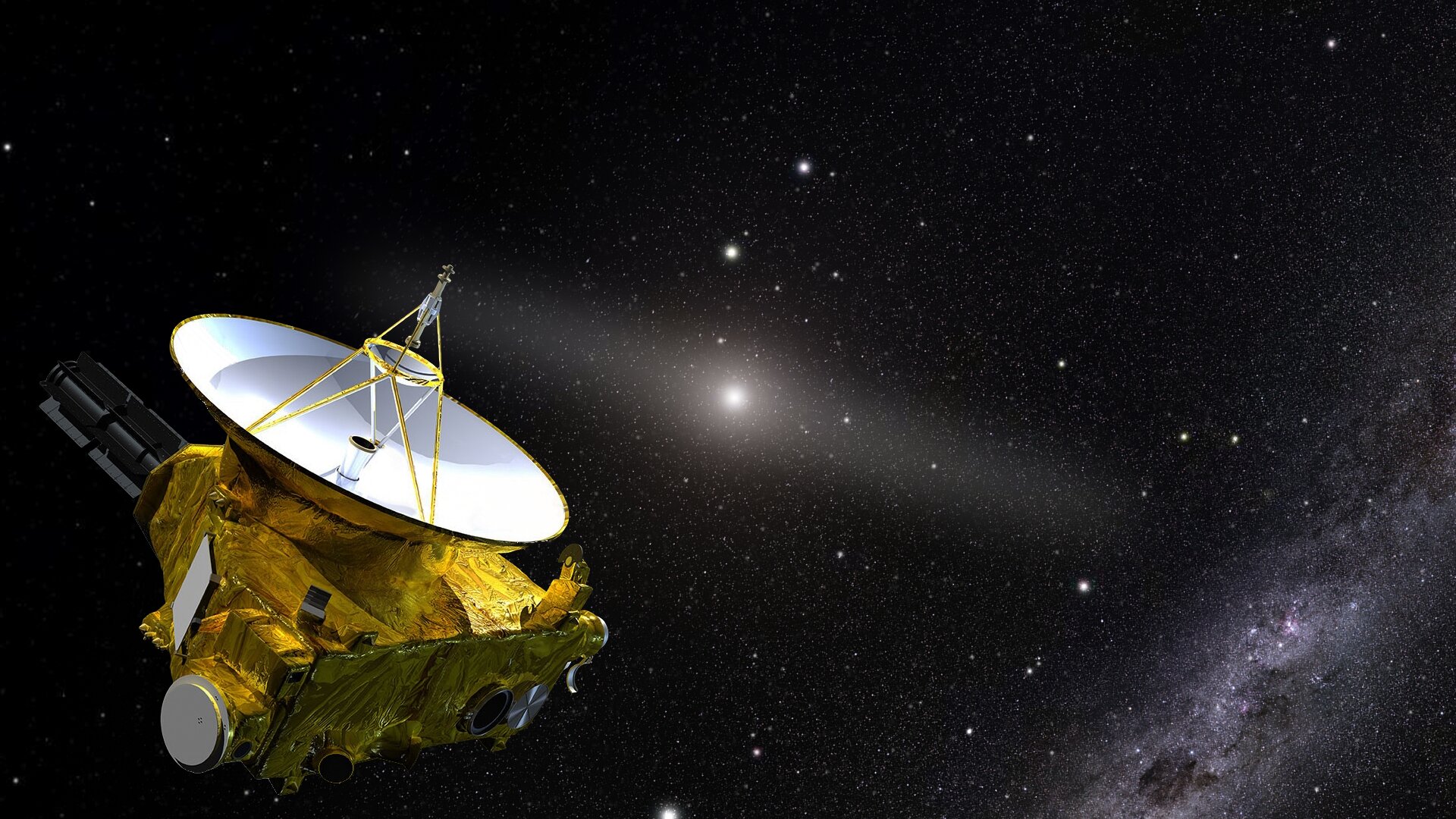

Например, зонд Новые Горизонты, который прислал нам замечательные фотографии Плутона, был запущен в 2006 году, а долетел аж через девять лет, в 2015 году. В его бортовом компьютере, кстати, был установлен процессор на невероятных 12 МГц, который являлся модифицированной версией 32-битного R300, версия которого стояла еще в самой самой первой PlayStation.

Тот же марсоход Perseverance, который мы приводили в пример, тоже начали разрабатывать очень давно. Вообще у него очень много общего с Curiosity полетевшего к Марсу еще в 2012, а работа над его хардверной и софтверной частью вообще завершилась в далеком 2008 году. И, получается, что начиналось то планирование этих миссий не так уж далеко от момента, как были представлены те самые iMac G3 на PowerPC 750.

Отчасти именно поэтому в космических миссиях летает такое старое железо, ведь оно должно закладываться на ранних стадиях планирования. Вокруг бортовых компьютеров наращиваются дополнительные системы, научные приборы, пишется специфический софт, прорабатываются средства связи с Землей и так далее. А перед запуском нельзя просто взять и поменять процессор на другой побыстрее. Тут слишком много рисков. Вот и получается, что зачастую летит та железка, которую запланировали в ходе проекта за несколько десятков лет до непосредственной работы.

Температурный режим

Но долгое планирование далеко не единственная причина не самого мощного железа. Не стоит забывать, что космос это очень суровое место, где все должно выживать в очень жестких условиях.

Например, космический компьютер должен выдерживать очень большие перепады температуры. Многие наверняка слышали, что в космосе всегда абсолютный ноль, но это не совсем так. Температура это ведь мера среднего движения частиц. А так как частиц в космосе очень мало, то и определение температуры как бы теряет смысл.

Вообще, как в открытом космосе, так и, например, на Луне, проблема перегрева стоит гораздо острее, чем проблема переохлаждения. Инструменты сами греются, а еще на них может светить Солнце.

Но основная причина в том, что там нет воздуха — почему это важно — сейчас объясним! В привычных нам условиях остывание происходит за счет конвекции. Тепло передается воздуху, он нагревается, улетает, на его место приходит холодный и так далее. В космосе такой роскоши нет.

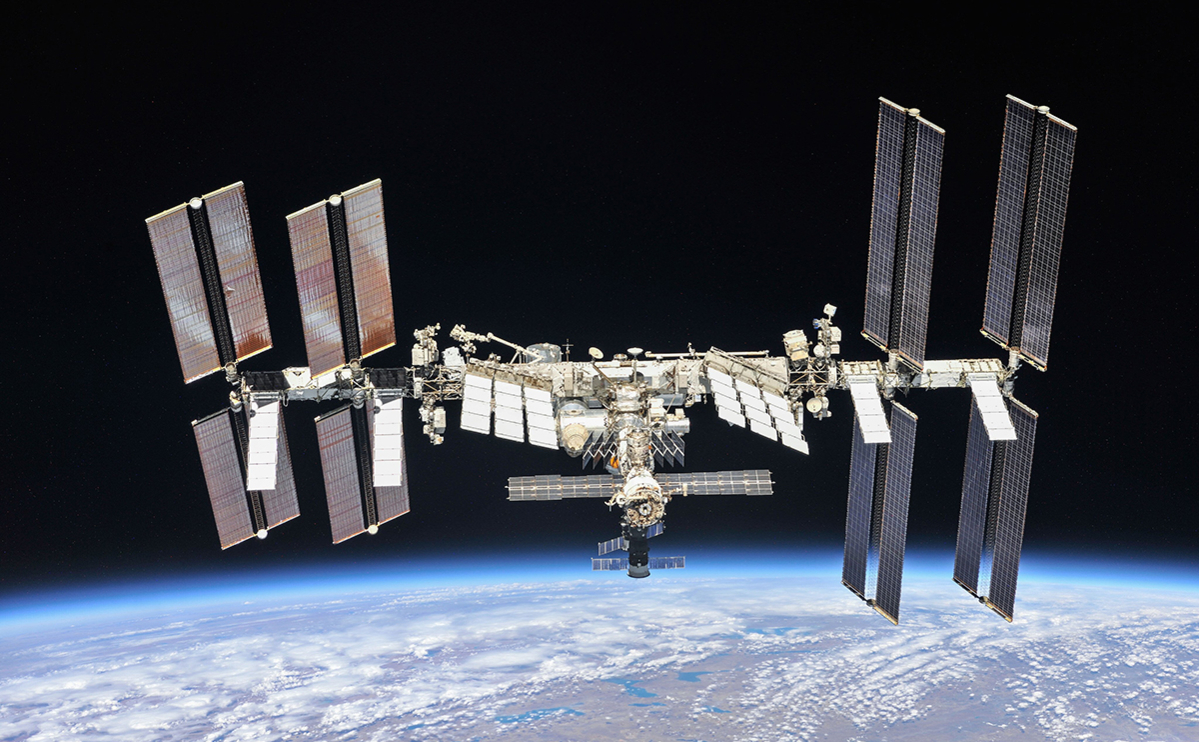

Единственный способ там остывать — с помощью инфракрасного излучения, что не так и эффективно. Например, если внимательно посмотреть на МКС, то можно увидеть вовсе не солнечные батареи, а как раз радиаторы для отвода тепла. Без них станция просто перегреется, несмотря на то, что вокруг нее вроде как почти космос с абсолютным нулем.

И даже на Марсе, где есть разреженная атмосфера, тоже очень жесткие перепады температуры от ночи ко дню — с суточным разбросом больше сотни градусов Цельсия.

Поэтому, собственно, и чипы, которые устанавливаются в космические аппараты, да и всё остальное оборудование, должны выдерживать как очень низкие, так и очень высокие температуры.

Для процессора на Perseverance это окно составляет от -55 до 125 градусов Цельсия.

Коммерческие процессоры довольно быстро загнулись бы в таких условиях. Так что тут во главе угла надежность, ведь никто не хотел бы потерять миссию, над которой работали 15 лет и вложили в нее 2 миллиарда, просто потому что отказал недостаточно надежный процессор.

Радиация и техпроцесс

Все так, но температурный режим — далеко не самая большая опасность, которую космос несет для чипов. Куда неприятнее радиация, которой в космосе довольно много. Она прилетает как от галактического фона, так и от Солнца. Это высокоэнергетические космические лучи, которые прошивают все на своем пути, и не только разбивают живые клетки и ломают молекулы ДНК, но и приборы тоже совершенно не щадят.

На Земле от нее нас защищает магнитное поле и атмосфера. Собственно, поэтому, например, на МКС, которая летает на высоте около 400 километров, люди могут довольно спокойно оставаться порядка года, а также там используют вполне себе современные железки вроде ноутбуков, фотоаппаратов и так далее.

Но за пределами магнитного поля всё сложнее. Космические лучи, пролетая через чип, могут вызывать кучу неприятностей, которые могут быть как обратимы, так и необратимы.

Они могут менять состояние ячеек памяти или регистра, внося неразбериху в данные, а также навсегда выводить их из строя, что может сказаться на работоспособности всего чипа, а следовательно и представлять угрозу для вообще всей миссии.

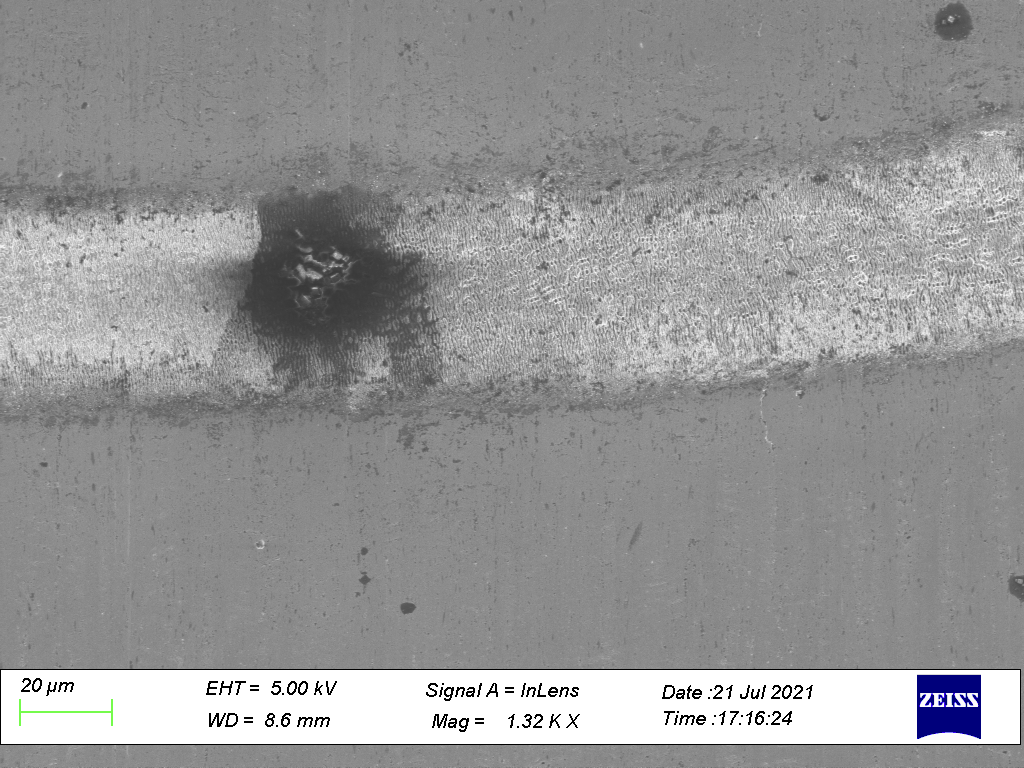

Ионизирующая радиация может создавать электромагнитный шум или внезапные электрические импульсы, что может защелкивать транзисторы в неправильном положении или даже повреждать дорожки проводников.

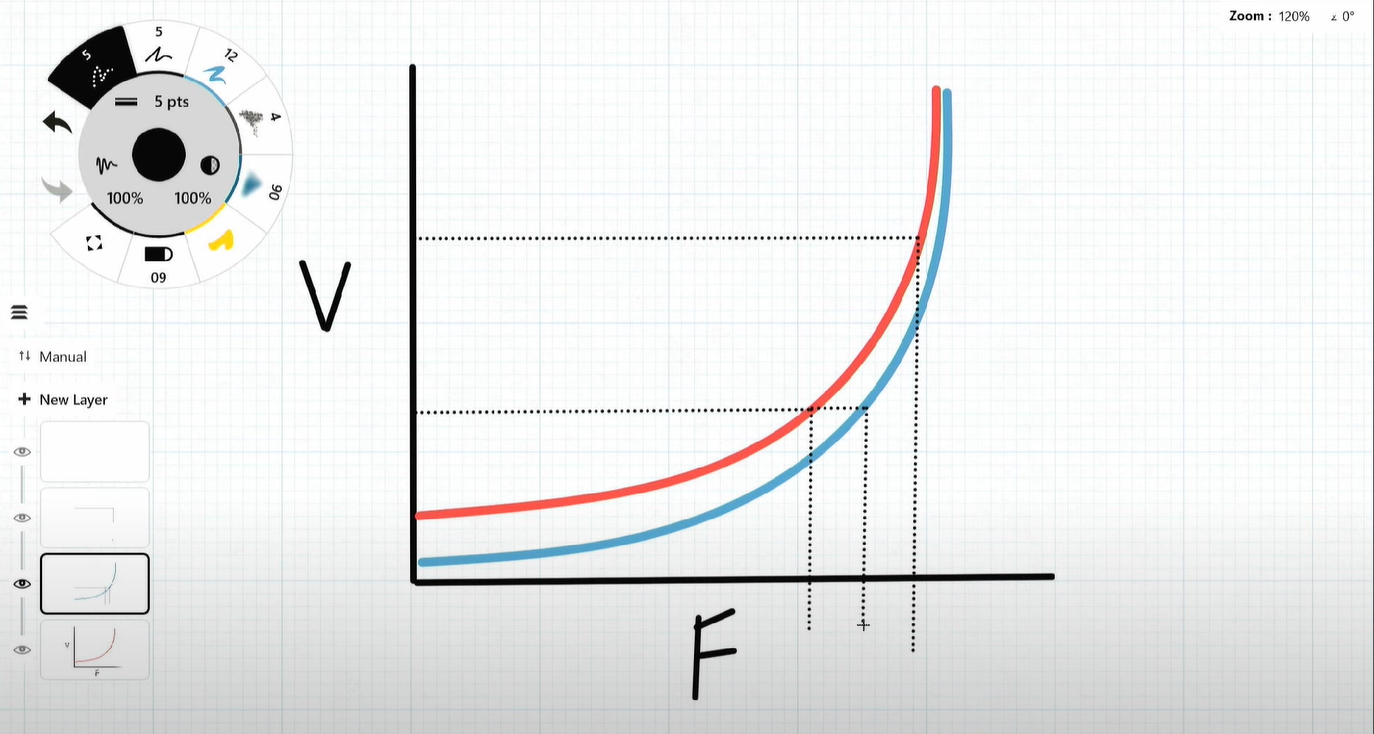

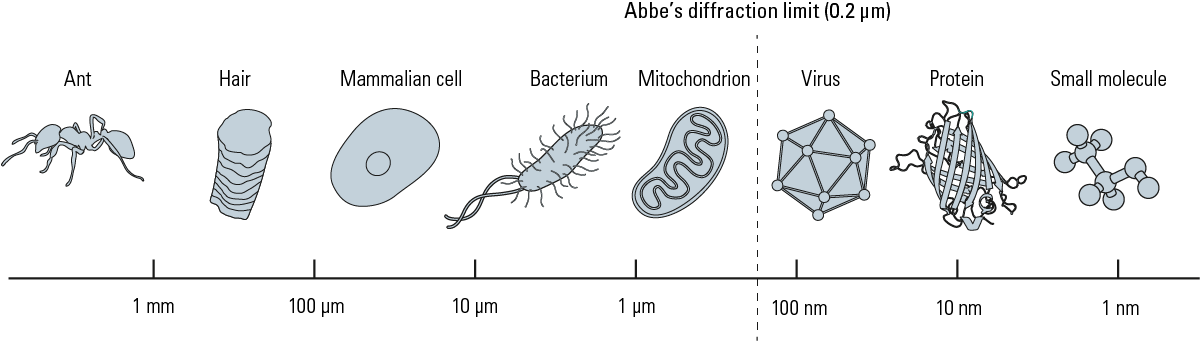

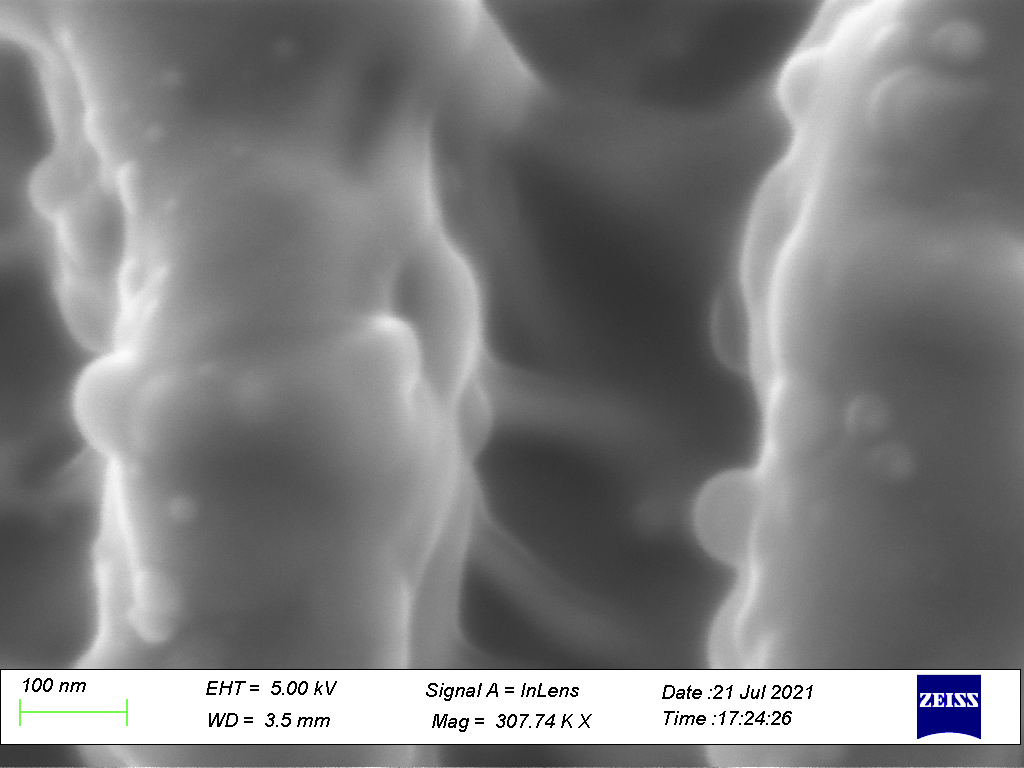

Поэтому, кстати, процессоры сделанные по очень маленькому техпроцессу могут не подходить для космоса в принципе, ведь при достаточно близком расположении, их гораздо легче замкнуть между собой пролетающим космическим лучом.

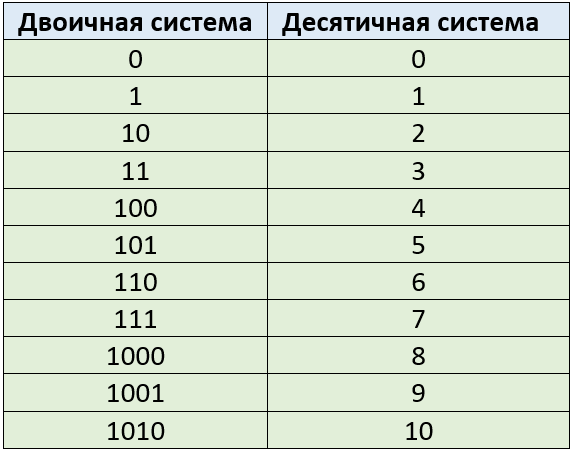

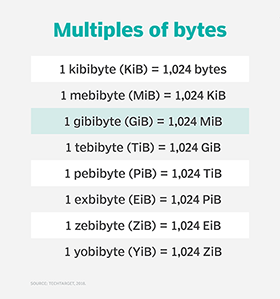

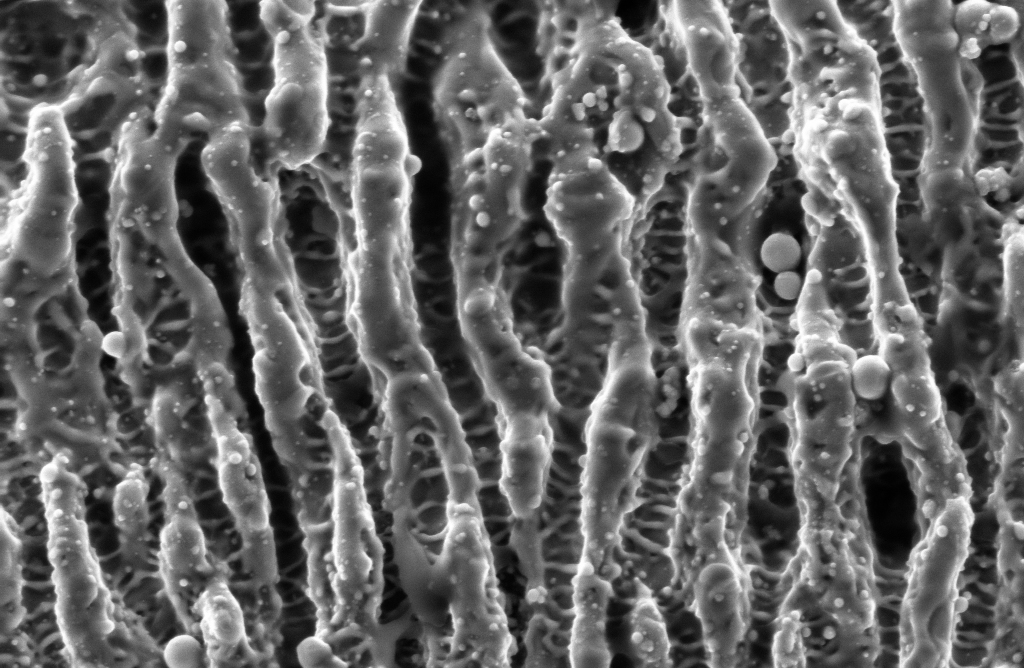

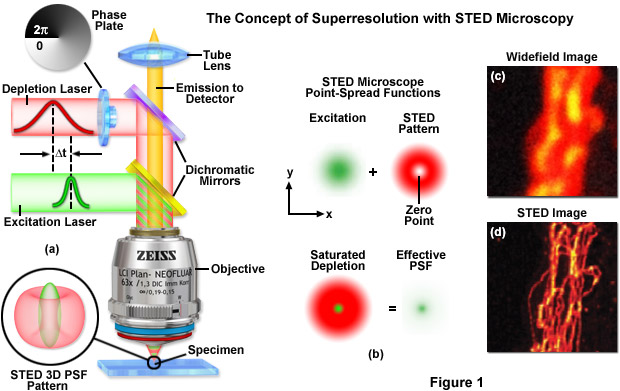

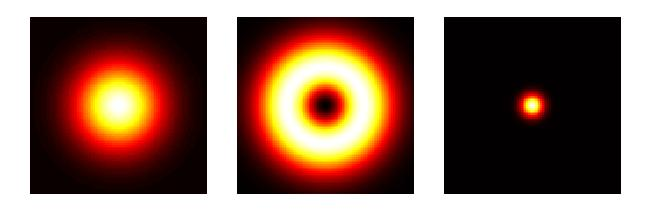

Вообще для использования в космосе процессоры проходят очень серьезную подготовку для противостояния радиации. Например, на подложку вводят специальный слой из оксида кремния или сапфира для изоляции. Используют специальные транзисторы с более высоким током переключения. Вместо DRAM на конденсаторах используют более защищенную, но и более дорогую SRAM. Сами камни процессоров делаются более большими и покрываются специальной изоляцией на основе бора.

Кроме физических защит также используют и разные программные трюки вроде системы коррекции ошибок, независимых дублирующих элементов, хранения одних и тех же битов в нескольких физических копиях и так далее.

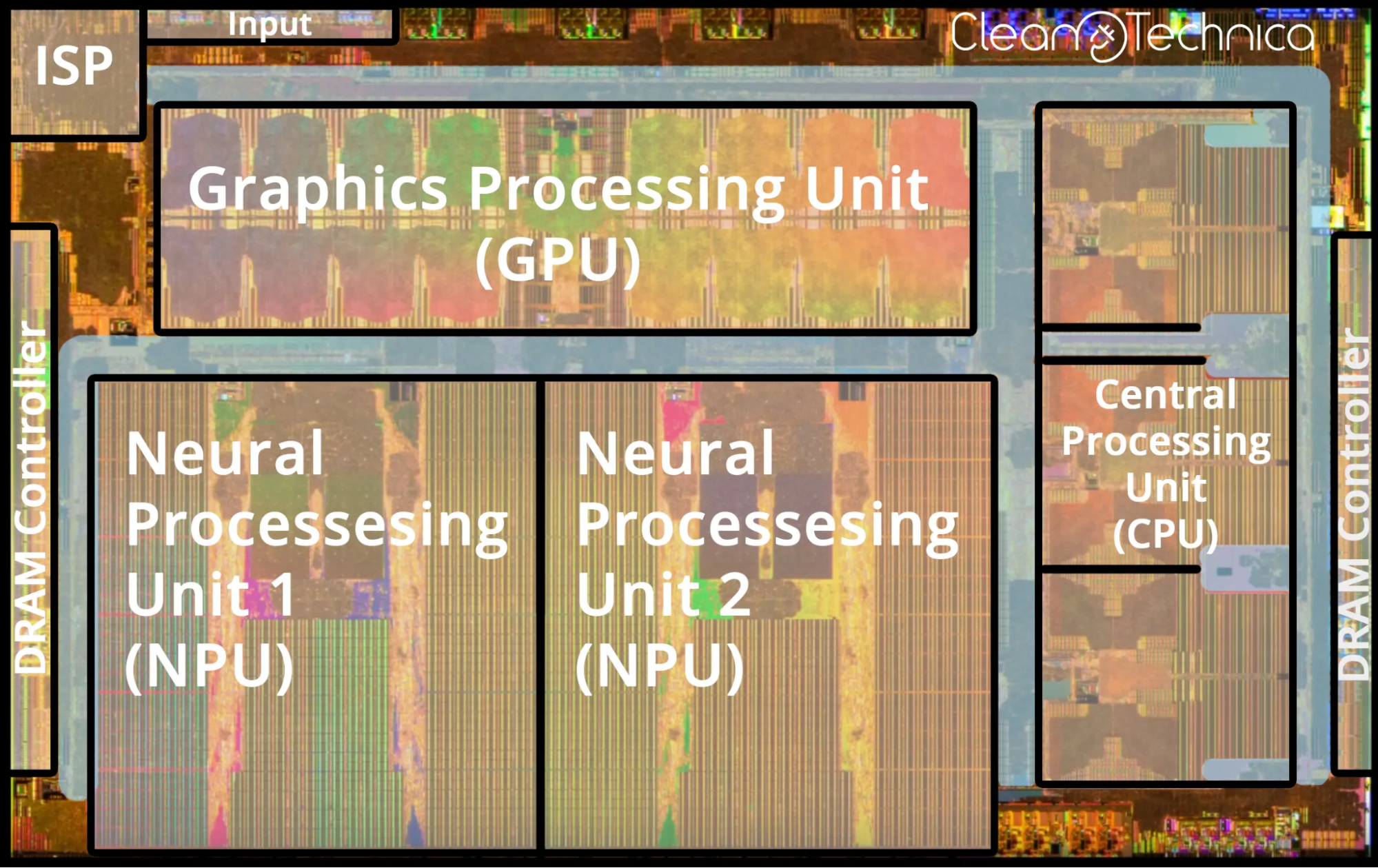

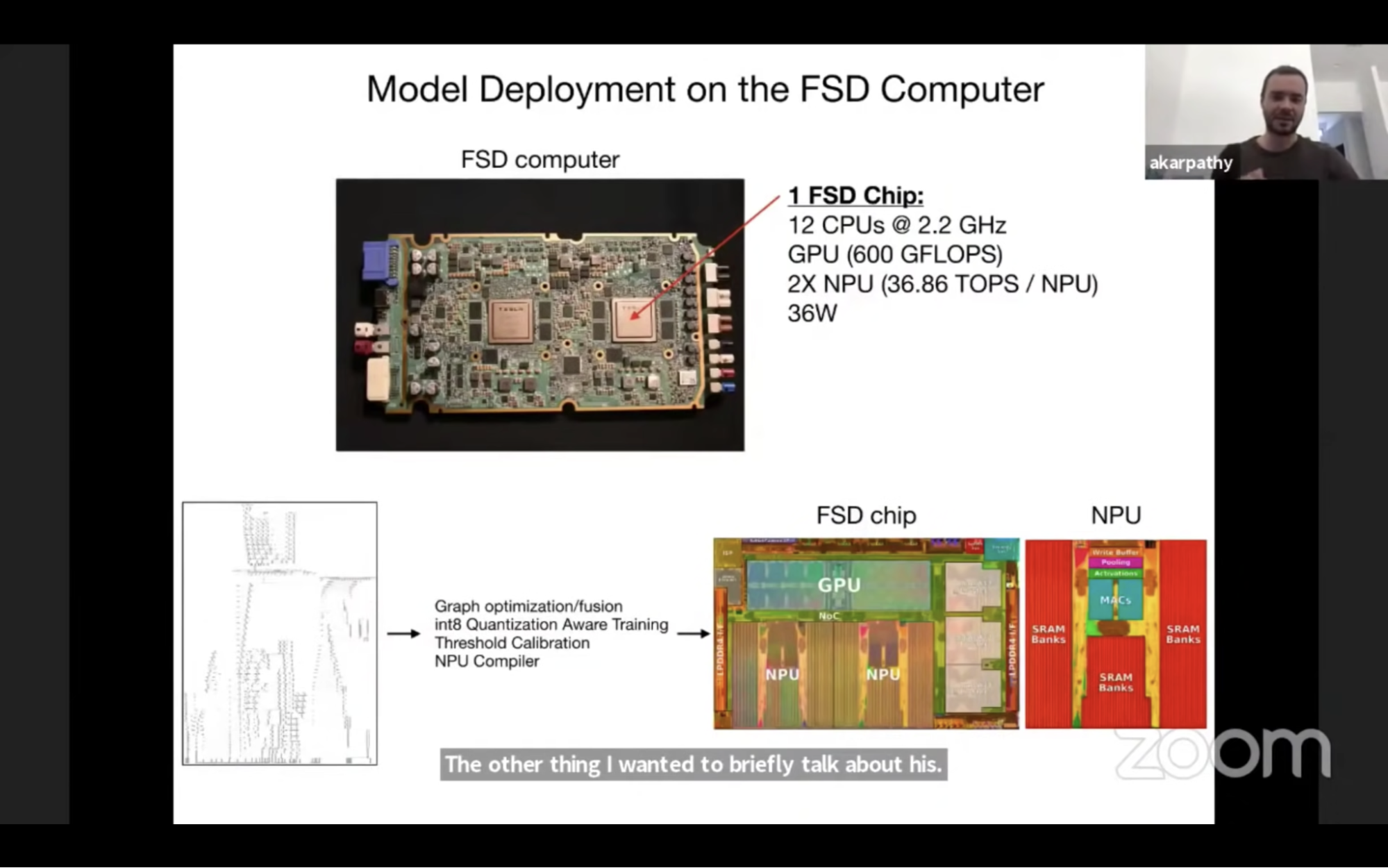

Тот самый чип RAD750 на компьютерах марсоходов Perseverance и Curiosity — а на каждом ровере их, к слову, по две штуки дублирующих друг друга — хоть и сделан на основании PowerPC 750, но фактически он полностью переизобретен в плане защиты. Кроме температурных режимов он может выдержать 1 миллион Рад, что на 6 порядков больше типичных консьюмерских процессоров.

Кристал защищенной версии почти вдвое больше, чем у оригинального камня, а в производстве использовались техпроцессы в 150 и 250 нанометров. И вся эта процедура совсем недешевая. Один такой процессор от BAE Systems стоил почти четверть миллиона долларов — такие процессоры стоили безумных денег еще пока это не стало мейнстримом с текущим дефицитом полупроводников.

Но такая стоимость тоже не берется с потолка и если пренебречь безопасностью, то все может пойти очень сильно не так в прямом смысле этого слова. И такие примеры тоже были.

Фобос-Грунт

Вот, например, в 2011 году Роскосмос запустил миссию Фобос-Грунт, которая, как нетрудно догадаться, должна была тоже лететь в сторону Марса и предметно исследовать один из его двух спутников. Однако, до своей цели станция так и не долетела, не покинув даже орбиту Земли.

Так что вместо Фобоса, Фобос-Грунт полетел, так сказать, исследовать наш земной океан, где он был затоплен и остается там до сих пор.

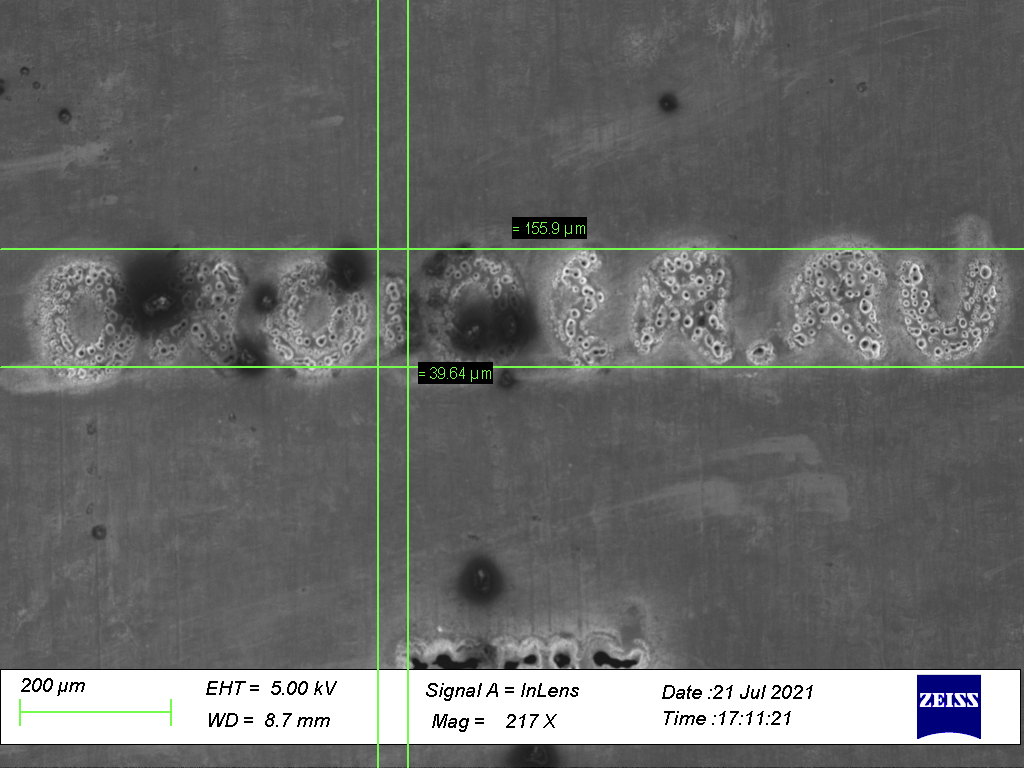

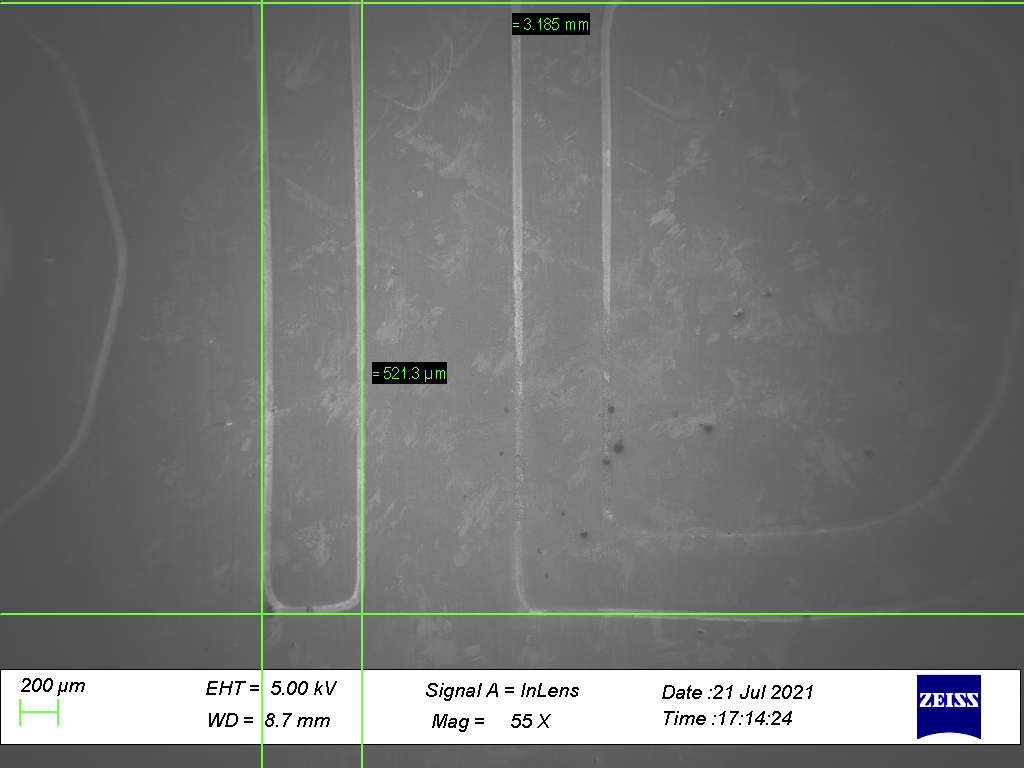

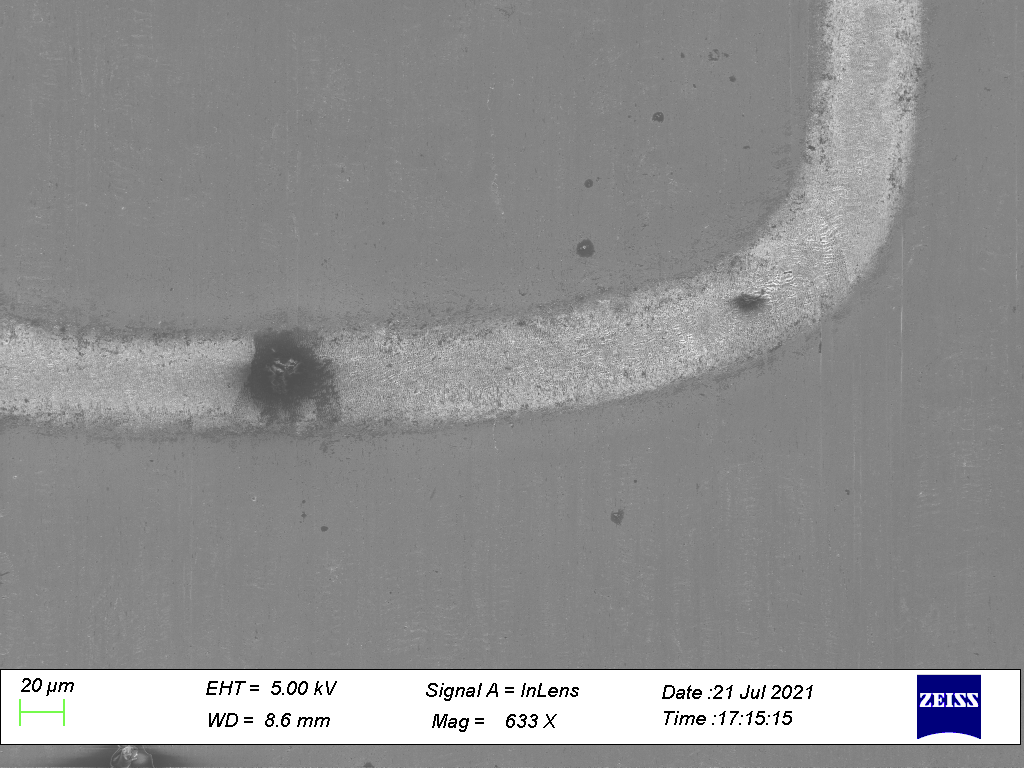

Причиной отказа аппарата признали SRAM чип с вот таким не слишком запоминающимся названием — WS512K32V20G24M. Его как раз и пробил космический луч, после чего процессор ушел в безопасный режим и вся миссия закончилась толком не начавшись. А все дело в том, что этот чип был сделан и протестирован не для космоса, а для самолетов. Пусть военных, но все же самолетов.

По информации военной газеты «Красная Звезда» в сборке Фобос-Грунта было использовано 95 тысяч различных чипов, и аж 62% из них не были должным образом сертифицированы для использования в космосе. На самом деле довольно мутная история, но официальная версия именно такая.

Так что погоня за большей производительностью и более дешевыми чипами, как видите, может привести вообще к нулевому результату и потери всей миссии.

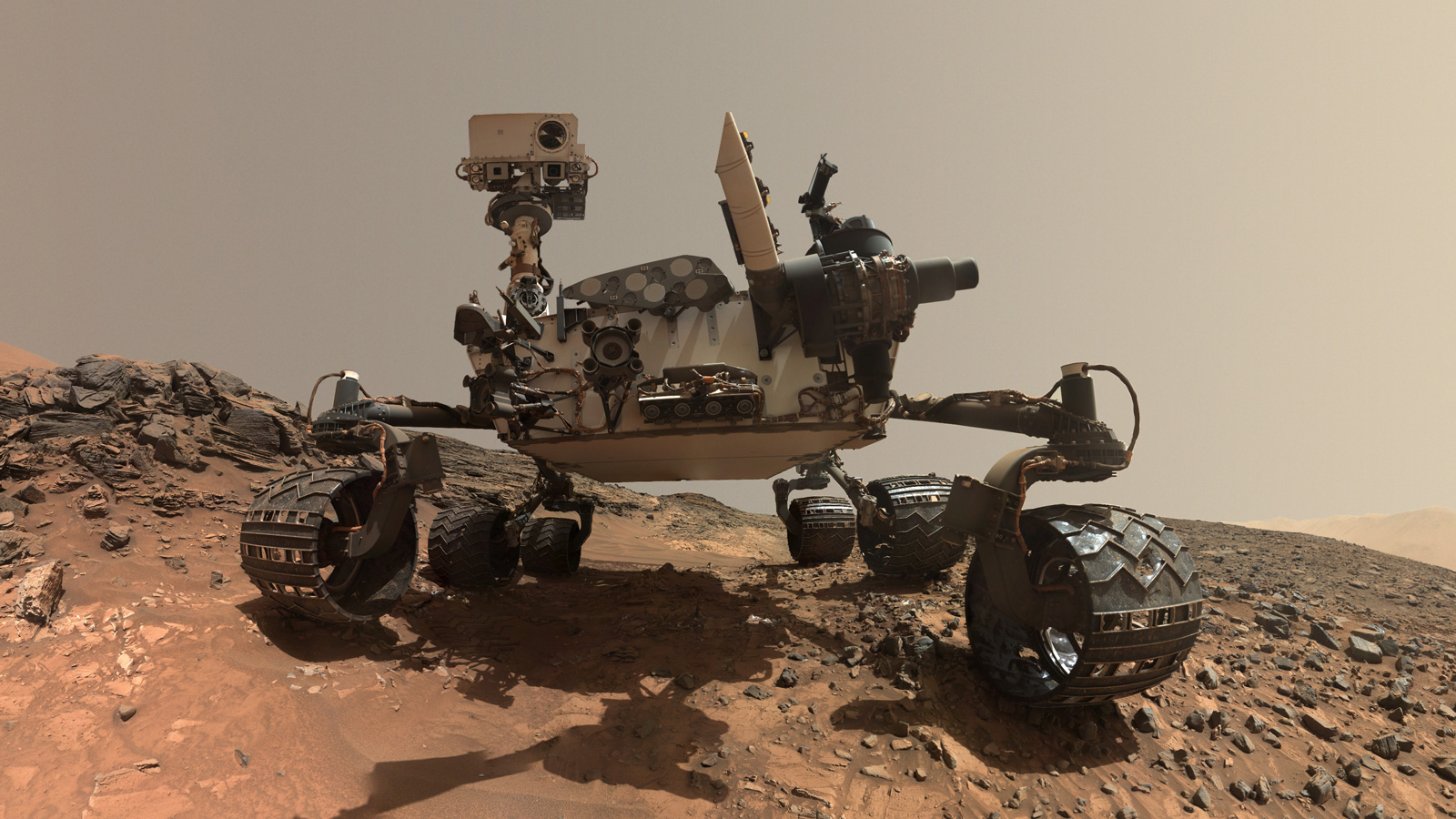

Curiosity

Но даже если у тебя все сделано по жестким стандартам, проблемы все равно могут быть. Так, например, ровер Curiosity, младший брат Perseverance тоже их не избежал.

Дело в том, что материнские платы компьютеров Curiosity защищены по менее жесткому стандарту, чем сам процессор, что и становилось причиной неполадок. Хорошо, что на каждом марсоходе установлено по два компьютера — А и Б.

Дублирующий нужен на случай, если что-то пойдет не так. И, собственно, на 200-е марсианские сутки миссии компьютер А ушел в бутлуп из-за поврежденного сектора памяти. После этого команда управляющая Curiosity перевала ровер на дублирующий компьютер Б.

Однако в октябре 2018 года похожие проблемы настигли и второй компьютер, после чего команде пришлось возвращаться обратно на вариант А, где были изолированы поврежденные участки памяти, то есть и производительность была немного снижена.

А в 2019 году ровер снова переключился на дублирующий компьютер после очередного сбоя в работе. Так что, к сожалению, причиной будущего окончания миссии может оказаться вовсе не отказ колес или истощение источника электричества, которым там выступает плутониевый РИТЭГ, а именно сбой в управляющих компьютерах.

Ingenuity

Но с защитой процессоров бывают и исключения из правил и одно из них произошло как раз в миссии марсохода Perseverance.

Дело в том, что в этот раз ровер полетел не один, а с небольшим пассажиром — вертолетиком Ingenuity. Это такой proof-of-concept, главной задачей которого было показать возможность полетов в условиях крайне разреженной атмосферы Марса, что он уже с успехом сделал.

Давление на Марсе очень низкое, а поэтому крутить своими двумя пропеллерами ему нужно очень быстро — 24000 оборотов в минуту, при этом всему аппарату нужно быть очень легким — на всё про всё всего 1,8 килограм. И хотя 38% земной гравитации немного упрощают задачу, это все равно был серьезный технологический вызов для разработчиков.

Но так как вертолетик в состав миссии марсохода добавили относительно поздно, а его работа не была критичной для остальных научных задач, то делали его по космическим меркам быстро и дешево.

Поэтому, как ни парадоксально, на нем стоит очень мощный по космическим меркам процессор. Фактически, это всем нам знакомый Qualcomm Snapdragon 801 — тот самый, который был установлен, например, в самом первом OnePlus One. Так что в каком-то смысле у компании Qualcomm есть монополия планетарного масштаба на ARM-чипы.

Правда, вероятно, именно он и станет причиной, по которой однажды вертолетик больше не взлетит. Но, тем не менее, на сегодня он уже совершил десяток полетов и пока что не планирует останавливаться.

Будущее чипов в космосе

Но конечно же, в космических железках прогресс тоже не стоит на месте, пусть и отстает от потребительских гаджетов. Для космоса тоже разрабатывают обновленные модели, причем разные агентства подходят к этому вопросу по-разному. Например, ESA, Европейское Космическое Агентство, придерживается опенсорсной архитектуры SPARK и линейки процессоров LEON. Тот же чип GR740 построен уже по 65-нанометровому техпроцессу и в ходе испытаний выдержал бомбардировку тяжелыми ионами примерно в 300 раз больше, чем тот самый проблемный чип на Фобос-Грунте. А еще для работы ему нужно всего 1,5 Ватта, что зачастую очень важно для космических миссий, у которых очень ограничен энергетический бюджет. На сегодняшний день это вообще лучший результат по производительности на Ватт среди всех космических железок.

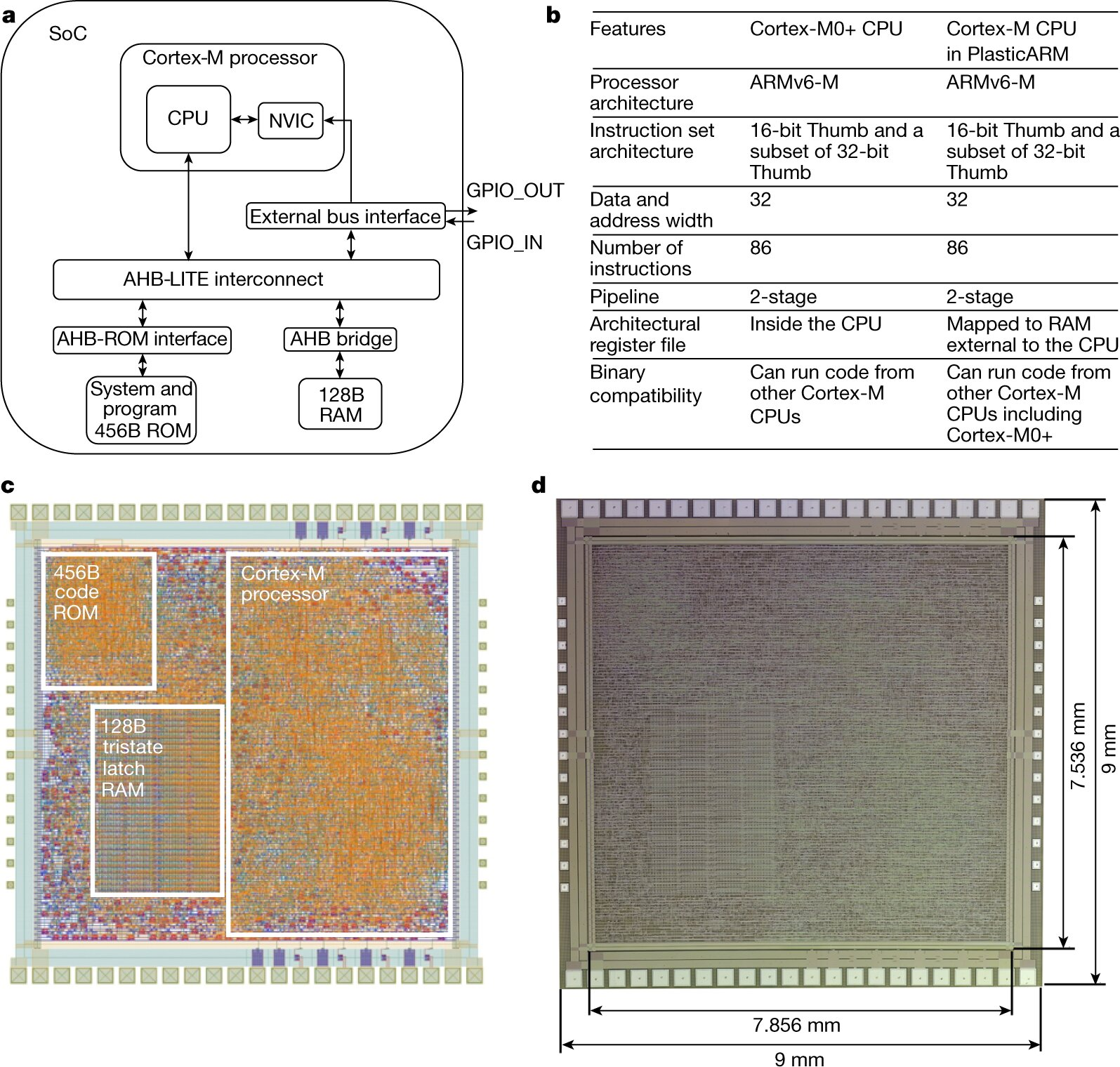

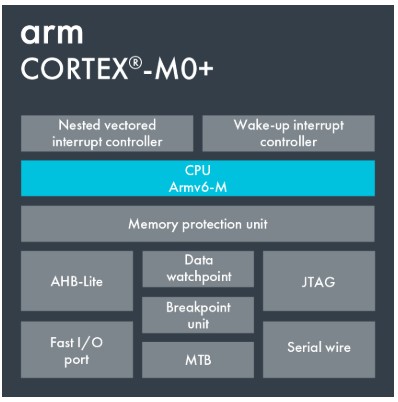

В NASA же работают с проприетарными технологиями, в частности линейкой HPSC. Они уже основаны на ARMовских ядрах Cortex A53. Исходя из того, что земные чипы на такой архитектуре могут работать на частотах до 1,8 ГГц, предполагается, что после защиты от радиации этот показатель может упасть всего до 500 МГц, что довольно много по космическим меркам. Довести до ума HPSC-процессоры NASA обещает к 2023-2024 году, как раз когда должна стартовать пилотируемая часть программы Артемида по возвращению людей на Луну. Но это уже тема для отдельного ролика. Обязательно напишите в комментариях, если хотите, чтобы мы осветили эту тему.

g

g