Интернет всем хорош, но есть у него один большой недостаток. Дело в том, что он проектировался с ошибками.

Люди, стоявшие у истоков интернета, в 1970 годах даже представить не могли, что спустя каких-то 40 лет у нас у каждого в кармане будет по персональному компьютеру с круглосуточным доступом в интернет, а потом интернет понадобится всем лампочкам, чайникам и умным пылесосам. Поэтому они совершили грубейшую архитектурную ошибку — сделали интернет очень маленьким и назвали этот интернет — Internet Protocol версии 4.

Поэтому сегодня мы поговорим о том, что не так с текущим интернетом? Как интернет закончился в середине 2010-х и о том как Internet Protocol версии 6 навсегда изменит архитектуру интернета.

Как появились IP-адреса?

Нам всем нужны адреса. Нам нужен почтовый адрес, чтобы до нас доходили классные посылочки, квитанции, старомодные любовные письма — почему бы нет? Нам нужен адрес регистрации, чтобы мы могли полноценно участвовать в жизни своего города и чтобы государство нас не теряло. Ну и конечно же нам нужен адрес в сети интернет, чтобы до нас доходили пакеты байт с весёлыми гифками, закодированными символами и бесконечным потоком видеоконтента, который мы для вас производим.

Да, адреса в интернете, определенно нужны! Именно так в начале 1980-х решили создатели первой успешной, неэкспериментальной версии интернет протокола — IPv4, Internet Protocol версия 4.

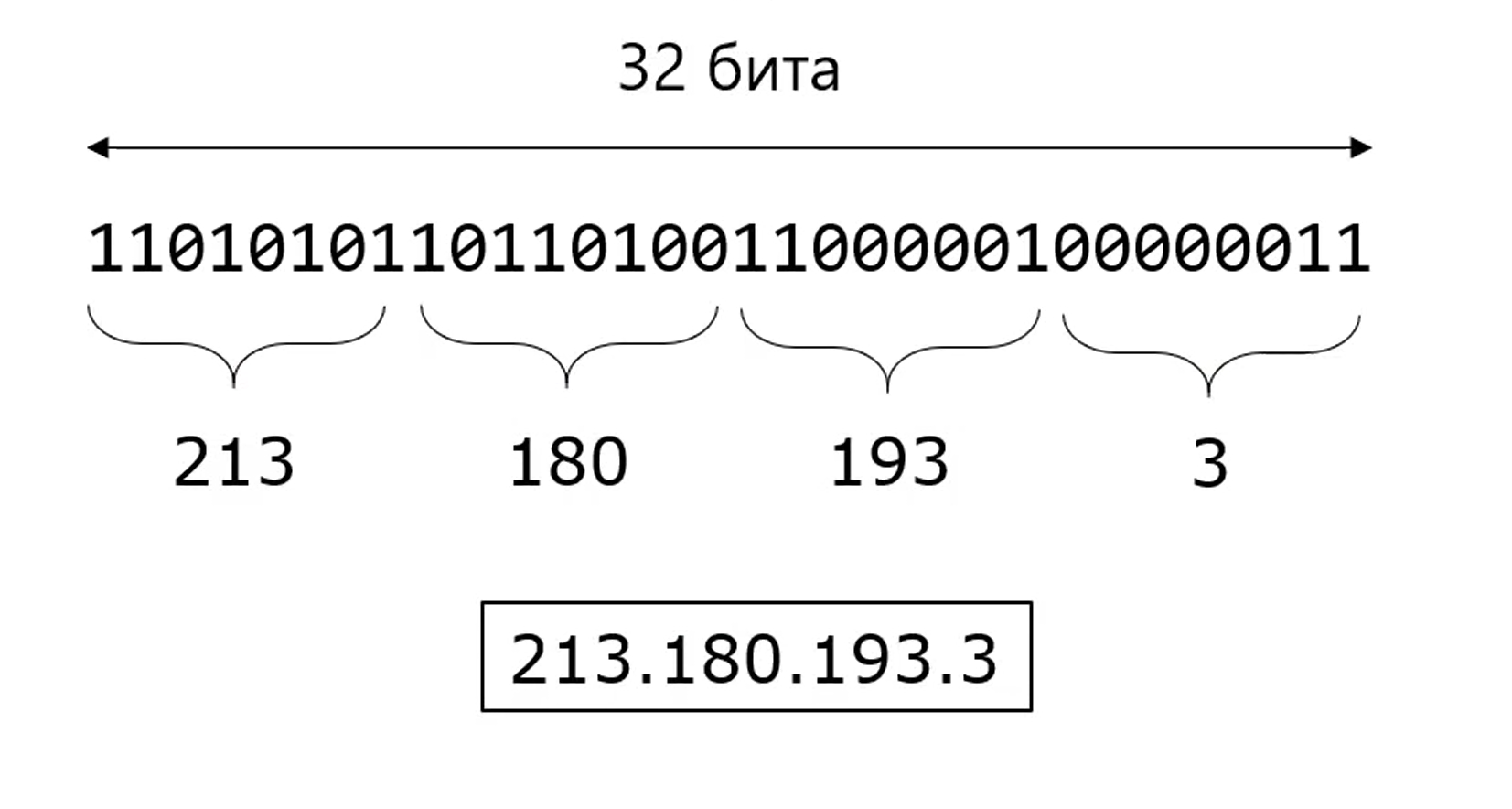

Тогда и был придуман IP-адрес, который выглядит вот так:

Небольшое пояснение, ІP-адрес — это, по сути, почтовый адрес устройства в сети. IP-адрес должен быть у каждого сайта, смартфона, компьютера, сервера, умной лампочки и прочее, иначе пакеты данных просто не будут знать, куда им лететь.

А если вы хотите, подробнее узнать о том, как IP-адрес 89.253.228.19 преобразуется в привычный всем адрес сайта https://droider.ru вы можете из предыдущей части этого материала про DNS-сервера.

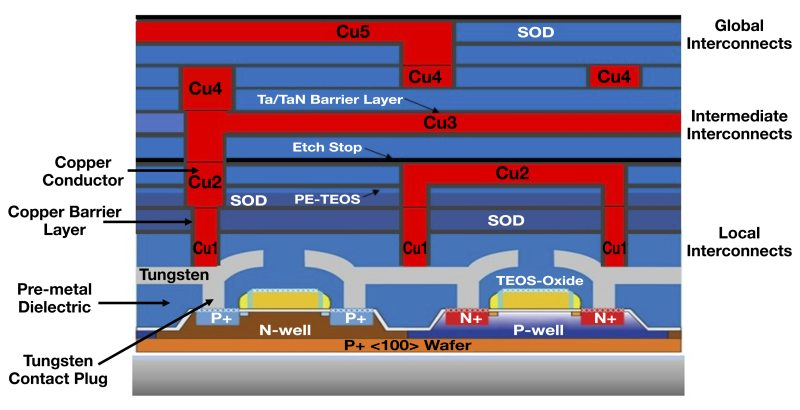

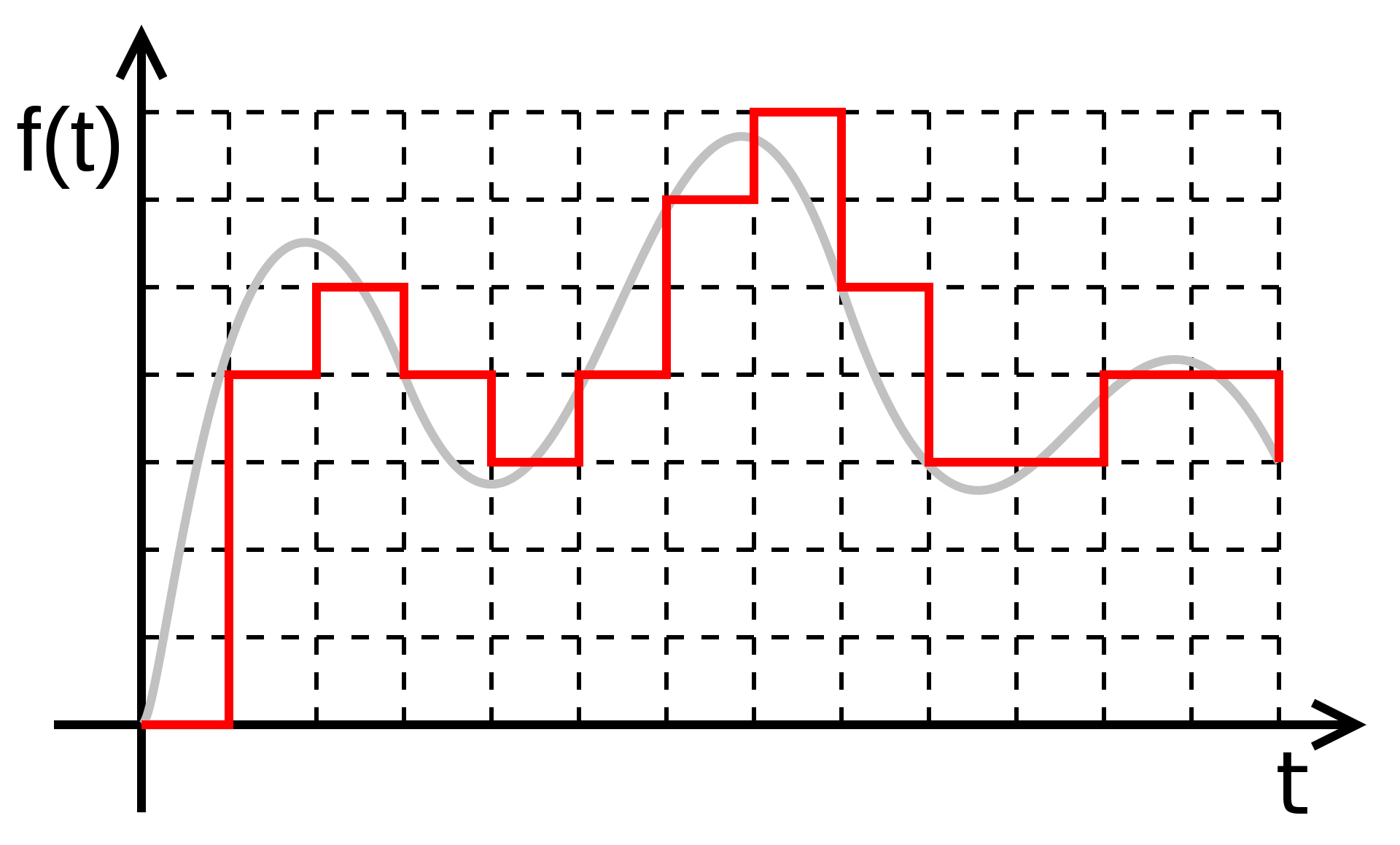

IPv4 адрес состоит из 4 блоков по 8 бит, каждый из которых называется октетом, и записывается в виде десятичных цифр, разделенных точкой.

Всего длина такого адреса 32 бита. Что на самом деле превращается в целых 4 миллиарда 294 миллиона 967 тысяч 296 комбинаций. Тогда, в 1980-х, Интернет был только у военных и в университетах, поэтому создатели протокола решили, что такого количества адресов хватит с запасом.

СПОЙЛЕР: они сильно заблуждались.

Как IP-адреса закончились?

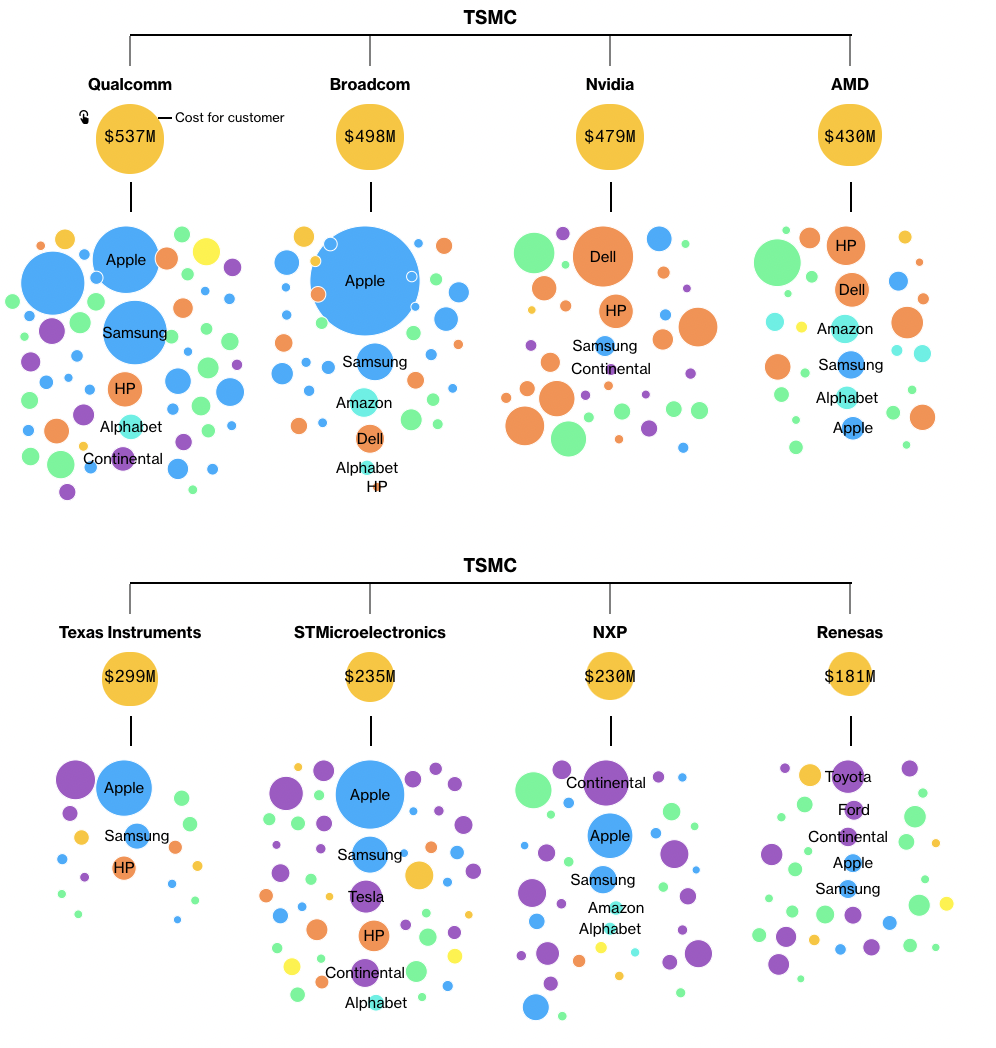

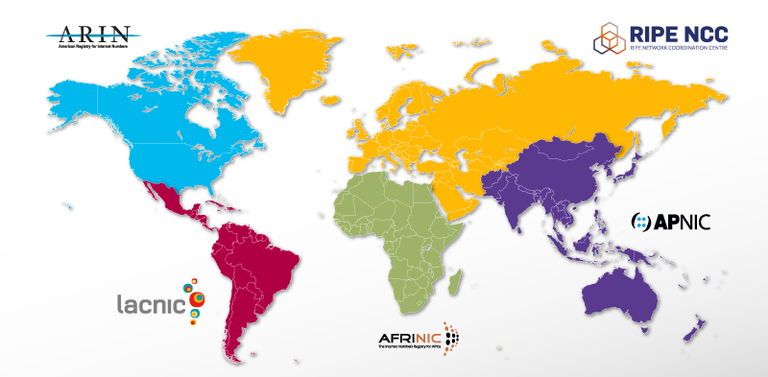

Так как адресов было ограниченное количество, право их раздавать было закреплено за пятью некоммерческими организациями, ответственными за свой регион.

Например, за Европу, Ближний Восток и Центральную Азию отвечает организация RIPE NCC, скромный офис которой находится в Нидерландах.

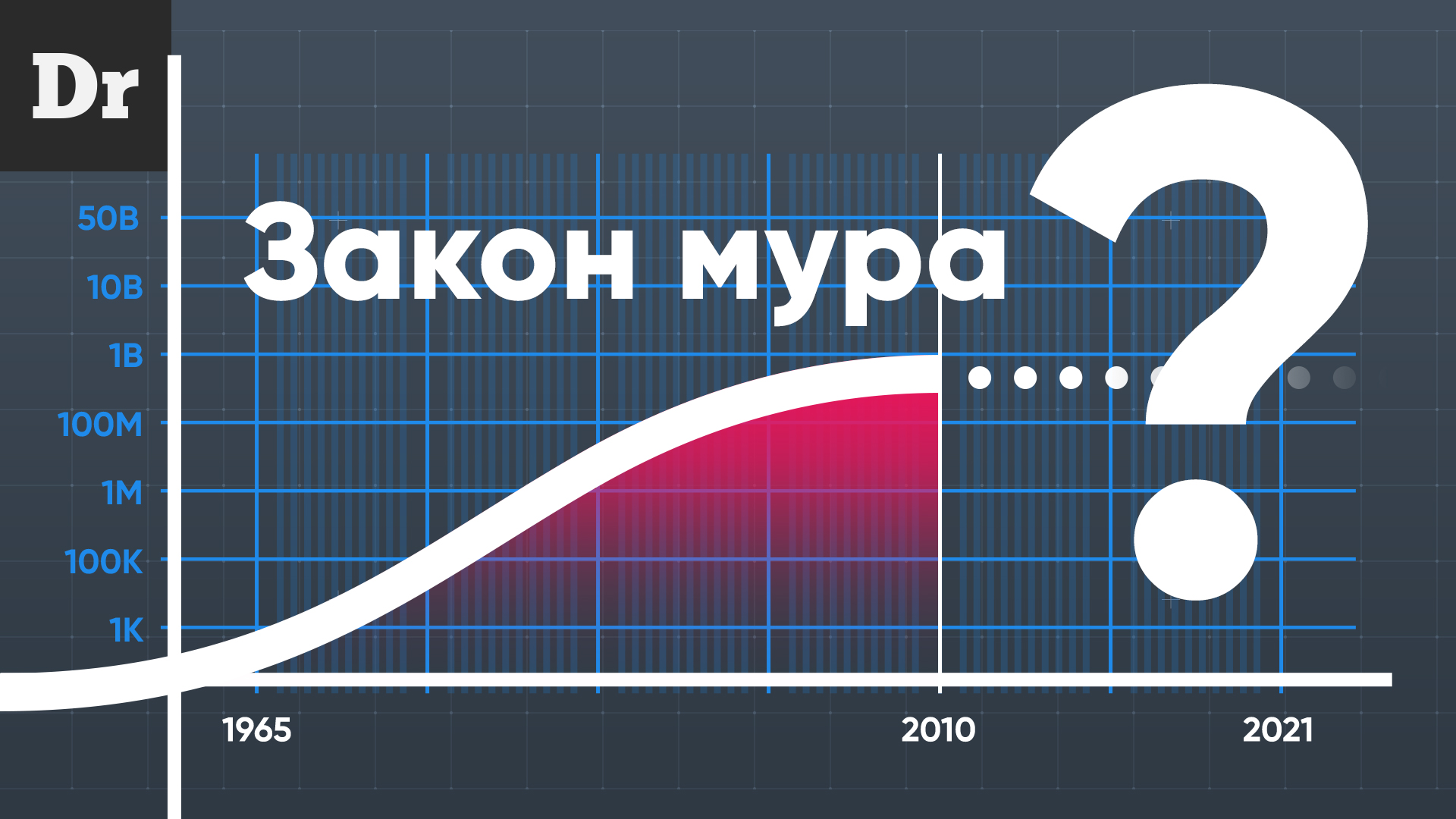

Естественно, с бурным развитием интернета и появлением всевозможных гаджетов, свободные IP-адреса стали быстро заканчиваться. Например, ARIN исчерпала запас IPv4 адресов еще в 2015 году, а наш родной RIPE NCC оказался с пустыми карманами 25 ноября 2019 года.

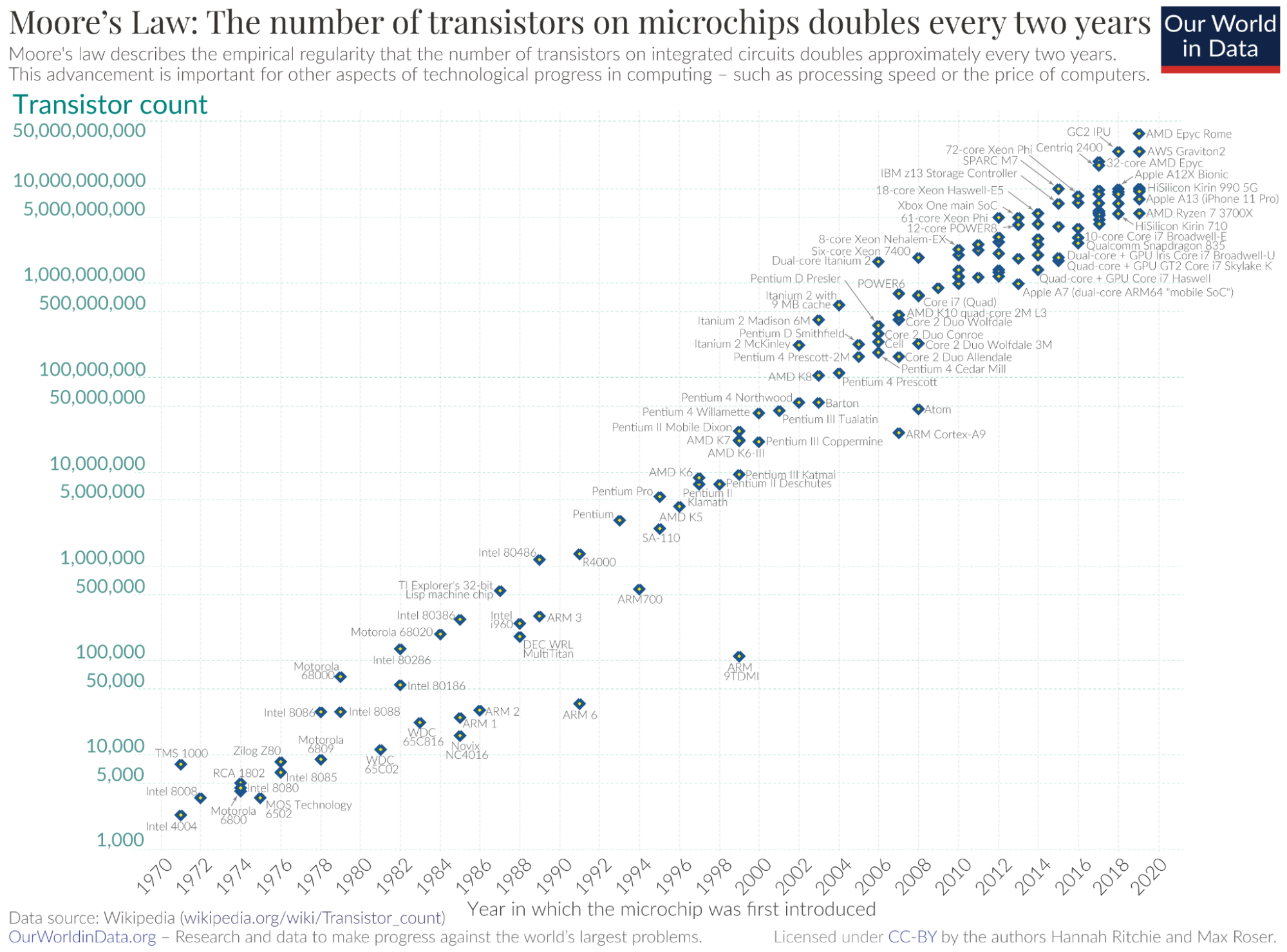

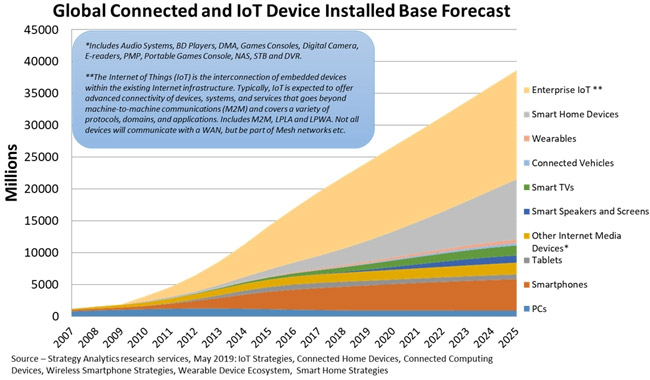

Тем не менее количество подключенных к сети девайсов растет в геометрической прогрессии и сейчас измеряется десятками миллиардов. Чтобы вы понимали скорость роста, по данным IDC, к 2025 году в сети будет более 152 миллиардов устройств Интернета вещей, только (!) устройств интернета вещей! В 2021 году их всего 10 миллиардов. Итого ожидается рост в 15 раз за 4 года!

Но как же так происходит? Адреса давно кончились, умных лампочек всё больше, а интернет продолжает себе спокойно работать и вроде никто не жалуется.

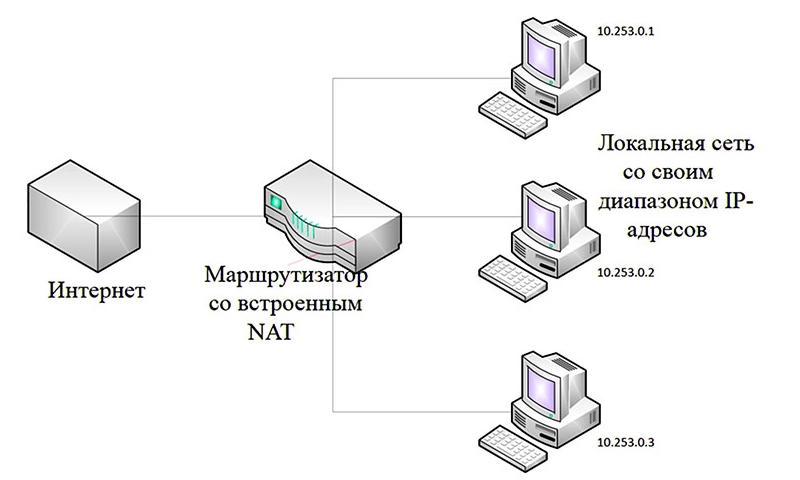

На самом деле человечество давно осознало проблему недостаточного адресного пространства и решило её при помощи технологии преобразования сетевых адресов, которая называется NAT — Network Address Translation.

NAT делает очень простую вещь — позволяет преобразовать ваш адрес внутри локальной сети в глобальный адрес. По сути, NAT похож на то, как раньше приходилось дозваниваться домой по городскому номеру.

Вы звонили вашему другу или подруге. Трубку брал папа, вы говорили “Машу можно” и папа передавал трубку адресату. Ну или говорил, “нет тут никакой Маши, не звони сюда больше, придурок”, но это уже не имеет отношения к делу.

Вот так и технология NAT позволяет перенаправить запрос, который поступил на общий IP-адрес, до нужного адресата. Только вместо папы, который взял трубку, это делает маршрутизатор.

И в принципе технология прекрасно справляется с задачами. Она позволят держать на одном IP-адресе тысячи, может даже сотни тысяч девайсов и сайтов. И, даже, в какой-то степени, делает сеть безопасней. Но это не точно… Мнения профессионалов в этом вопросе расходятся. Но в любом случае, все сходятся во мнении, что NAT — это костыль, который усложняет работу, ограничивает и увеличивает нагрузку на сеть.

IPv6

Поэтому единственное, что действительно полностью решает проблему — это интернет протокол нового поколения — IPv6, переход на который по степени воздействия можно сравнить с переходом от стационарных телефонов на одну семью к сотовым телефонам на каждого пользователя. Но что же такого хорошего в интернет протоколе 6-го поколения?

Первое и главное отличие: IP-адреса в новом протоколе стали длиной 128 бит. Это дает 2128 вариантов уникальных адресов, а это на секундочку вот столько:

340 282 366 920 938 463 463 374 607 431 768 211 456 комбинаций

А это всего лишь 340 унцендиллионов или 340 триллионов триллионов триллионов. Иными словами, в этот раз ребята реально перестраховались.

Соответственно, с изменением длины адреса, поменялся и его формат. Новый IP-адрес стал выглядеть немного сложнее, к примеру вот так:

Пример IPv6 адреса

2001:0db8:0000:0000:0000:0000:0010:ad12

IPv6 адрес теперь состоит из 8 групп шестнадцатеричных чисел, разделенных двоеточиями.

Выглядит правда так себе, но хорошая новость в том, что в таких адресах можно сократить нули слева направо, поэтому большой адрес можно записать вот так, что гораздо симпатичнее.

2001:0db8:0000:0000:0000:0000:0010:ad12

2001:db8:10:ad12

Очевидные преимущества

IPv6 во многом превосходит IPv4 и имеет ряд очевидных преимуществ. Во-первых,более широкое адресное пространство, которое уже даёт массу преимуществ:

- Адресов хватит с запасом на многие десятилетия вперед. А значит не надо будет париться над обходными решениями, и можно будет полностью избавиться от NAT.

- Каждое из устройств подключенных к сети сможет получить свой “белый” IP адрес, что уже хорошо.

- По настоящему хорошо заработают peer-to-peer сети, т.е. сети в которых устройства могут общаться между собой напрямую.

Во-вторых, в новом протоколе упростили и причесали:

- Теперь адреса можно создавать и настраивать автоматически, благодаря технологии SLAAC — Stateless Address Autoconfiguration. А это сущесвенно упрощает администрирования сети.

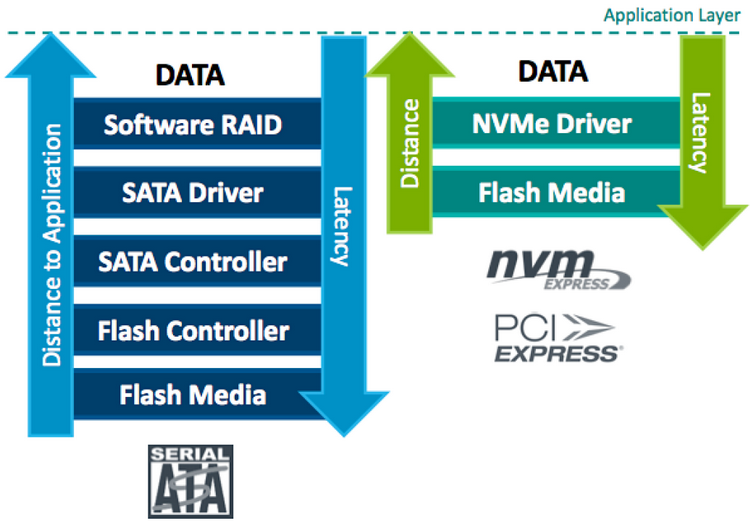

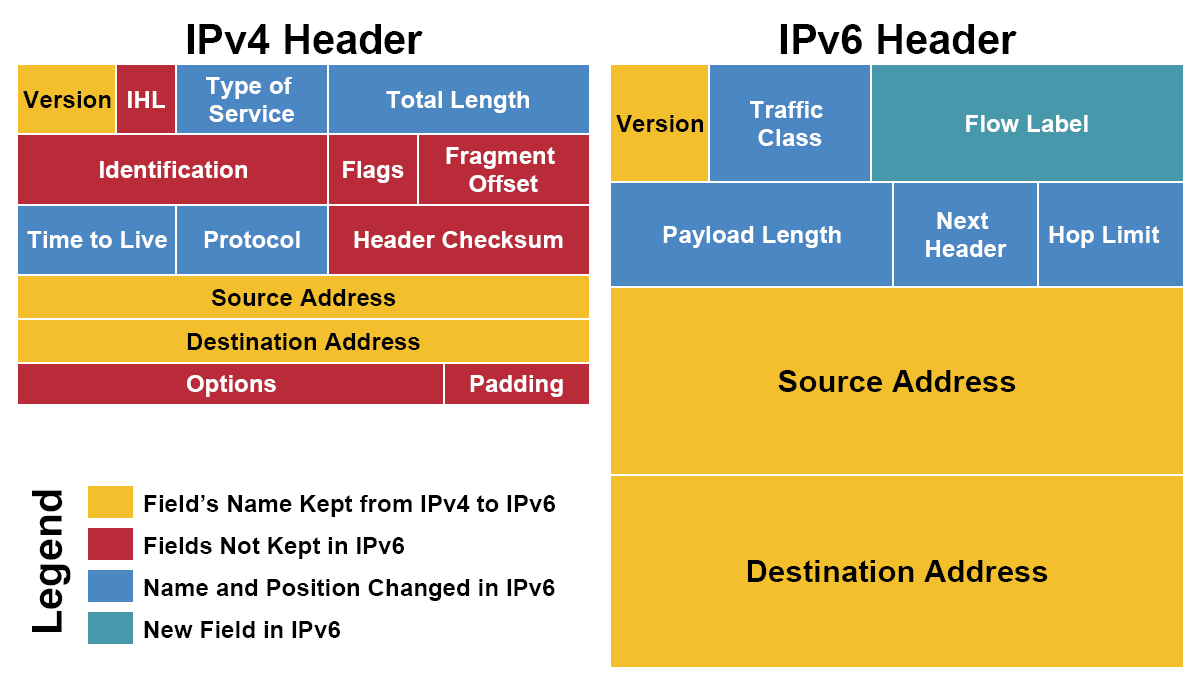

- Также в IPv6 существенно упростили заголовки пакетов, которые стало проще и быстрее обрабатывать.

Ну и добавили обязательную поддержку шифрования трафика IPsec, в конце концов. И многое, многое другое.

Неочевидные преимущества

Но ключевой момент в том, что все эти небольшие и вроде бы незначимые изменения на самом деле решают большие проблемы.

В текущем интернете у нас с вами нет настоящих “белых” IP-адресов, поэтому некоторые сервисы и протоколы просто не могут нормально работать.

Например, для того чтобы VoIP-вызовы работали на мобильных, устройство вынуждено постоянно держать соединение с SIP-сервером, на что уходит много трафика и заряда батарейки. Также нормально не работают любые FTP, p2p-сети и прочее.

В IPv6 таких проблем нет, новый протокол делает каждые девайс полноценным участником интернета: устройства могут общаться друг с другом напрямую, минуя даже DNS-сервера.

Иными словами, интернет который у нас есть сейчас нельзя назвать полноценным. Наши устройства не имеют своего личного пространства в сети, они его как бы арендуют у провайдеров и различных сервисов на очень ограниченных условиях. Новый же интернет позволит принципиально изменить и оптимизировать структуру сети. Но этого не происходит.

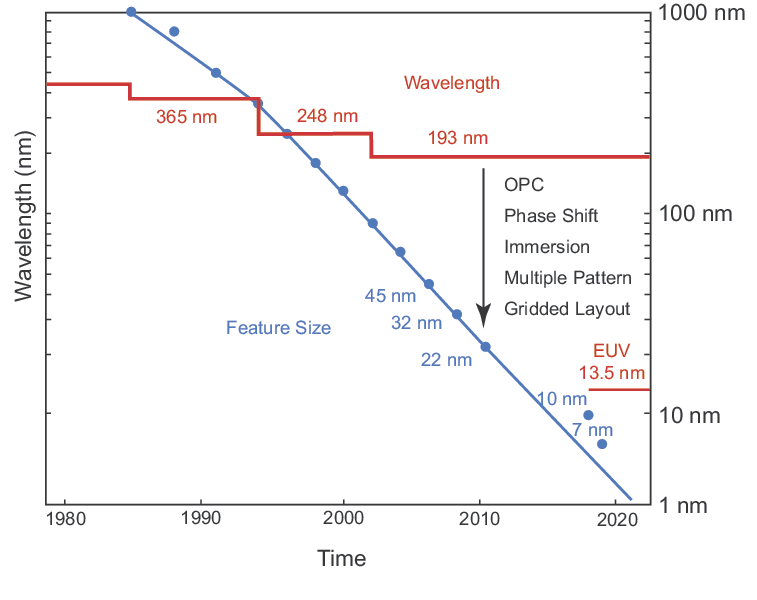

Сам протокол придумали еще в 1996 году.

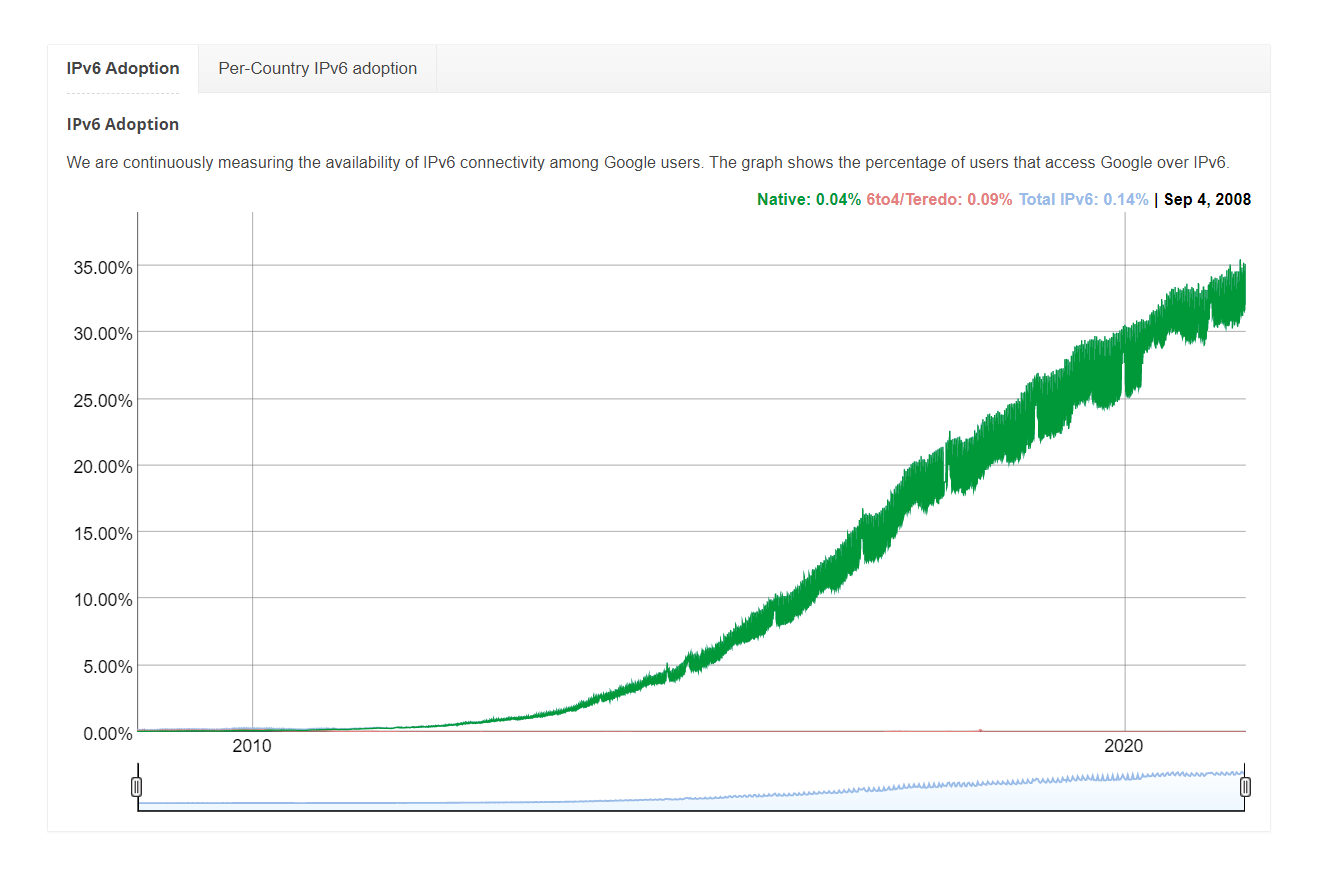

Google стал активно использовать IPv6 еще в 2008 году.

А официальный всемирный запуск IPv6 состоялся в 2012.

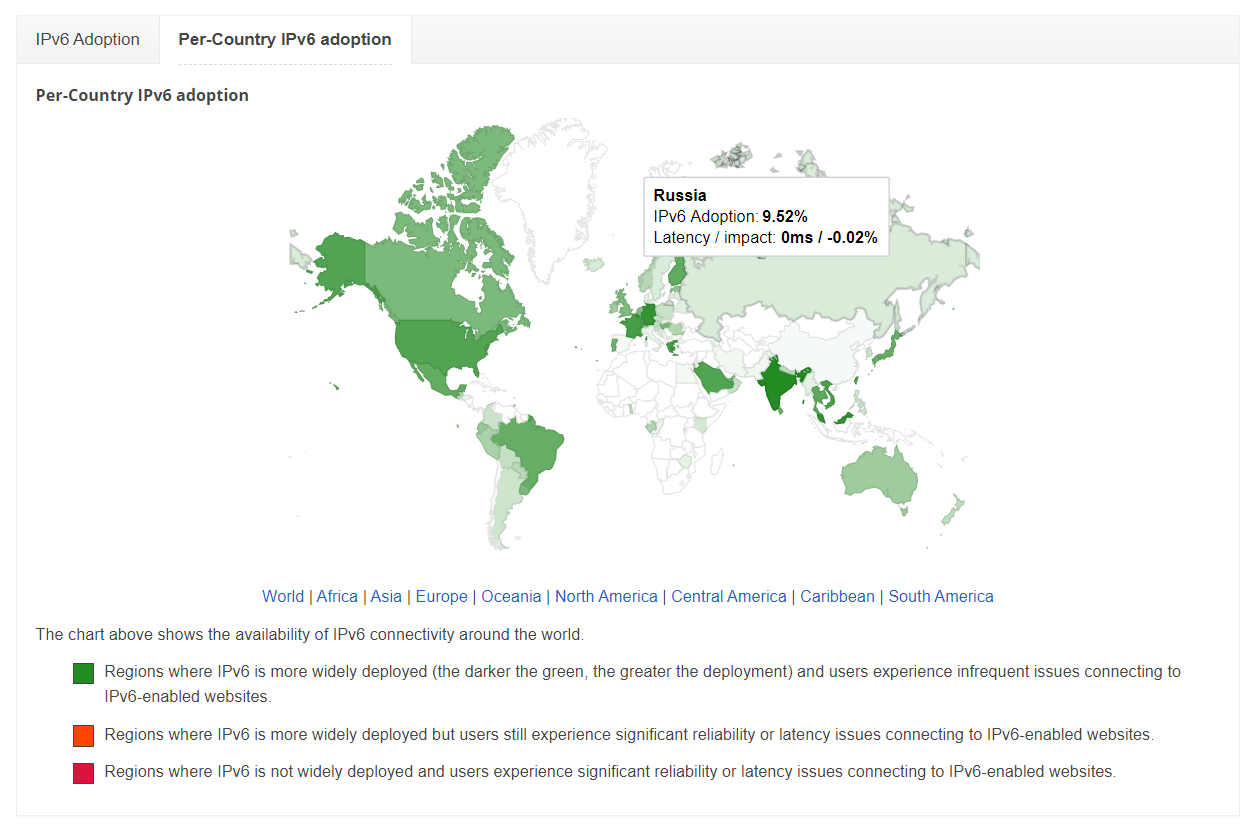

После запуска все аналитики твердили, что в течение 5 лет мы полностью избавимся от IPv4 и перейдем на новый протокол, но на текущий момент по статистике Google только 30-35% трафика приходится на IPv6.

А в России так вообще меньше 10%.

Так почему же скорость внедрения такая маленькая?

Проблемы IPv6

Скажем, IPv6 — неидеальный. У него есть ряд серьезных проблем.

Начнем с того, что для провайдеров обновляться на IPv6 очень дорого. Нужно закупать новое оборудование, перенастраивать его и прочее. А зачем это делать, если итак всё работает? Согласитесь, когда на кону миллиарды, вопрос становится очень серьёзным.

Во-вторых, на текущий момент всё еще очень мало понимания, как настраивать IPv6. И даже у больших профессионалов с многолетним опытом возникают сложности, чего уж говорить о рядовых пользователях.

В-третьих, IPv6 не имеет обратной совместимости с IPv4. А это значит, что на время перехода нужно работать в режиме дуал-стек, то есть поддерживать и то, и то. А это это фактически двойная работа по настройке, гарантированное увеличение косяков и гарантированное уменьшение безопасности. То есть параллельная работа IPv4 и IPv6 в 2 раза увеличивает поверхность атаки. Так как нужно защищать и то, и то.

Тем не менее все специалисты сходятся во мнении, что переход на IPv6 неизбежен, это дело времени. И когда это переход состоится, мы наконец то увидим, как на самом деле должен работать интернет.

Хитрый переход

Уже сейчас все офисы IT гигантов Google, Facebook, Amazon работают исключительно на IPv6. Поэтому, если вы вдруг отвечаете за IT инфраструктуру внутри компании, лучше позаботиться о полноценной поддержке IPv6.

И даже если у вас совсем небольшая компания, вы это сможете сделать: поможет вам в этом классное оборудование от спонсора этого материала — Cisco.

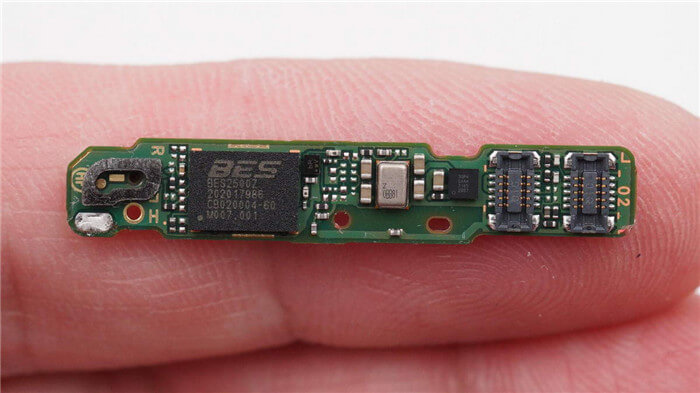

Например, межсетевой экран Firepower 1000 — настоящая огненная мощь на страже безопасности вашей компании. Что эта штука умеет? Начнем с того, что это Firewall нового поколения корпоративного уровня, который подходит для небольших офисов.

Главные фичи:

- Есть система предотвращения вторжений Secure IPS (NGIPS)

- Система глубоко анализирует трафик, просматривает больше контекстных данных из сети и автоматически справляется с угрозами.

- А мониторить и администрировать всё это можно через удобный и понятный веб-интерфейс, с подробной статистикой и наглядными дашбордами.

Firepower работает быстро, легко настраивается, шифрует трафик и, конечно, полностью поддерживает IPv6. Не важно, сразу же вы решили? что IPv6 ваше светлое настоящее или вы находитесь в процессе постепенной миграции с прошлого IPv4. Firepower 1000 обеспечит нужную защита и сразу и в процессе перехода.

А на этом у нас сегодня всё.