Все смартфоны уже давно одинаковые и это хороший знак. Смартфоны, как гаджеты, завершили свою эволюцию. Там почти нечего улучшать, поэтому почти все смартфоны — классные. Бери любой — не ошибешься. А вот с ноутбуками всё куда сложнее и поэтому куда интереснее. Хоть они и существуют дольше.

Например, сегодня у нас на обзоре новый ноутбук MSI Stealth 15M. И в этой модели есть три технологические инновации:

- корпус

- процессор

- система охлаждения особенно любопытна.

С одной стороны — это три крутейших преимущества этого ноутбука. С другой, они являются причинами трёх недостатков.

Сегодня всё это обсудим, а вы уже сами решите, что для вас важнее. Будет интересно.

Корпус

Начнём с корпуса. Это тонкий и очень лёгкий игровой ноут. Толщина корпуса 15,95 мм, вес 1,69 кг при размере экрана 15,6 дюймов. Для сравнения MacBook Pro 16 и весит больше — 2 кг, и толще — 16,2 мм. Даже MacBook Air в самом толстом месте — 16,1 мм.

- MSI Stealth 15M 358.3 мм x 248 мм x 15.95 мм / 1.69 кг

- MacBook Pro 16 357.9 мм x 245.9 мм x 16.2 мм / 2 кг

Более того, весь корпус металлический, всё прекрасно собрано и отлично выглядит. Ноутбук на стиле. А крышка фиксируется магнитами.

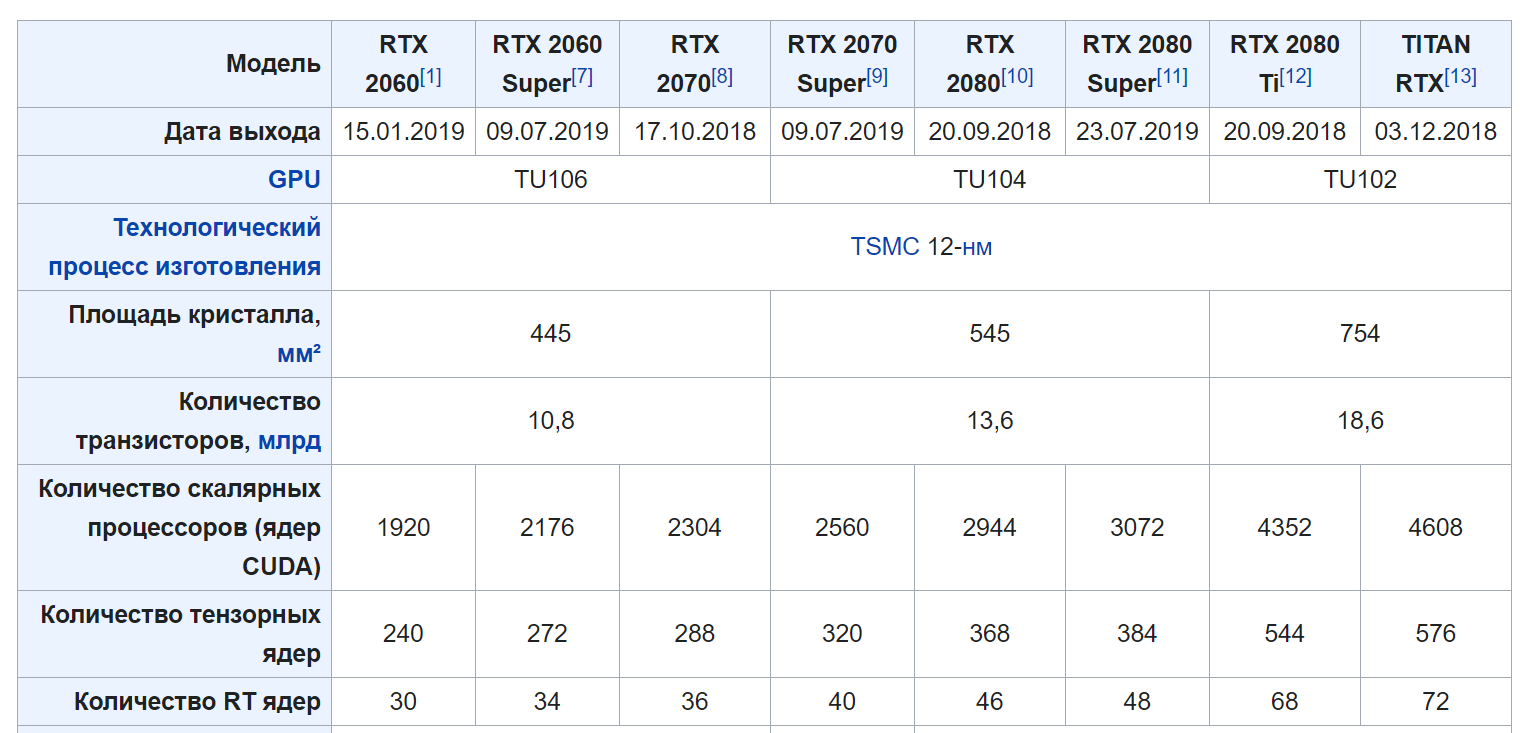

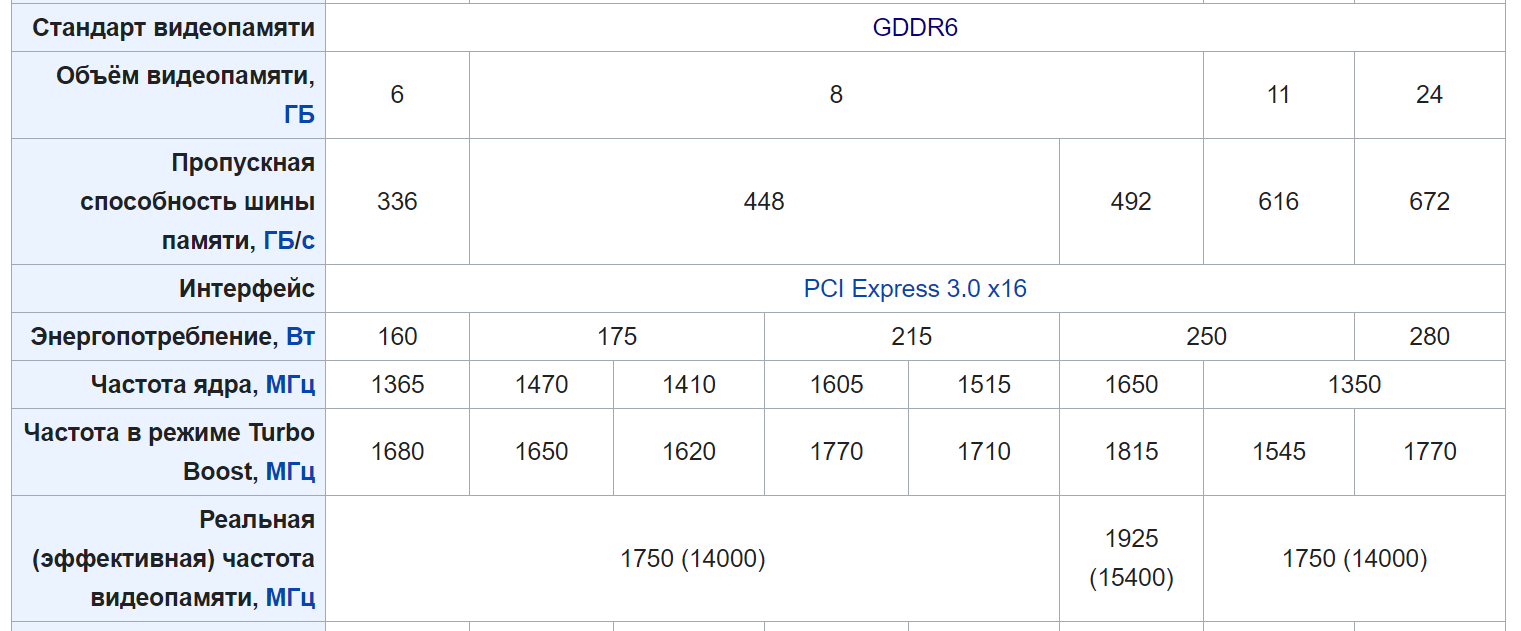

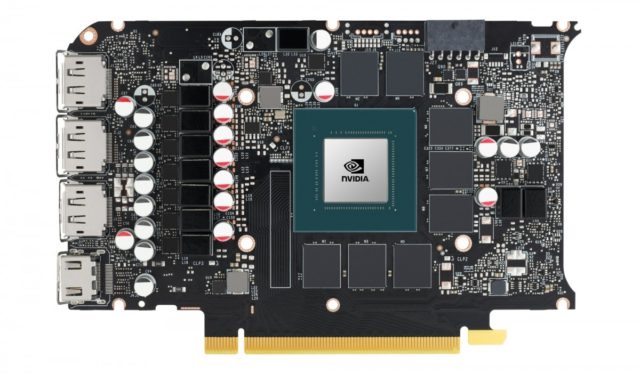

Но, напомню, это мощный игровой ноутбук. В нашей модели стоит NVIDIA GeForce RTX 2060 в дизайне Max-Q. Если не знаете, что это такое — посмотрите наш материал про видеокарты. Есть еще модификация побюджетнее — с GTX 1660 Ti Max-Q, но это тоже неплохо.

С одной стороны, такой размер для игрового ноутбука — это настоящая мечта. Его можно брать собой везде в офис, на дачу, в дорогу. Получаем уровень графики как на PlayStation 5, при этом новую плойку с собой не потаскаешь. Она реально огромная и весит 4,5 кг. А тут даже блок питания не такой большой для игрового решения, он кстати на 120 Вт и весит 350 грамм. При этом ноутбук можно заряжать через USB-C с помощью компактного адаптера мощностью 65 Вт. Короче, преимущества компактного корпуса — очевидны. Но есть и недостатки. Например, батарея тут 52 Вт.ч, и это не рекорд. В нашем случае ноутбук прожил пару часов в смешанном режиме.

Если заглянуть под крышку видно, что могла бы поместиться батарейка и побольше. Но тогда бы ноутбук стал тяжелее и возможно толще.

И тут уже вам решать? Что важнее — вес и толщина, а может время работы. Для многих, кто часто таскает ноутбук с собой — компактность и вес куда важнее. Тем более в играть, в любом случае надо с подключенным питанием, иначе компьютер просто не будет выдавать полную мощность.

Охлаждение

Но как же в таком компактном корпусе поместилось игровое железо? Правильно — нужна правильная система охлаждения. В играх этот ноутьук показывает себя очень хорошо для такого компактного решения. Все это стало возможным благодаря новой системе охлаждения — CoolerBoost 5.

Для начала поговорим про то, как работает охлаждение в ноутбуках в целом. Задача системы охлаждения — как можно быстрее и эффективнее отвести тепло от чипа, который нагревается. Для чего используется вот такая многоступенчатая система:

- На чип наносится специальный термопроводящий материал — термопаста.

- К термопасте прижимается металлическая пластина, как правило из меди, назовём её термоплощадкой.

- Дальше к площадке приваривается теплотрубка, по которой тепло бежит до ребер радиатора, где оно окончательно рассеивается.

- А теплый воздух из корпуса выводится кулерами.

Много всего, да? Для того чтобы обеспечить грамотную систему охлаждения в данном ноутбуке сделали два независимых термомодуля: для центрального и графического процессора с шестью тепловыми трубками и двумя мощными кулерами. Это уже пятое поколение системы охлаждения, в которой учли кучу факторов.

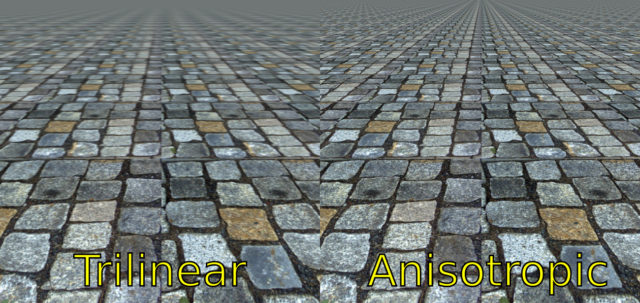

Например, для более плотного прилегания термоплощадке к термопасте, MSI стали эти площадки шлифовать.

Также доработали форму: термотрубки стали короче и менее изогнутыми, что помогает быстрее отводить тепло. А у самих кулеров лопасти стали тоньше на 0,1 мм, что увеличило воздушный поток. В итоге, охлаждение стало эффективнее, а корпуса ноутбуков тоньше.

Более того у MSI есть секретное оружие — режим работы CoolerBoost, в котором скорость вращения вентилятора может подниматься до 6,5 тысяч оборотов в минуту. А это очень много по сравнению с типичными максимальными 4800. Отверстия тут со всех сторон: выглядит прикольно, будто ноутбук дышит.

Но есть и недостатки у такого охлаждения. Оно довольно шумное. Причем слышно именно вентилятор. При низких нагрузках, например, когда серфишь в сети, охлаждение почти не слышно. Уровень шума в районе 27 дБ.

Но вот при максимальных нагрузках уровень шума поднимается до 39-40 дБ, это уже громко, но терпимо. А в режиме CoolerBoost шум может достигать 43 дБ, что уже совсем громко и без наушников тут не обойтись. Поэтому несмотря на постоянные улучшения системы охлаждения, при высоких нагрузках всё равно есть компромисс в виде шума.

Процессор

И напоследок, поговорим про процессоры Intel. Это один из первых ноутбуков с новым процессором 11-го поколения — Tiger Lake. А если точнее, тут стоит Intel Core i7 1185G7. И что в этом хорошего? Это ж Intel, а их сейчас принято ругать. Ну смотрите. 11-е поколение — это, по-прежнему, 10 нанометров. Но, это такие 10 нм, за которые не стыдно. Несмотря на то, что нанометры остались те же, всё остальное в процессоре поменялось.

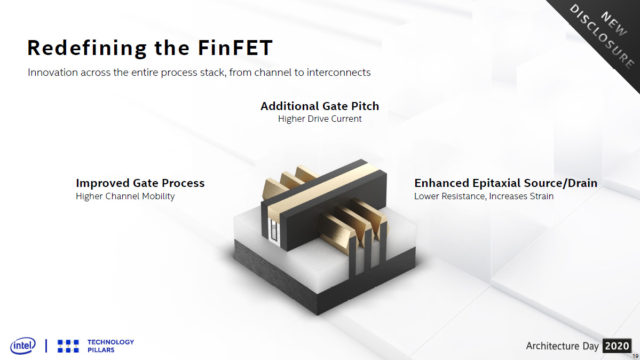

Intel изменили форму транзистора, раньше была технология FinFet, теперь это SuperFin. Они изменили архитектуру ядра и еще сделали кучу важных улучшений.

Это позволило поднять производительность ядра на 15-20%. Это немало. А предельная тактовая поднялась до 4.8 Ггц, что на 1 ГГц больше чем в прошлом поколении.

В итоге, Tiger Lake в одноядерной производительности круче процессоров Ryzen 4000 серии.

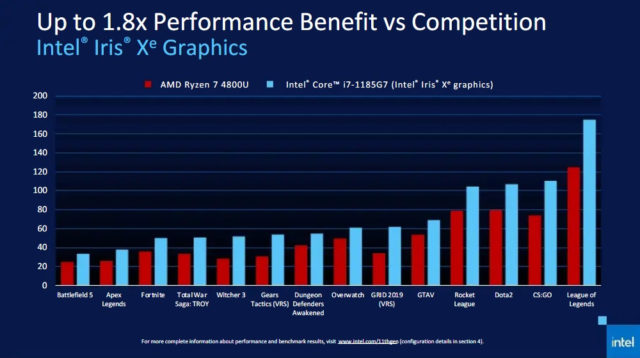

Также в новых Intel куда более мощная встроенная графика Intel Xe и мощный нейропроцессор, который используются в куче софта вроде того же пакета Adobe.

Поэтому, сейчас поймите меня правильно, в очень многих задачах процессоры Intel будуn куда более предпочтительные, чем AMD.

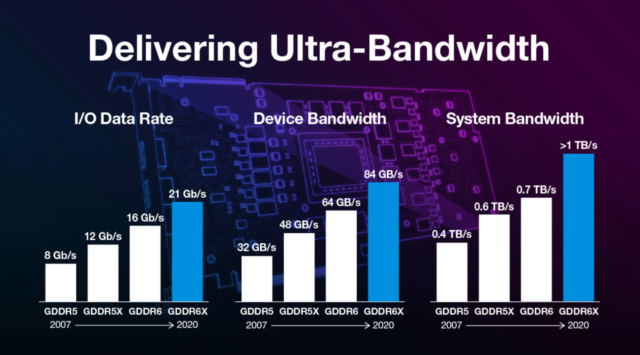

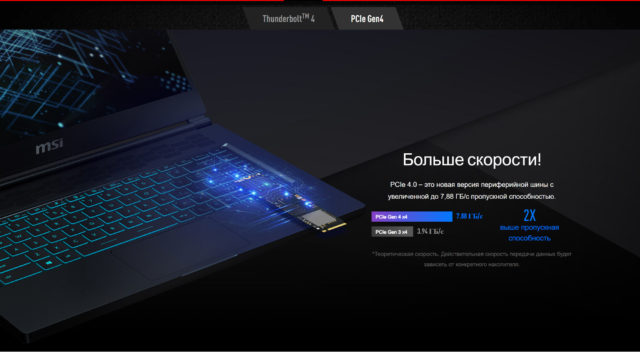

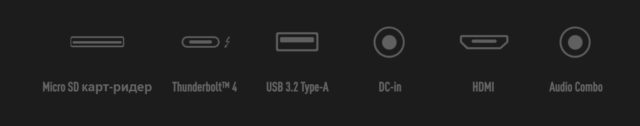

Но главная фишка Intel — это поддержка современных интерфейсов. Вместе с Tiger Lake вы получаете Thunderbolt 4 и USB 4 соответственно. А также поддержку шины PCI Express 4.0. Что теоретически даёт в 2 раза более высокую пропускную способность для вашего SSD диска — 7,88 Гбайт/с. Все это очень сильно влияет на скорость и отзывчивость системы. И всё это есть в данном ноуте. Между прочим, у одних из первых на рынке.

В этом ноутбуке есть один слот M.2 под SSD, в котором установлен накопитель на 512 ГБ и скорости у него очень даже приличные. И вдогонку тут есть поддержка Wi-Fi 6 и BT 5.1. Короче, он поддерживает все современные интерфейсы и во многом это благодаря Intel. НО! Есть и проблемы…

Проблемы Intel

Процессоры Tiger Lake поддерживают пока что только 4 ядра в отличие от 8 ядер у AMD Ryzen. Поэтому в задачах, требующих многоядерности, чипы Ryzen будут быстрее.

Также за счет более тонкого техпроцесса — 7 нм, процессоры AMD Ryzen куда более энергоэффективны, мы в этом убедились на практике. Но, опять же, для игр ни многоядерность, ни энергоэффективность не так важны.

Я запустил на этом ноутбуке Cyberpunk 2077 на низких настройках и он идет в Full HD разрешении примерно с 24 кадрами в секунду. В то же время в CS:GO ноутбук выдаёт в Full HD со скоростью 60 кадров в секунду.

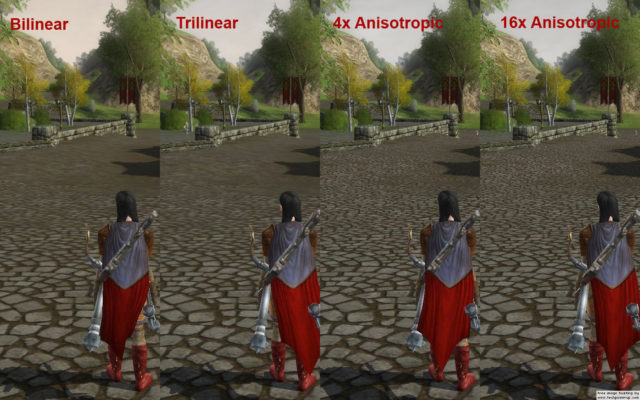

Дисплей и звук

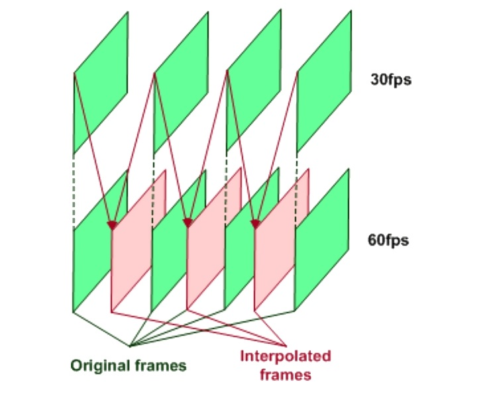

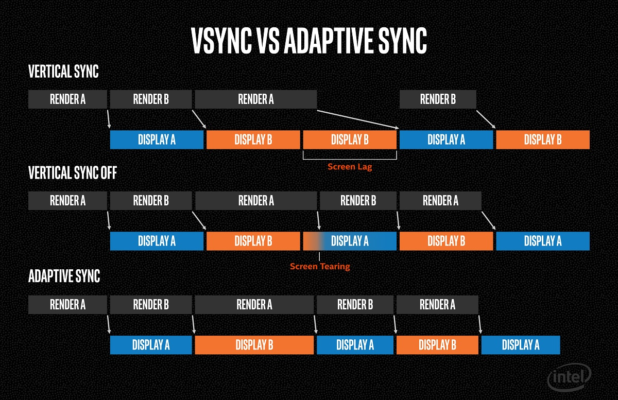

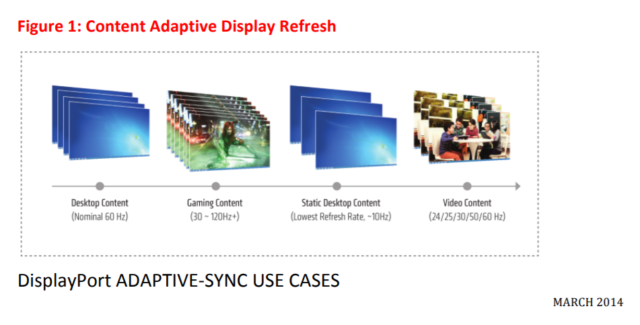

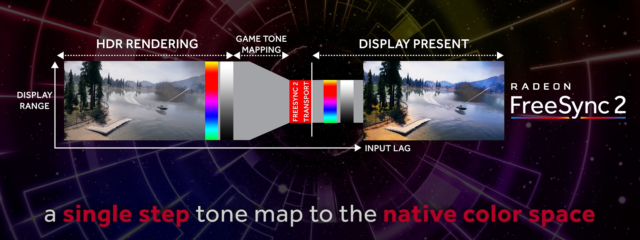

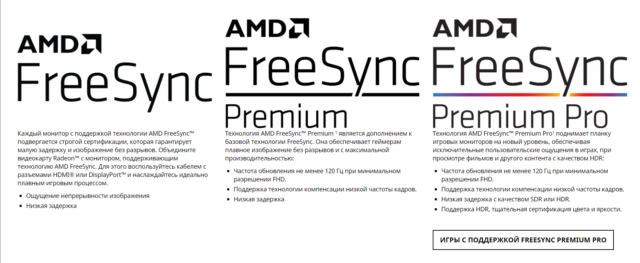

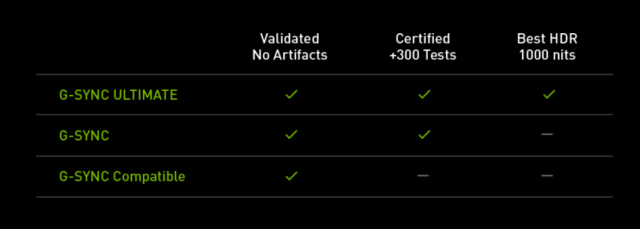

Ну и завершая тест, пару слов про дисплей и звук. Тут быстрый IPS-дисплей 144 Гц. Кто ни разу в жизни не видел такие дисплеи — очень рекомендую, даже Windows на частоте 144 Гц выглядит как-то круто. Экран не самый яркий, всего 300 нит и немного тускловатый. Но для игр такой дисплей более чем подходит, а для работы работы с графикой рекомендую внешний монитор. который можно подрубить по HDMI и Thunderbolt-разъёмам.

За звук тут отвечают 2 динамика по 2 Вт. Они довольно громкие и разборчивые. В общем, звук неплохой.

Итоги

Итого, на мой взгляд получился классный девайс. Реально стильный, легкий и компактный ноут. Такой можно легко брать в дорогу, чтобы играть в AAA-тайтлы с отличным графоном. Да, под нагрузкой есть шум, поэтому комфортнее играть в наушниках. Но в целом, MSI Stealth 15M интересная модель, присмотритесь если вам нужен компактный, стильный игровой ноут.